智东西(公众号:zhidxcom)

文 | Lina

智东西10月23日消息,上周,全国高性能计算学术年会(HPC China 2017)在合肥举行,本次大会是HPC China举办的第十三届,大会主题是“应用驱动 生态共建”,中国科学院院士陈国良、中国工程院院士廖湘科、英伟达中国区企业事业总经理沈威、联想HPC/AI执行总监Scott Tease等产学研界人员围绕HPC软硬件应用、科研政策等进行了探讨与展示。

一、崛起的HPC产业与薄弱的软件生态

HPC(High Performance Computing)高性能计算,又称超算,指的是比普通PC与低档服务器在性能、功能方面要优秀众多的计算系统和环境。HPC计算系统有很多类型,从高度专用的个人硬件超级计算机(单价至少在10万元以上),到标准计算机的大型集群应有尽有,可以应用在AI、高精度视觉渲染、CAD设计、CAE仿真、科学计算等领域。

目前中国在HPC行业的预算投入保持在了每年15%以上,可以说是增长十分快速,而我国自主研发的神威.太湖之光、天河二号等超级计算机也在各种国际高性能计算会议上屡获佳绩。

然而,国内HPC基础设施(比如各类高性能国产计算芯片)持续增长的同时,也暴露出目前我们与欧美国家成熟HPC行业的短板:上层应用软件与系统开发工具的缺乏,成熟的商业软件无法方便运行,生态环境不完善。这也是本届HPC China主题为“应用驱动 生态共建”的原因。

二、GPU与HPC

说起AI与高性能计算,自然少不了英伟达的身影。英伟达中国区企业事业总经理沈威介绍,从2006年开始,英伟达发明了CUDA,使得各类学者、研究人员、开发者们可以很方便地基于GPU进行计算研发,从此英伟达也进入到了高性能运算的领域。到了2008年,世界500大的超算中心里已经开始采用GPU进行计算了。

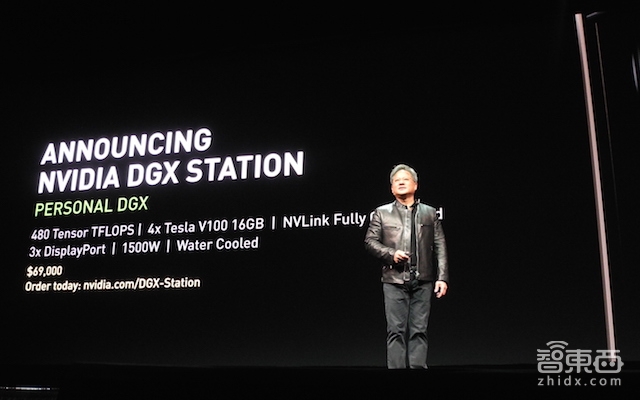

除了入驻超算中心外,英伟达还推出过超级电脑DGX-1和DGX-Station,前者搭载8块Tesla P100显卡(今年5月的GTC上升级为8块Tesla V100显卡),系统双精度计算峰值可以达到960TFlops,售价14.9万美元。

同样是在今年5月的GTC上,英伟达还推出了一个更加个人级的超级电脑DGX-Station,它专门针对小型AI创企、或是对计算能力要求并不太高的科研团体或个人进行打造,配备了4块Tesla V100显卡,售价6.9万美元(折合人民币约45万元),这台超级电脑在不久前的GTC China上正式开卖。

三、45万的超级电脑:DGX-Station

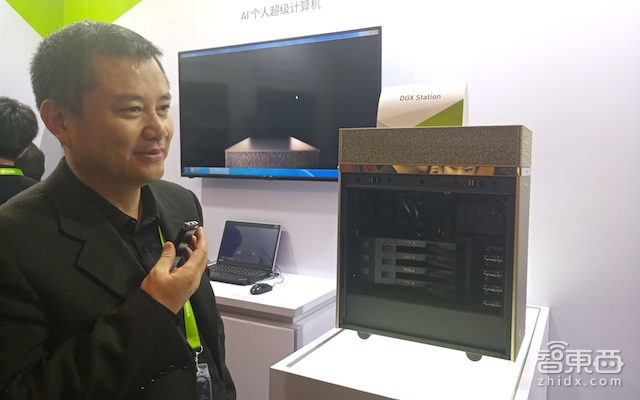

智东西也在本次HPC China 2017中英伟达的展位上见到了这台DGX-Station,它的大小跟一台普通的台式电脑主机机箱类似,配备了4块Tesla V100显卡,系统双精度计算峰值可以达到480TFlops,支持NVLink,功耗为1500W。

最为值得一提的是,这台DGX-Station是目前业界唯一在工作站采用液冷设计的产品,与传统风扇冷却的设计相比,DGX-Station非常静音,整个机器的噪音只有35分贝,可以在安静的办公室中使用。

根据英伟达介绍,DGX-Station的开发用了将近一年时间。在英伟达刚刚开始投入于高性能计算领域时,就发现有很多科研教授们非常需要这样一台类似这样的机器来开展研究工作。

DGX-Station对用户的吸引力很大一方面源自其一体化的解决方案,用户买回去的电脑里已经预装了高性能计算的系统和软件,开机后只要经过简单设置,就可以用Caffe、TensorFlow等做深度学习的训练(比如图像及语音的识别)、又或者是高精度图像的渲染、科学计算等传统HPC应用,不需要自己再去装驱动、配置环境,很适合高校、研究所、以及IT力量相对薄弱的企业。

四、DeepStream:30路高清视频实时处理

(Discovery Live实时CAE工程仿真的软件Demo)

此外,智东西还在英伟达展位上看到几个与HPC及AI相关的软件应用Demo:比如由Ansys公司和NVIDIA经历4年时间研发的Discovery Live实时CAE工程仿真的软件;基于星际争霸训练出来的GANs网络超视频分辨率软件等。

其中一个名为DeepStream的软件尤为值得一提。它能够实时处理30路高清视频的编解码,并且——由英伟达创始人兼CEO黄仁勋,粉丝昵称“老黄”——亲自命名。

目前AI在安防、人脸识别、车辆识别中有着广泛应用,开发者通过使用自己训练好的深度神经网络算法,可以视频中识别出感兴趣的行人或者物体。

不过,视频数据通常是不同格式的编码形式保存,将其输入AI网络前要进行解码处理;而且,不同网络在GPU上的性能优化也需要用户的进一步调校,最终应用(Inference)阶段的AI网络也需要用户在线上进行部署……

英伟达高级技术经理赖俊杰博士向智东西介绍道,利用这款DeepStream SDK,用户可以快速的把他的AI模型产品化。在使用时,用户只需要把训练好的模型接进来,然后再将源视频输入进来,接着将会由DeepStream负责解决剩下所有的解码、性能优化、部署等种种环节。

这款软件主要由英伟达的中国团队完成集中开发,研发耗时大约有4-5个月左右。英伟达透露,后续根据不同合作伙伴的不同的需求,英伟达也会在现在DeepStream的基础上不断的增加新的功能。