智东西11月6日消息,据机器之心报道,11月3日,来自无问芯穹(Infinigence-AI)、清华大学和上海交通大学的联合团队提出了一种新方法FlashDecoding++,可以将GPU推理提速2-4倍,且同时支持英伟达和AMD的GPU。该方法的核心思想是通过异步方法,实现注意力计算的真正并行,并针对“矮胖”矩阵乘优化加速Decode阶段的计算。

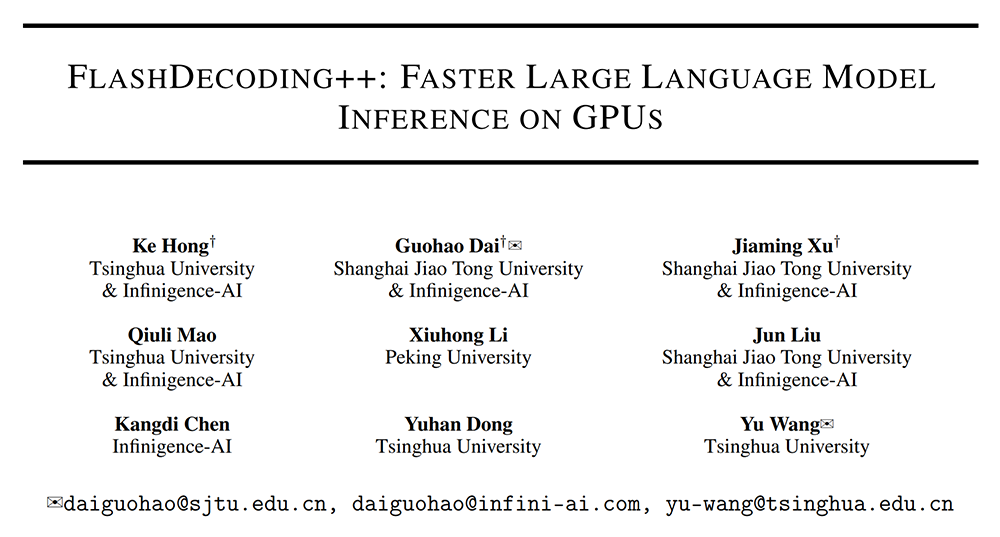

据悉,该研究的三位共同一作分别是无问芯穹首席科学家、上海交通大学副教授戴国浩博士,无问芯穹研究实习生、清华大学硕士生洪可,无问芯穹研究实习生、上海交通大学博士生许珈铭。通讯作者为上海交通大学戴国浩教授和清华大学电子工程系主任汪玉教授。无问芯穹创立于2023年5月,目标是打造大模型软硬件一体化最佳解决方案,目前FlashDecoding++已被集成于无问芯穹的大模型计算引擎Infini-ACC中。

论文地址:

https://arxiv.org/pdf/2311.01282.pdf

13

13