智东西(公众号:zhidxcom)

文 | 寓扬 心缘

今天,OpenAI在大洋彼岸推出了一个重磅AI语言模型,编起故事来已经达到以假乱真的地步,完全让人看不到背后竟然是一个AI。

不信你看!

当人类随意告诉AI一句信息:今天,一辆载有核材料的火车车厢在Cincinnati被盗,至今下落不明。

AI便顺着这一情景,一本正经的创作了:

事故发生在市中心的火车线路上,该线路往返至Covington和Ashland车站之间。

在一封发给俄亥俄州新闻媒体的电子邮件中,美国能源部表示,他们正在与联邦铁路管理局合作,寻找窃贼。

“这些核材料被盗,将会对公众、环境健康、我们的劳动力和国家的经济产生重大负面影响”,美国能源部长Tom Hicks在一份声明中表示,“我们的首要任务是确保盗窃物品的安全,确保此类事情不再发生。”

▲GPT-2编造的新闻

一篇假新闻就这么诞生了!然而却写的文笔流畅、毫无违和感,让身为文字写作者的我感到汗颜。

OpenAI在推特上表示,这是他们训练的一个无监督语言模型,它可以生成连贯的段落,进行阅读理解、机器翻译、问答、撰写摘要等,并且所有这些都不需要特定任务的培训。

它的名字叫GPT-2,让我们一起看下这个语言模型背后的魅力吧。

一、逼真的AI段子手

几个月前谷歌推出BERT语言模型,其3亿参数刷新了11项纪录,引行业一片关注后。

而今天OpenAI推出了一个大规模的无监督语言模型,将其命名为GPT-2。它具有来自800万个网页的15亿数据集,其训练目标就是基于前面给定的文本,从而预测接下来的文字。

正是数据集的多样性,使得这个简单的目标可以很自然的应用在跨领域中,这也是它可以应用在“文字创作”的一个原因。

另一个重点是,GPT-2是一个无监督语言模型,它可以生成连贯的文本段落,并进行阅读理解、机器翻译、问答和撰写摘要,并且所以这些AI能力都不需要特定任务的训练,这可谓是当下AI应用的一大进步。

至于GPT-2效果到底如何,前文已经展示了它写新闻的能力,我们不妨再来看看它讲故事的能力。

同样人类给出一个提示:科学家们有一个震惊的发现,在安第斯山脉的一个偏远且从未探索过的山谷中,生活着一群独角兽。更让人震惊的是,独角兽的英语说得非常好。

于是,AI写手又开始创作了:

科学家曾用它们独特的角来命名这个种群,叫奥维德独角兽。这些四角银白色的物种以前并不为科学界所知。

在经过近两个世纪后,现在,这一谜团终于揭晓。

拉巴斯大学的进化生物学家Jorge Pérez博士和他的几位同伴在探索安第斯山脉时,他们发现了一个没有人的小山谷。Jorge Pérez注意到这个山谷有一个天然喷泉,被两个山峰包围着。

······

Pérez和他的朋友们看到这群独角兽感到非常惊讶,这些生物可以从空中看到,而不需要移动太多——它们离的非常近,以至于可以触摸到它们的角。

当研究这些奇异的生物时,科学家们发现它们可以说一些相当标准的英语。······

Pérez认为,独角兽可能起源于阿根廷,那里的动物被认为是一个失落的种族的后代,这个种族在人类到达南美洲之前就生活在那里。

虽然,这些生物的起源仍不清楚,但有些人认为,这些生物可能存在于人类文明之前的某个时期,在人类和独角兽相遇时创造出来的。根据Pérez的说法,“在南美洲,这样的时间似乎相当普遍”。

······

▲GPT-2编造的故事全文

假如你不知道这是一个AI在“胡说八道”,读完这段话,你是什么反应?

在讲故事时,有起因,有经过,有结果,有大咖做背书论证,AI已经学习到了讲故事的能力。如果不去吹毛求疵细节,从流畅度来说,AI讲故事的能力已经快赶上普通大众了。

推特上少网友表达了对这一文本生成器的称赞,但也有网友表达了对AI带来的假新闻、恶意消息的担忧,称“又一个重要的潘多拉魔盒被打开了”。

▲深度学习之父Hinton的评论

深度学习之父Hinton也在推特上评论道,这应该能让硅谷的独角兽们生成更好的英语了。

二、虽然是通用模型,但专业技能可能让语文老师失业

从技术维度来说,GPT-2就是一个AI文本合成器,当你输入一句话时,该模型就像变色龙一样,生成合适的文风与内容,就如同上文展示的那样。

该模型以无监督的方式在大型数据集上训练了一个Transformer,然后为了获取更好的样本,会在更小的监督数据集上,对已生成的模型进行微调,使得模型更好地适配特定任务。最终测试者输入任意文本给GPT-2,该模型就能为它续写出一段堪比人类写手的文字。

这源于GPT-2拥有15亿个参数,这可是相当庞大的参数量,此前打破11项NLP记录的谷歌最强NLP模型BERT的参数量也不过为3.3亿。

GPT-2是一个基于 transformer的大型语言模型,它是GPT(GPT-2的上一代)模型的扩展版本,其参数和数据量均比GPT模型超出10倍。

该模型的数据集高达40GB,来源于800万个互联网文本。由于数据集的多样性,根据输入内容编写故事只是GPT-2庞大的技能树中的一个枝丫,如果细数GPT-2的专业技能,那可是能让语文老师失业的存在。

例如,在无需使用相关数据集的前提下,GPT-2还能在某些特定领域(如维基百科、新闻或书籍)训练其他语言模型。

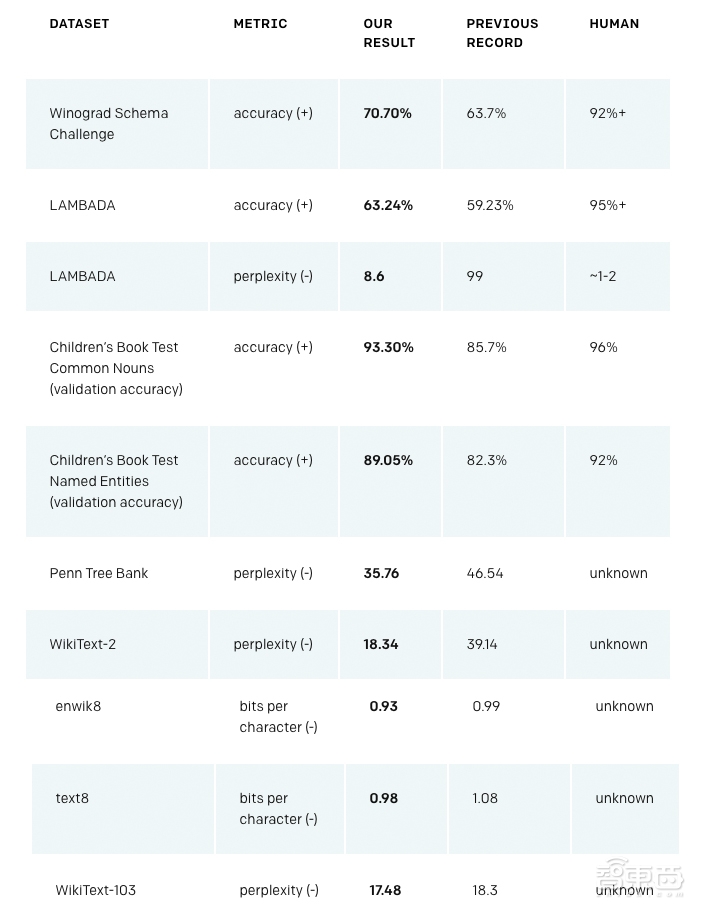

这种设定被称之为“zero-shot”,OpenAI的博客上给出了在这种设定下GPT-2在多个语言任务上所取得的当前最佳成绩。

▲GPT-2 在 Winograd Schema、LAMBADA 和其他语言建模任务中达到了当前最佳结果。其中,(+)表示该领域得分越高越好,(-)表示得分越低越好。

此外,在知识问答、阅读理解、总结和翻译等语言任务上,GPT-2也都可以从原始文本开始学习,并在文本连贯性、流畅性取得不错表现,而不需要使用特定任务的训练数据。

但这一语言模型也存在许多不同,有时候会出现文本重复、建模失败以及不自然的主题切换等问题,比如该模型有时候会写出“火在水下发生”这样的错误语句。这些都是NLP领域一直在努力突破的热点问题。

虽然这些下游任务尚未达到最优水平,但GPT-2表明,如果有足够的(未标注)数据和算力,这些任务均可通过无监督技术取得非常好的结果。

三、一面天堂,一面地狱

这样一个全能型通用语言模型,将会对社会产生怎样的影响呢?

OpenAI给了一些应用方向,比如AI写作助手、无监督语言翻译、更强大的对话机器人、更好的语音识别系统等。

但是,任何先进技术都是一把双刃剑。OpenAI已经开始担忧它可能造成的一些负面影响。

无论是生产虚假新闻、伪造信息、冒充他人、诽谤,还是生成垃圾或钓鱼邮件,都将对网络环境造成极为恶劣的污染。

网民们不得不升级自己的判断能力,对在线文本内容保持更谨慎的怀疑态度,这可能会引发更大的信任危机。

因为担心这一新的技术创新会被人恶意利用,在尚无更好应对措施的情况下,OpenAI决定“仅发布 GPT-2 的较小版本和示例代码,不发布数据集、训练代码和 GPT-2 模型权重”。

这意味着这一模型并不完全开源,围观群众们只能瞻仰这个模型表现有多逆天,却难以做到完全复现。

在如今全球鼓励开源和共享的大潮中,这一不开放完整模型的决定不出意外地引发一些质疑。

Facebook AI首席科学家、深度学习大牛Yann LeCun就在推特上点赞了Kyunghyun Cho的吐槽:“要是这样,我感觉我有义务删除迄今为止自己公开的所有模型权重了。”

来自英伟达机器学习研究负责人Anima Anandkumar的态度更加激烈,直接骂出“Malicious BS(恶意个鬼)”,指责OpenAI站在开源的对立面上,批评它“炒作+传播恐慌+阻碍复现”。

随着AI的深入发展,如何平衡道德与技术的争议又再一次摆在我们眼前,值得深思。

附OpenAI博客连接

https://blog.openai.com/better-language-models/#sample2

附OpenAI非监督语言模型论文连接

https://d4mucfpksywv.cloudfront.net/better-language-models/language_models_are_unsupervised_multitask_learners.pdf