智东西(公众号:zhidxcom)

文 | 心缘

智东西10月31日消息,今日,由北京智源人工智能研究院主办的2019北京智源大会在京举办。

在下午的智能体系架构与芯片专题论坛中,清华大学教授、类脑计算研究中心主任施路平,北京大学教授、智源研究员蔡一茂,中科院半导体所研究员、智源研究员鲁华祥,分别分享了关于类脑神经网络技术及芯片的现状、挑战及研发进展。

此外,中科院计算所研究员、智源研究员韩银河现场分享了其团队在智能控制专用处理器芯片的研究进展,清华大学长聘教授、智源研究员尹首一分享了关于可重构智能计算架构的技术,此前智东西曾多次报道这一技术(清华魏少军:AI芯片2.0,终极智慧芯片 | GTIC2019)。

尹首一教授认为,可重构、超高能效、数模混合等将成为未来AI芯片继续提升算力、降低功耗、提高能耗比的必然发展方向。

一、类脑计算是人工通用智能的基石

清华大学教授、类脑计算研究中心主任施路平首先提到,国家脑计划即将推出,其题目就是脑科学和类脑研究。

人工通用智能发展很快,但同时也面临很多挑战。

如果有充足数据、确定问题、完整知识、静态、单一问题,现代AI系统就能做很好,但超出这些条件,AI将难以实现。另外,AI不可理解、不可解释的特点,一点偏差就可能产生巨大错误。

现在的AI只能解决特定解决方案,就事论事,难以推广,不适用于动态和开放的环境,通常称为弱人工智能。

未来发展方向是人工通用智能技术,通过增加AI系统的鲁棒性和通用性,帮人类举一反三。

人工通用智能早在几十年前就已经提出,但当时受限于算力、数据等因素,并不是发展人工通用智能的最好时机。

那么为什么说现在是好时机呢?施路平教授提及4个因素,随着新型检测设备的发展,人们对脑理解越来越多,似乎到了理解脑的关口;超算发展可以让我们做更好的模拟仿真;大数据云计算提供足够复杂的系统与脑交相辉映;新型纳米器件的发展能提供和人脑差不多级别的能耗。

人工通用智能的研究本质上不同于窄人工智能的集合。而类脑计算是人工通用智能的基石。

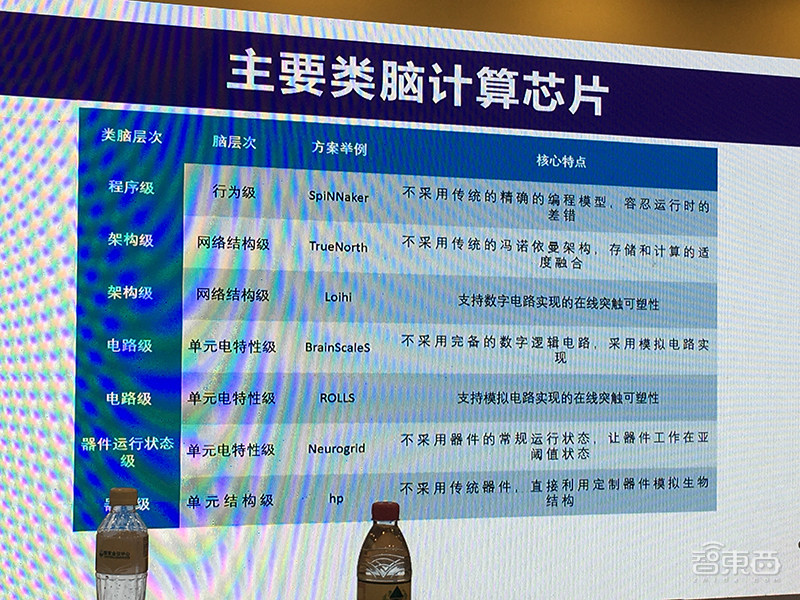

2016年是类脑计算机发展元年,全球同时上线3款类脑计算机,美国的TrueNorth、德国的BrainScales、英国的SpiNNaker,这些技术基于不同思路,使用不同架构。

做这样的研究,真正的挑战不是科学技术,而是我们的教育背景无法支撑这样跨度大的研究。

做计算机科学和脑科学走的是两条技术路线,而要发展人工通用智能的最佳路线,需要做到多学科深度融合。

施路平教授认为,类脑计算的发展方向,现在是基于冯诺依曼架构的传统计算机,未来是走向人工通用智能、类脑架构的类脑计算机。

他提到类脑计算的10个优势,不仅能耗比现有计算机节省3-4个数量级,能实现现在超算做不到的高度并行,做到现有架构无法实现的理解能力、不确定性、通用智能架构,而且其快速学习、小数据、信息深度挖掘、实时动态、残缺数据的能力都比现有系统能力更为强大。

二、现在是类脑计算研究最好的时刻

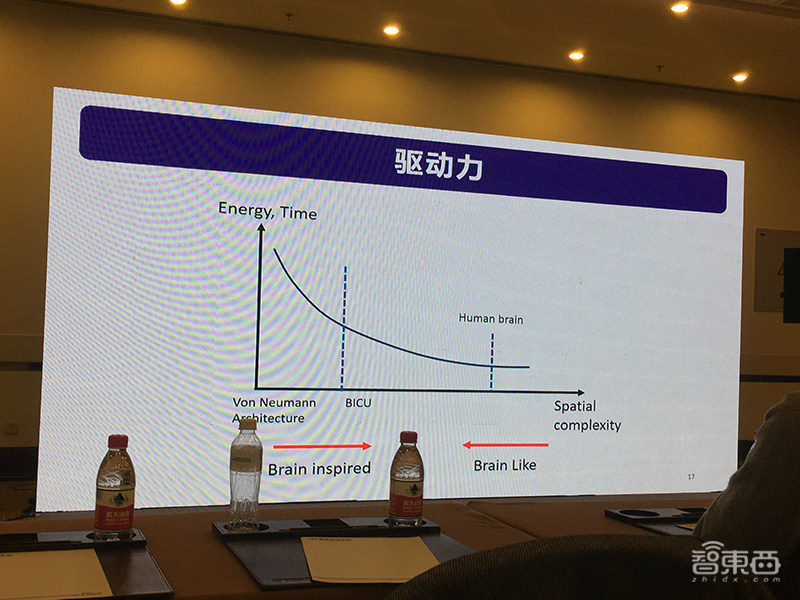

类脑计算从大方向上有两条技术路线,Brain inspired和Brain Like。

图灵奖得主、计算机体系结构宗师David Patterson与John Hennessy认为,未来十年是计算机架构发展的黄金十年。

目前这一领域是春秋战国,对研究而言是最好的时刻。施路平教授将主要类脑计算芯片分为7个层次。

清华大学类脑计算研究团队过去七年一直在做的事情就是融合。美国脑计划负责人之一、惠普公司威廉博士认为,清华团队是类脑计算研究领域全球最好的团队,他将用这个中心的模式组建美国的项目。

清华类脑计算研究的目标是发展支撑人工通用智能研究的类脑计算和系统。

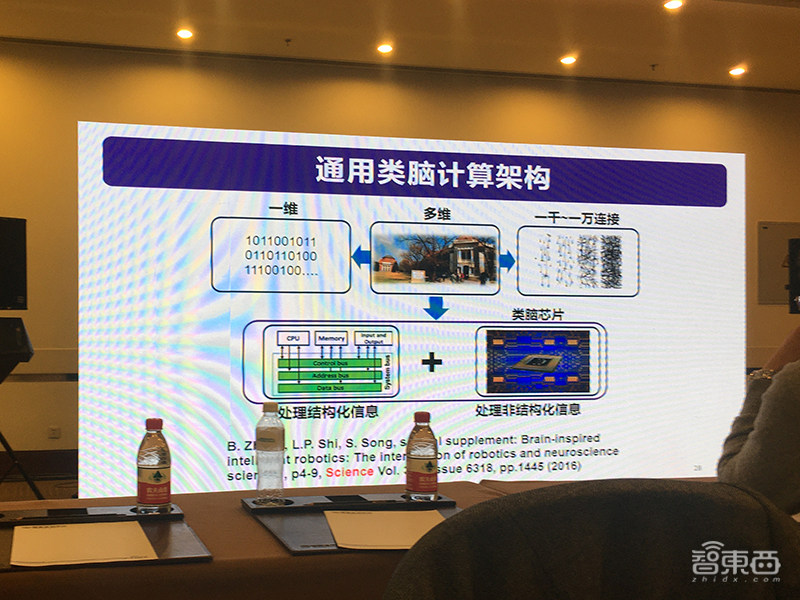

类脑的精髓是方向感,通用类脑计算架构的难点是算得快、算得省、算得了,这需要理论、芯片、软件、系统协同发展。

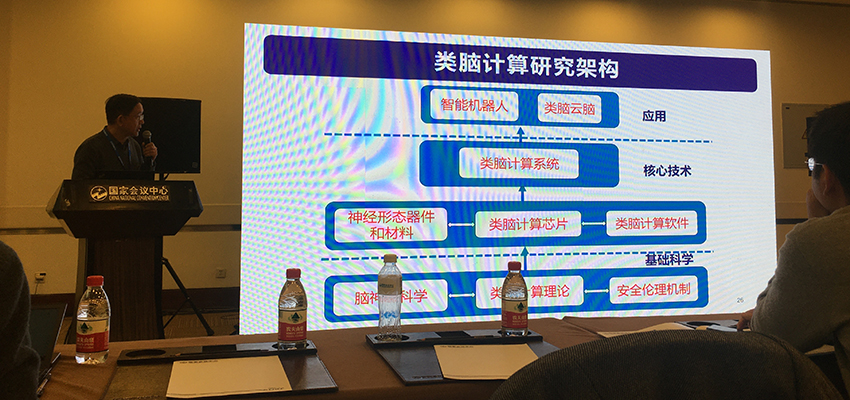

要研究类脑计算,应从基础科学、核心技术、应用三个层面来看,同时也要关注安全与伦理。

施路平教授认为,现在所有技术发展最好能有一个roll,能得到很好的反馈。发展类脑计算面临的首要问题是,不理解人脑机制的情况下如何发展类脑计算系统。

为什么人看一眼就能理解图片内容,而计算机却做不到?问题的关键是相关性丢失。

脑利用的是空间复杂性,将相关性增加。另外,用时间脉冲编码又利用了时间复杂性。三年前,《Science》出智能机器人特刊,施路平教授将这一解释发表出来。

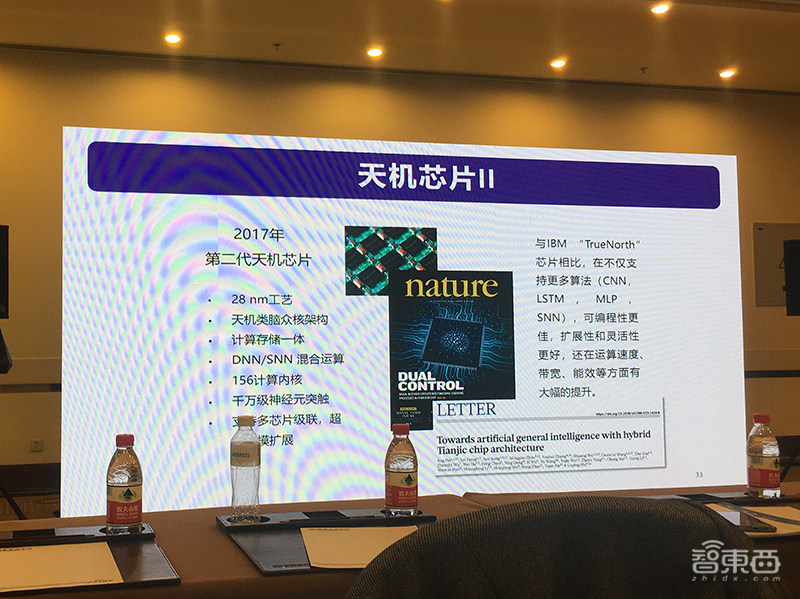

基于其异构融合的类脑计算架构,清华大学研发出天机芯片,相比IBM的True North,不仅支持更多算法,且密度提高20%,速度快10倍,带宽提升100倍,精度可调,扩展性和灵活性也更好。清华研究团队还为之打造了专门的软件工具链。

天机芯片已经被应用于类脑无人自行车,施路平教授表示,这取决于三个条件,多模态、可与环境交互、可扩展。据他回忆,他们曾被《Nature》拒绝了两轮,施路平告诉学生,不是为了发表文章,而是向他们学习。最终《Nature》接受了他们的想法。(重磅!清华类脑芯片登上Nature封面,已成立公司,颠覆冯诺伊曼)

目前,清华大学类脑计算研究团队在内部已搭好第一代类脑计算机及集群,形成回路并快速迭代。施路平教授表示,随着更多类脑计算机启动后,他们会做一个类脑计算云脑(开源社区)。

这样强大的类脑计算能赋能哪些应用呢?施路平教授说,如果实现人工通用智能,类脑计算可以应用到互联网、数据中心、智慧城市、智能教育、智慧医疗、智能家居、自动驾驶、智能机器人等各行各业。

三、神经拟态器件选择有很大空间

北京大学教授、智源研究员蔡一茂则重点从神经拟态器件进行分享。

硬件是AI发展的关键瓶颈,AI芯片研究成为热点。

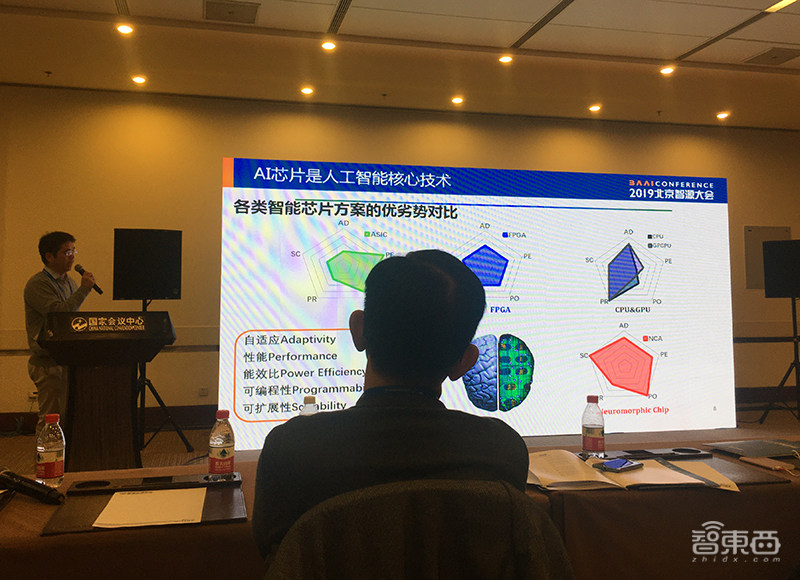

当前各类智能芯片方案的优劣性对比,可从自适应、性能、能效比、可编程性、可扩展性五个方面来看。ASIC的性能和能效比更强,CPU和GPGPU强在自适应和灵活可编程,FPGA在五方面的综合表现更为均衡,而神经拟态芯片在可扩展性、能效比、自适应、性能上都非常出色。

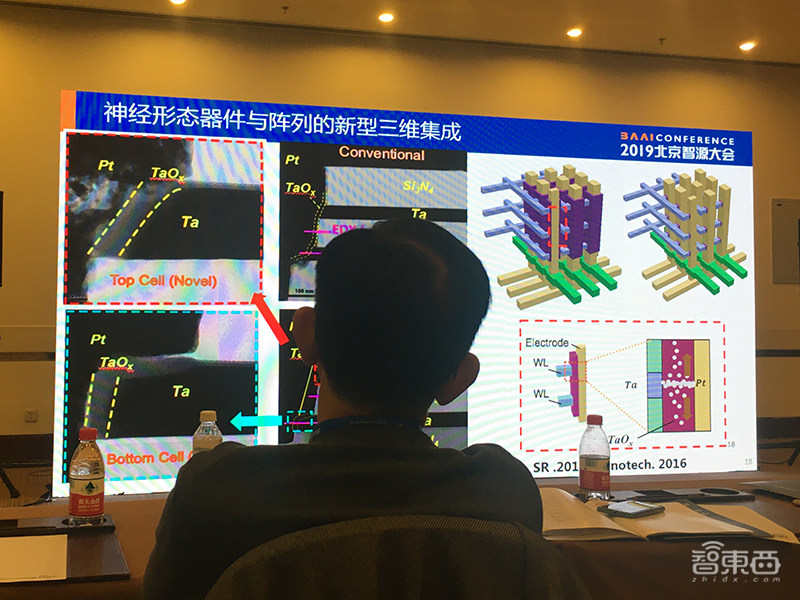

在这一背景下,神经拟态器件/阵列/芯片成为研究热点。基于忆阻器等神经形态器件及其类脑架构具有重要意义,器件选择还有很大的空间。

除此之外,蔡一茂教授还核心谈了两点。

一是能否大规模集成式关键,如何进一步减小器件种类,提高集成密度。

二是关于类脑应用的挑战及解决方案,即需要实现从器件及系统(算法)的协同设计。

对于神经形态计算系统而言,面临的一大挑战是缺少像MOSFET一样的标准化器件,这增加了电路实现的复杂性,EDA工具的设计变得复杂,阻碍了大规模神经形态计算系统的发展。

而在多功能神经形态器件中,离子输运和电子输运分别对应两类驰豫过程。离子输运既有长驰豫时间,可模拟有记忆效应的突触和神经元的积累过程;电子输运具有短驰豫时间,可模拟无记忆效应的开关和神经元的发放过程。

基于CMOS工艺的类脑芯片采用NOC多核设计,随机LIF神经元模型,设计规模单芯片神经元数目为10^6个,突触数目为10^9个。

该芯片具有很好的通用性,可支持MLP、CNN、RNN等主流神经网络模型,也可支持通用智能任务中的特定算法。

其灵活性体现在支持对神经元及突触参数的点对点配置,可在有效推断间隙实现快速参数更新。

另外,该芯片还具有生物性,支持生物时空编码,可实现复杂类型生物脉冲及任意周期的脉冲振荡环,可有效支持生物计算模型。

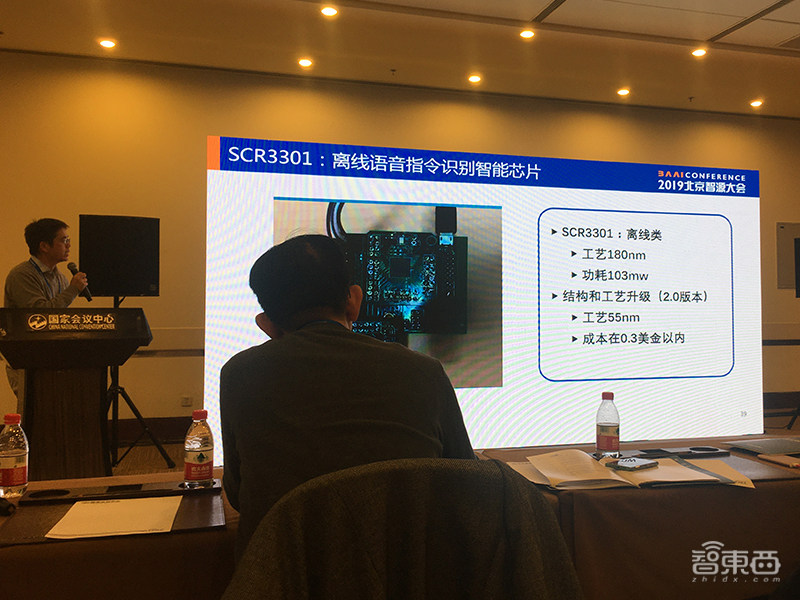

在此基础上,北大研发了离线语音指令识别智能芯片SCR3301,支持语音命令词识别、30个可配置命令,识别响应不到0.2秒,且单芯片无需启动配置,无联网约束,可应用于电动交互类、控制类玩具、便携式电子娱乐设备以及中小型家电设备。

四、类脑神经网络技术及其应用

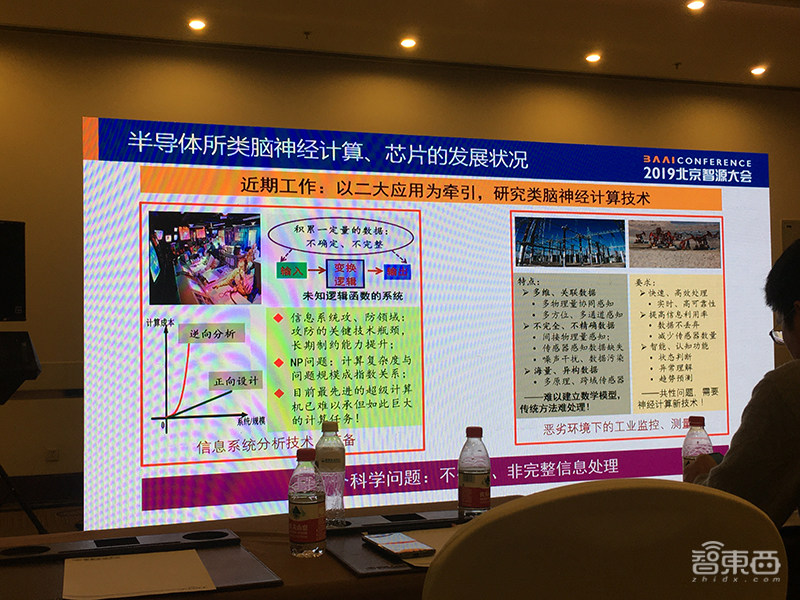

中科院半导体所研究员、智源研究员鲁华祥谈到,信息处理技术发展面临性能、能耗、可靠性、容错性等方面的问题。

应对这些挑战,创新芯片结构及运算方式应运而生,芯片成为AI技术发展的核心推动力。

与此同时,集成电路发展也面临着摩尔定律和微纳电子器件瓶颈所带来的的问题。

随着摩尔定律日益放缓,器件尺寸和芯片功耗接近极限,目前集成电路特征尺寸已达3nm,规模工业生产达到7nm。

采用7nm工艺、集成了69亿个晶体管的华为麒麟980芯片,研制周期长达3年,花费数十亿美元,1000多位高级半导体专家参与,进行了5000多次的工程验证。

新型纳米电子器件研究也在持续推进,半导体所利用的Si基或GaAs、InP基III-V超晶格量子阱材料,发展了多种纳米电子器件。

而生物神经网络是缺陷容错和噪声容错的系统,这带来一种新的思路,将微纳电子器件研究与类神经网络研究相结合,集成新形态结构的芯片。

目前,类脑神经计算在国外用以解决下一代信息处理问题,以更低的功率开创全新计算机应用。欧盟、美国、日本、澳大利亚、加拿大、韩国均提出脑计划。

“中国脑计划”是我国六个长期科学项目之一,分为脑科学和类脑科学两个部分,主要有两个研究方向,一是以脑疾病为导向的脑科学研究,二是以建立和发展AI技术为导向的类脑研究。

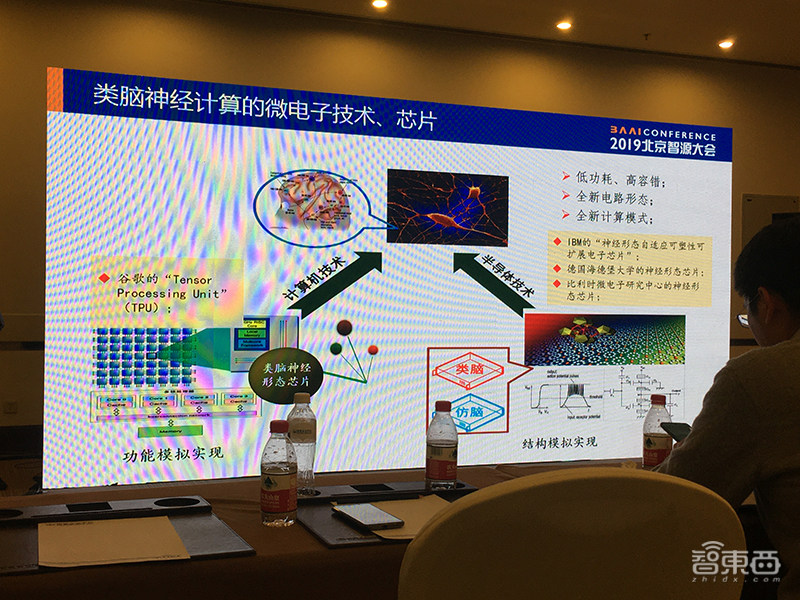

类脑神经计算目前有两种主流的实现路径,一是以谷歌TPU为代表的功能模拟实现,二是以神经拟态芯片为代表的结构模拟实现。

鲁华祥还介绍了半导体所类脑神经计算、芯片的发展状况。其实验室在1990年王守觉院士于原“新器件、新电路”研究室基础上创立,面向计算方法、技术应用和芯片系统三大方向,取得一系列科技成果。

半导体所借鉴人脑的信息处理机制进行类脑神经计算的算法和芯片研发,聚焦于“多权值”神经元模型和电路实现、串并行计算架构、局部字域结构、分布式异步控制技术、神经元集群架构设计等芯片关键技术。

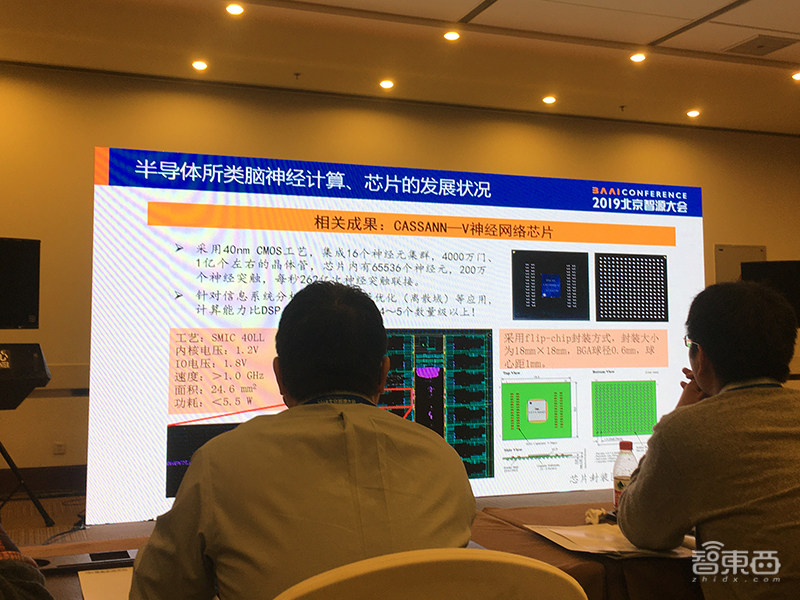

芯片方面,半导体所已研发出CASSANN系列类脑神经计算芯片,采用40nm CMOS工艺,集成16个神经元集群,4000万门、1亿个左右的晶体管,芯片内含65536个神经元,200万神经突触,每秒262亿次神经突触连接。

半导体所也研发了基于CASSANN-X的类脑神经计算系统,用以解决福州最优化问题。其成果已经应用在智能电网监测等“不确定、非完整信息”问题。

未来,半导体所将进一步研究三个方向,一是不精确、非完整信息的类神经计算技术和系统,二是高性价比的类神经计算芯片、系统和设计技术,三是缺陷容错和噪声容错的电路集成技术。

结语:AI芯片未来有更多可能

国内外类脑神经计算的相关研究都在持续开展中,从今天的分享中,我们看到了来自国内多个研究团队所做的努力和成果。

但目前类脑神经计算技术仍主要在研究阶段,仅有少数落地成果,距离大规模落地和实现人工通用计算还有距离。

在圆桌论坛期间,中科院计算所研究员、智源首席科学家陈云霁分享了他对AI芯片未来的畅想。

陈云霁说,科学问题是过去时,智源看的是将来时。他认为,未来中短期的变化是定义好领域,自动化用EDA等工具实现快速生成;更长远来看,有可能从头到尾无人干预地由计算机设计出一款芯片,或许有一天神经网络能设计出一款神经网络芯片来。

这一畅想虽然乍一听似乎很遥远,但在研究人员们的努力下,这在未来未必会是天方夜谭。