智东西(公众号:zhidxcom)

编译 | 熊大宝

编辑 | 李水青

智东西4月9日报道,近日,剑桥大学研究人员创建了一款Emojify游览器小游戏,以此证明AI情感识别技术存在局限性。

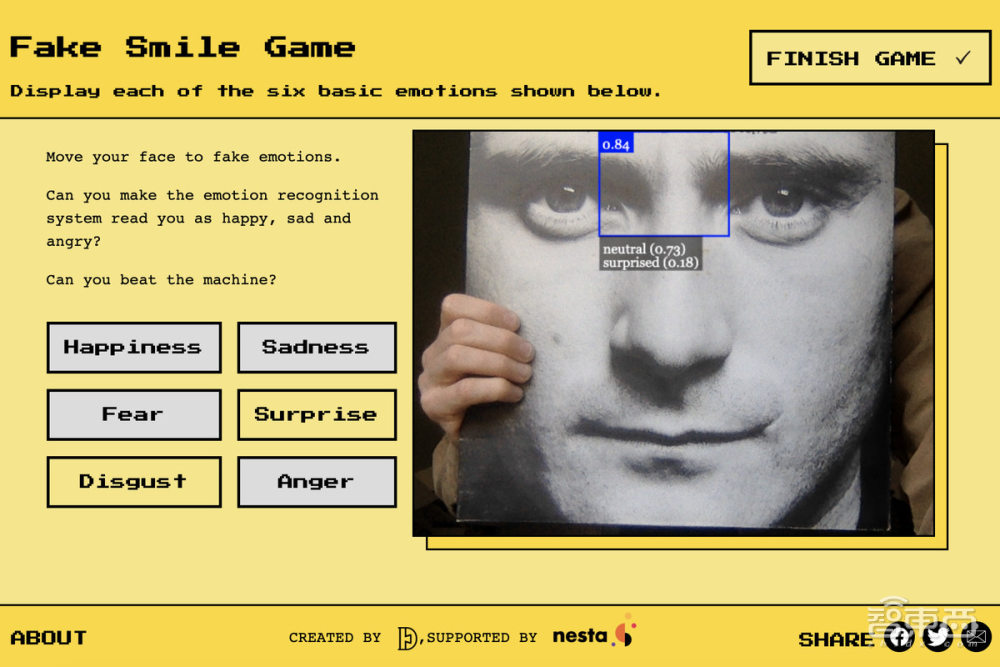

Emojify项目包括假笑和眨眼游戏,用户可通过摄像头进行表情变化,AI尝试识别人类快乐、悲伤、恐惧、惊讶、厌恶和愤怒六种情绪,但通常不那么准确。

游戏链接:https://emojify.info

一、假笑游戏:你是不是真正快乐,AI不关心

玩这个游戏时,你会发现这个软件很容易戏弄。

游戏引导你做出快乐、悲伤、恐惧、惊讶、厌恶和愤怒六种情绪,通过AI的识别反馈,让用户了解AI情感识别技术的不足。当你假笑时,它会误以为你很快乐。

笔者也好奇试了一番。当我张开嘴打哈欠时,AI感觉我在惊讶(surprised);当我可爱状嘟嘴时,AI认为我伤心中带着一丝生气(sad、angry);当我抿嘴时,AI认为我生气中带着厌恶(angry、disgusted);当我面无表情时,AI显示neutral(中性)。我不禁苦笑,感慨道:你的真情,AI不懂!

Emojify项目的领导者亚历山·哈格蒂(Alexa Hagerty)教授说:“AI情感识别技术的前提是,我们的表情和内心感觉以一种非常可预测的方式相互关联。如果我笑,我就开心,如果我皱眉,我就会生气。”

这个游戏想要表达的便是,AI情绪识别系统虽声称可以从你的表情读出情绪,但实际大多数情况下,我们内心体验到的情感和我们展现给世界的面孔之间往往存在着脱节。

例如,当有人哭泣时,他们可能是因为悲伤而哭,也可能因为喜悦而流泪,人类情感是复杂的,我们对情感的体验都不一样。

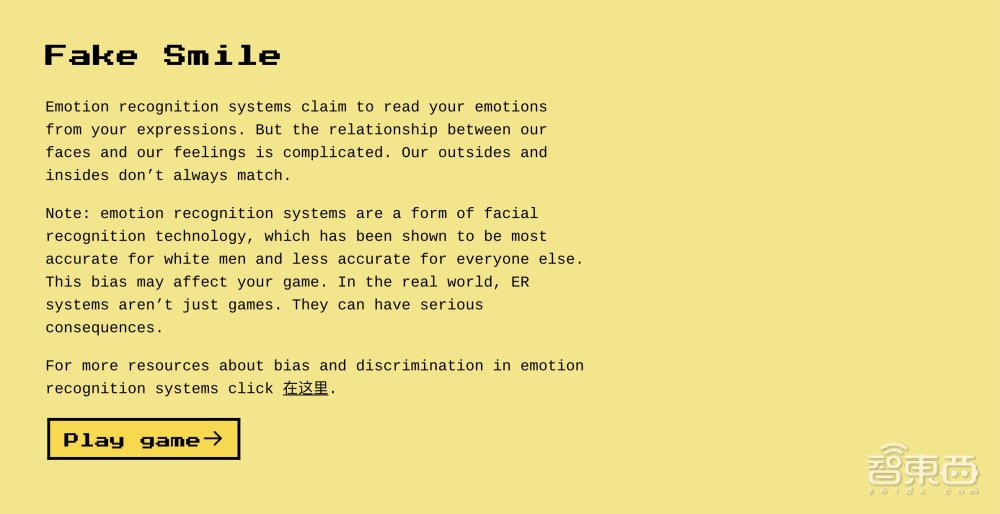

AI情绪识别系统将人类某一刻的感受提炼成一组简单的表情符号是可能的,但这和所有的人脸识别技术一样,可能存在种族偏见问题。

最近的一项研究发现,像Face++这样的程序通常会把黑人的脸评为比白人更愤怒、更不快乐,而不管他们的实际表情如何。

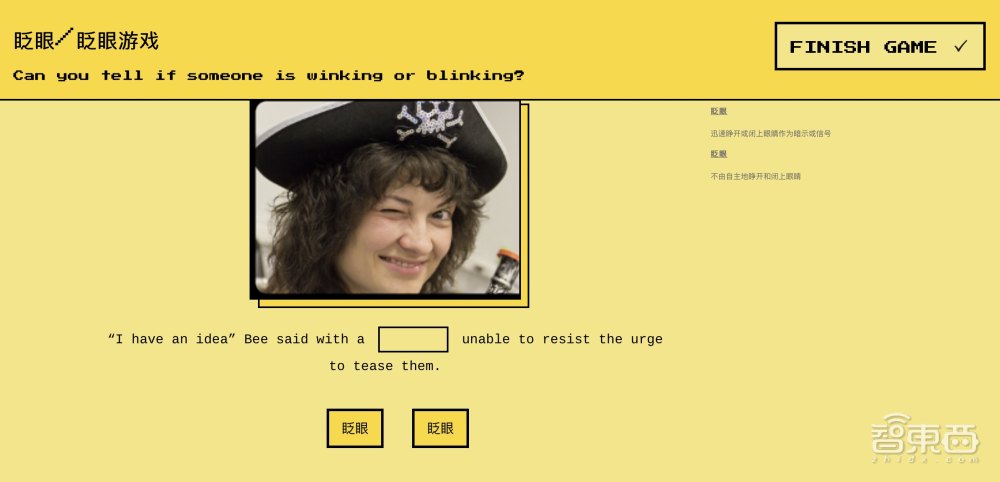

二、眨眼游戏:wink还是无意义眨眼?傻傻分不清

Emojify的第二个小游戏会给用户许多图片,让用户判断图片中的人物是有意眨眼(wink)还是无意眨眼(blink)。

wink英文解释为“迅速睁开或闭上眼睛作为暗示或信号”,常常代表可爱、挑逗的动作。blink则为“不由自主地睁开和闭上眼睛”。

当你全部判断完毕并且正确率高时,小游戏会跳出恭喜界面:“恭喜你!你可以读懂面部表情,这是AI情感识别系统无法做到的。你是抵制表情符号的一份子!”

哈格蒂说:“眨眼可以是一个无意识的动作,也可以是有意义。”在关于人物眨眼的游戏判断中,人类也会犯错误,但机器的缺陷更直接。

首先,机器不能像人类一样结合表情等其他面部线索识别判断一个眨眼有无意义。其次,机器经常做出人类难以更正的自动化决策,在我们不知情的情况下大规模地进行监控。此外,AI情绪识别系统还可能存在种族偏见。

所有这些因素都使得AI情感识别比人类读懂他人情感的能力要麻烦得多。

哈格蒂说:“人类之间的错误沟通,我们有很多选择来纠正。但是,一旦这样的错误沟通自动化,我们就很难变更和补救。”

结语:AI情感识别技术尚未成熟

AI情感识别技术尚未成熟,但它正变得越来越普遍。它不仅仅用于游戏,还可用于求职者筛选、护照安全评估等,各种组织和政府都在使用它,甚至苹果公司也曾在这一领域收购了一家初创公司。

Emojify项目通过展示情感识别软件的缺陷,希望能引发人们对其使用的讨论。开发团队表示:“我们的目标是促进公众对这些技术的了解,并促进公民参与这些技术的开发和使用。”“我们相信,通过集体智慧和观点分享,我们可以赋予社区权力,促进一个公正和公平的社会。”

来源:The Verge、Engadget