智东西(公众号:zhidxcom)

文 | 心缘

这家AI芯片创企已经潜伏近三年了。

2016年底,谷歌TPU核心团队的十个人中,有八人悄悄组队离职,合伙创办了新公司——Groq。

谷歌TPU,AlphaGo击败世界围棋冠军背后算力的核心功臣,一战成名,带动起全球专用IA芯片市场的火热。它的核心设计人员外出创业,毫无疑问被外界视作无法忽视的存在。

明知被产业热切地关注着,这家创企却相当任性,在官宣要在2018年发布第一代AI芯片后,它就再次进入神隐状态,任你外界怎么猜测,我自岿然不动。

这一神隐就神隐到了今年9月。Groq被曝将参展美国计算机历史博物馆举办的AI硬件峰会,多少人正期待Groq成为这场峰会的最大热点时,Groq又相当任性地撂挑子不干了,空留其logo显眼而尴尬地留在了横幅上。

▲在AI硬件峰会上的Groq徽标和空椅子(图源:Tirias Research)

10月21日,Groq突然更新了博客《世界,认识Groq》。这一篇博客,似乎在无声地宣告,Groq即将要高调地回归大众视野。

一、预告400TOPS算力的芯片

2017年还算是Groq有点活跃的一年。

3月,Social Capital风险投资家、前Facebook高管Chamath Palihapitiya告诉美媒,他花了1.5年招揽谷歌TPU背后的工程师。

4月,Groq被报道拿到由Chamath Palihapitiya领投的1030万美元启动资金,这是Groq第一次出现在公众视野。

7月,赛灵思前全球销售执行副总裁Krishna Rangasaye加盟Groq,担任首席运营官(COO),不过现在Groq的COO已变成Adrian Mendes。

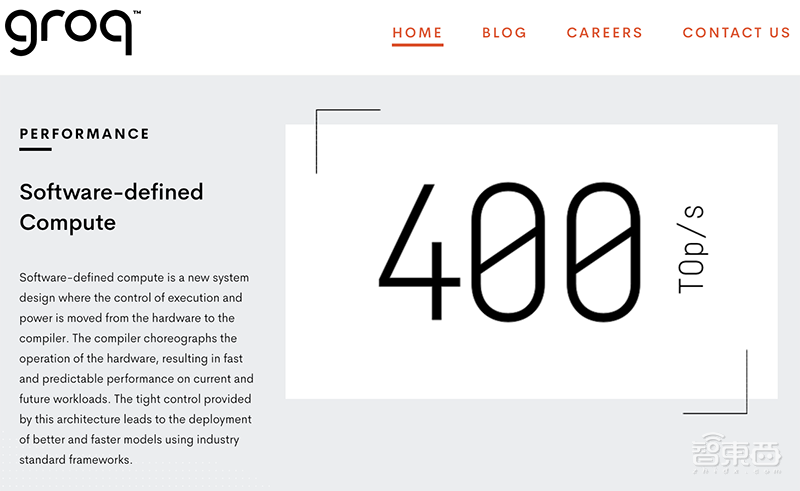

11月,Groq在官网宣布要在2018年发布第一代AI芯片产品,号称这款芯片的运算速度将可以达到400 TOPS,每瓦特能进行8万亿次的运算。

而当时谷歌最新一代的TPU算力才达到180TOPS,这意味着Groq性能将超谷歌TPU两倍还多。

而此时距离Groq成立才短短一年,如果搁在其它创企身上,可能还会被质疑是说大话,偏偏Groq由Google X的前工程师道格拉斯·怀特曼(Douglas Wightman)和乔纳森·罗斯(Jonathan Ross )等共同创立。早期谷歌TPU团队的十位核心成员中,有八位都来到了这家公司。

▲Groq创始人兼首席执行官Jonathan Ross

包括CEO 乔纳森·罗斯(Jonathan Ross)在内的Groq创始团队,是早期TPU十人核心设计团队中的八人。

谷歌曾在短短约14个月的时间里发布首个TPU,Groq能在超短时间内展示其芯片似乎也不是什么难以理解的事情。

二、沉寂一年,突然回归

然而,在无数人的翘首以盼中,Groq却并没有如期亮出它们打磨的核心利器。

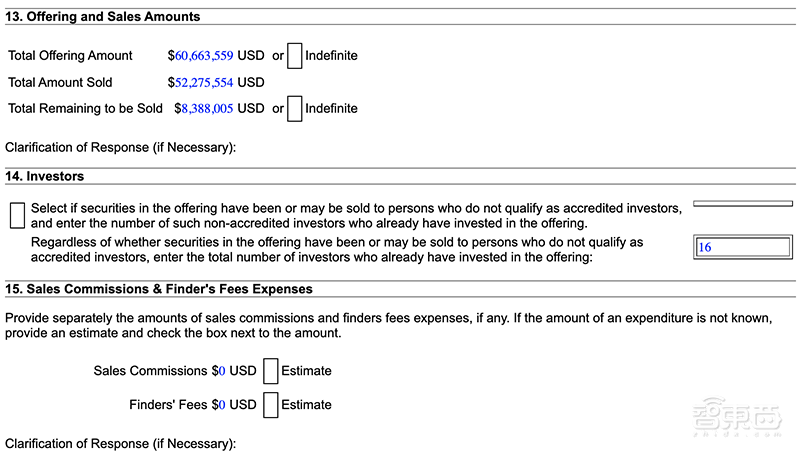

时间一晃而逝,转眼到了今年9月,美国证劵交易委员会公布了一项文件,显示Groq正目标筹集约6000万美元的资金。这一文件显示它已经融资超过5200万美元,至少有16位投资方为这新的一轮融资做出贡献。

同样在9月,当大家都以为Groq要带着它的芯片产品一起露面了,它又出人意料的“放了AI硬件峰会的鸽子”。

当美媒终于联系上Jonathan Ross,他的回复却显得些微轻描淡写。

“我们有一句话:展示,不要告诉。”Jonathan Ross说,他们本打算在AI硬件峰会上做演示,但他们不得不将资源转移给客户,无法进行演示,因此他们决定退出。

或许正如Jonathan Ross所言,Groq的AI芯片产品已经获得客户的认可,Groq终于开始主动揭开神秘的面纱,以博客的方式陆续透露出关于其芯片产品差异化的拼图。

在Groq官网的首页,Groq芯片的性能显示为400 TOPS,但除了知道这是INT8计算的最高性能,可以处理整数与浮点运算外,我们尚未得知要达到这一性能还有哪些其他条件。

有趣的是,尽管Groq创始团队脱胎于谷歌TPU团队,但他们既没有在谷歌TPU,也没有在GPU、GPU、FPGA等架构上做迭代,而是尝试一种新的体系架构。

▲截至目前,Groq拥有70名全职员工,已筹集了6700万美元的资金

三、AI推理需要更简化、更可扩展的架构

当前,处理器架构的复杂性不仅阻碍开发人员生产力,也阻碍着AI应用程序和其他计算繁重工作负载的采用。

在Jonathan Ross看来,由于对传统服务器群集的投资已达到计算成本壁垒,处理推理任务的目标时获得大量的并行吞吐量,而现有的设备已经被挤得水泄不通,即便增加物理处理器的数量,也无法实现更快、更有效的神经网络处理。

同时,CPU、GPU等标准计算体系结构挤满了硬件功能和元素,这些硬件和元素对推理性能没有任何帮助。为了每秒执行越来越多的操作,芯片变得越来越大、越来越复杂,具有多个内核、多个线程、片上网络和复杂的控制电路。

为了提高软件性能和输出,机器学习模型的开发人员要面对复杂的编程模型、安全问题,以及由于处理抽象层而导致的对编译器控制的可见性的丧失。

另外,据Ross回忆,谷歌Jeff Dean在TPU推出前曾做过数学运算,分享说他们虽然可以训练生产级别的模型,但由于价格太昂贵,他们无力使用现有架构来部署它们。

“如果他们要为所有人部署语音识别,那么谷歌必须将数据中心的数量增加2-3倍,再增加20到40个。这些成本以十亿计。如果您仅出于语音识别的目的,以另一种方式对运算成本进行数学计算,则他们必须将其计算能力提高一倍。”

要在这些约束条件下获得更高的机器学习性能,需要依靠对硬件体系结构有深入了解,并进行费力的手动优化。

面对这一现状,Groq专门针对机器学习应用程序和其他计算密集型工作负载的性能要求,设计了一种更简化、更可扩展的新型处理体系结构,以提供更高的吞吐量和更易用性。

这种新架构降低了传统开发的复杂性,使得开发者可以专注于算法,而无需考虑让其解决方案适应硬件,从而节省了开发人员资源,也使大规模部署AI解决方案变得更加容易。

四、Groq高性能架构的三大特点

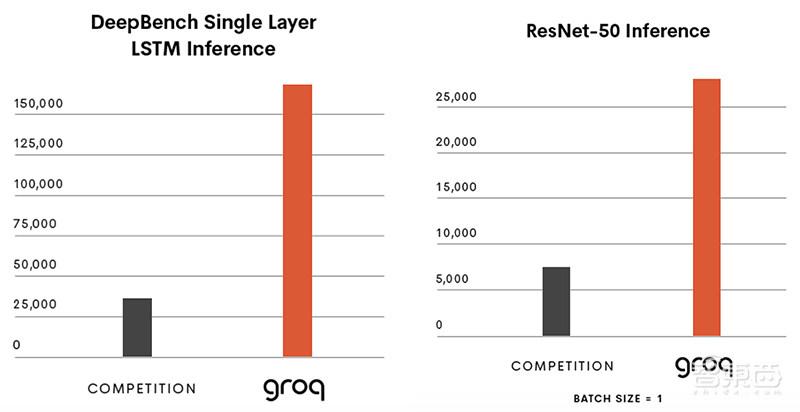

根据Groq的博客,Groq芯片是通用深度学习推理芯片,是高性能、低延迟、计算密集型工作负载的理想平台。

具体而言,其高性能架构的愿景基于技术创新的三个关键领域:

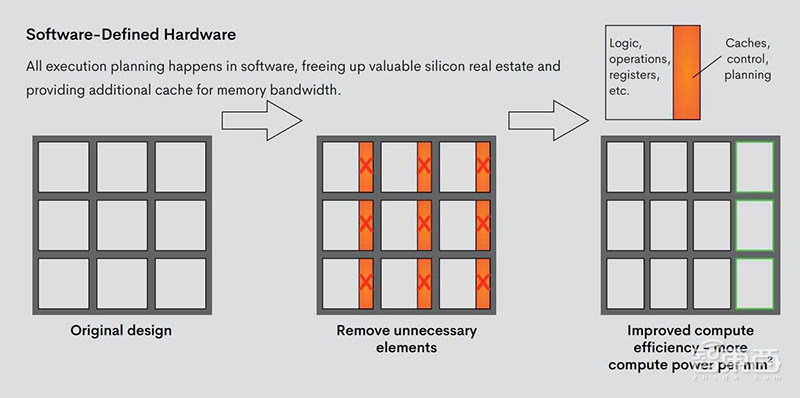

1、软件定义的硬件

受软件优先思想的启发,Groq将执行控制和数据流控制从硬件转移到了编译器。

所有执行计划都在软件中进行,从而释放了宝贵的硅空间,并提供了额外的内存带宽和晶体管来提高性能。

软件从本质上协调所有所需的数据流和时序,以确保计算不会发生停顿,Groq的芯片允许在编译时预先知道所有延迟,从而使延迟和性能可预测。

2、芯片创新

Groq的简化架构从芯片上去除了对AI没有任何处理优势的多余电路,从而实现了更高效的芯片设计,每平方毫米的性能更高。

这消除了对缓存、核心到核心通信、推测性和无序执行的需求。

Groq的芯片将大量的算术逻辑单元(ALU)与大量的片上存储器结合在一起,并具有超过60TB/s的充足带宽来输送给大量ALU。

根据EETimes看到的幻灯片显示,其芯片中三列ALU与两个大内存条交错,ALU约占芯片面积的40%,内存接近芯片面积的50%。

通过增加跨芯片总带宽和用于计算的晶体管总数的更高百分比,可以实现更高的计算密度。

3、最大程度提升开发速度

Groq系统体系结构的简单性消除了手工优化,配置文件和主导传统以硬件为中心的设计方法的专业设备知识的需求。

相反,Groq专注于编译器,从而使软件需求能够驱动硬件规范。其编译器已经设法将编译时间压缩至秒。

在编译时,开发人员可以精确获知内存使用情况、模型效率和延迟。

这听起来可能不是特别重要,但随着芯片规模扩大,在数据中心进行扩展会变得更困难,假设扩展到数千个芯片,如果有一个因为延迟慢了,那么有60%的机会每一个查询都将是慢的。

Groq芯片的这种确定性设计,意味着用户可以在将多芯片扩展连接时,精确把控运行一次计算需要多长时间,使得用户可以更加专注于算法并更快地部署解决方案,从而简化了生产流程。

四、像,但不是FPGA

虽然软件定义的硬件与确定性操作相结合的概念可能使人想到FPGA,但Jonathan Ross强调,Groq的芯片绝对不是FPGA。

Ross表示,FPGA可在每个周期重新配置,这与他们的芯片工作原理相似,但Groq的芯片不是FPGA,它没有查找表,用户可逐周期完全更改芯片的功能,能确切知道芯片的每个部分在任何时刻都在做什么,这种控制级别非常精细。

此前另一家长期隐身的AI芯片创企SambaNova也有提出软件定义硬件的概念,他们正在开发可重构的数据流体系结构并致力于用于编程加速器的语言。

在Tirias研究首席分析师Kevin Krewell看来,Groq的方法与常规FPGA和SambaNova的方法就是很像,而且他对迄今为止Groq所分享的内容表达一些担忧。

Kevin Krewell担心的是其每平方毫米的效率计算,设计是静态编译的,这意味着一次只能处理一种类型的机器学习算法,而某些任务需要多种不同的机器学习模型,比如图像处理和语音处理。

五、目标AI推理,适合自动驾驶与金融

Groq工程部副总裁Michelle Tomasko表示,有硅片后,他们第一天就上电了,第一周就在芯片上运行了程序,六周后又向客户提供了样品。

Tomasko详细介绍了TSP的确定性将如何改善客户的系统验证时间,并补充说,能够在芯片推出之前就很好地交付编译器的功能,意味着客户可以成功地将他们的模型面向TSP的体系结构。

▲Groq工程部副总裁Michelle Tomasko

在加入Groq之前,Tomasko曾在谷歌工作了3年,此前还曾在NVIDIA工作。

她说,NVIDIA可以做暴力叠加,而Groq这种架构能能迅速灵活地执行任务,这是他们领先于NVIDIA的关键。

▲Groq首席运营官Adrian Mendes

Groq的目标是数据中心和自动驾驶汽车中的推理应用。

其首席运营官Adrian Mendes表示,“微秒级”的延迟与整体确定性相结合,使得Groq的芯片适合于自动驾驶、金融等安全关键型应用。

“从8月开始,我们已经向少数客户提供了硬件。” Mendes说,“我们的硬件现在位于客户数据中心中……他们正在这些板上运行程序,并从中获得很好的结果。”

结语:AI推理市场行路难

Groq在创办之初的确带给了人们很多的期待,但不可否认的是,它的神秘主义尽管使得部分人对它更加感兴趣,却也伴随着AI芯片热度的退却,消磨了大众的热情和耐心。

从当前透露的信息来看,有着高起点的Groq确实有很多关于AI推理市场的思考,我们也可以看到其创新架构的核心组成就是编译器,但是这一架构究竟能不能获得足够高的市场反响,还需要等时间来证明。

就目前AI芯片市场格局,Groq要想突围AI推理市场还面临很多阻碍。且不论NVIDIA、英特尔依然是阻挡在众多创企面前的两座大山,要想和巨头硬碰硬,不仅要有源源不断的资金支持,还要构建能支持各种主流通用机器学习框架的软件工具,这对大多数AI芯片创企来说,都是亟待解决的难题。

原文来自:ElectronicDesign,EE Times,Groq