智东西(公众号:zhidxcom)

作者 | ZeR0

编辑 | 漠影

谷歌正试图训练出更像人类的机器人。

智东西8月17日报道,谷歌刚刚公布一项重磅研究进展:通过结合更强大的人工智能(AI)大型语言模型,进一步提高机器人的“智商”。

研究人员表示,这是第一次将大型语言模型集成到机器人中,“是一种非常不同的范式”。

就像人类一样,机器人能响应完整的命令。换句话说,你不再需要像以前那样分步地发出一连串简短指令,一步一步指导机器人的每个动作。

谷歌研究人员做了个演示,对机器人说:“我饿了,你能给我点零食吗?”

接着,机器人在自助餐厅中搜索一番,然后打开一个抽屉,找到一袋薯片并将它拿给研究人员。

当然了,拿汽水也是不在话下。

▲机器人演示拿起物品的能力

▲机器人演示拿起物品的能力

这是一项雄心勃勃的技术突破,为多用途机器人铺平了道路,使其像以往的扫地机器人、巡逻机器人等单一任务机器人一样易于控制。

谷歌在本周二发布的博文中,详细介绍了这项研究进展,通过结合更复杂的语言模型,机器人执行命令的成功率从61%提高至74%。

项目链接:https://sites.research.google/palm-saycan

论文链接:https://arxiv.org/pdf/2204.01691.pdf

一、用大模型提高理解能力,让机器人不再是“铁憨憨”

指挥机器人干活不是什么新奇的事,但要让机器人能够理解你的命令背后的意图,那就要考验它的“大脑”好不好用了。

比如,当你问机器人:“我把饮料洒了,你能帮忙吗?”谷歌机器人可以迅速筛出适配指令的合适行动,然后从厨房拿块清洁海绵来。

但假如你只是惊呼:“完蛋!我的饮料!”那么常见的机器人通常毫无反应,这时候,如果有一个智能机器人听出你的话外音,主动帮你清洁,那它才是真正聪明的机器人。

这些看似简单的感知技能,实际上是最具计算挑战性的任务类型。

以前,机器人系统只能执行简短、明确的指令,例如“拿起一个苹果”、“往前走两步”。

机器人往往在明确具体的任务和奖励下表现最好,但在学习执行多步骤任务和推理抽象的、模棱两可的指令方面遇到困难。

比如,你问机器人:“我刚刚锻炼过,可以给我拿一份健康的零食?”机器人可能很难理解这句话里的细微表达差别和微妙之处。

▲Everyday机器人给谷歌研究人员送零食(图源:路透社)

▲Everyday机器人给谷歌研究人员送零食(图源:路透社)

虽然近年来大型语言模型进展飞速,取得许多令人印象深刻的结果,很多语言模型在特定领域的知识储备已经远超人类,但很多语言模型的训练并没有基于物理世界的数据,通常不会跟环境产生直接交互,也不会观察其响应的结果。

这可能导致语言模型生成的指令,会让在现实环境中运行的机器人做出不合逻辑、不切实际或者不安全的行动。

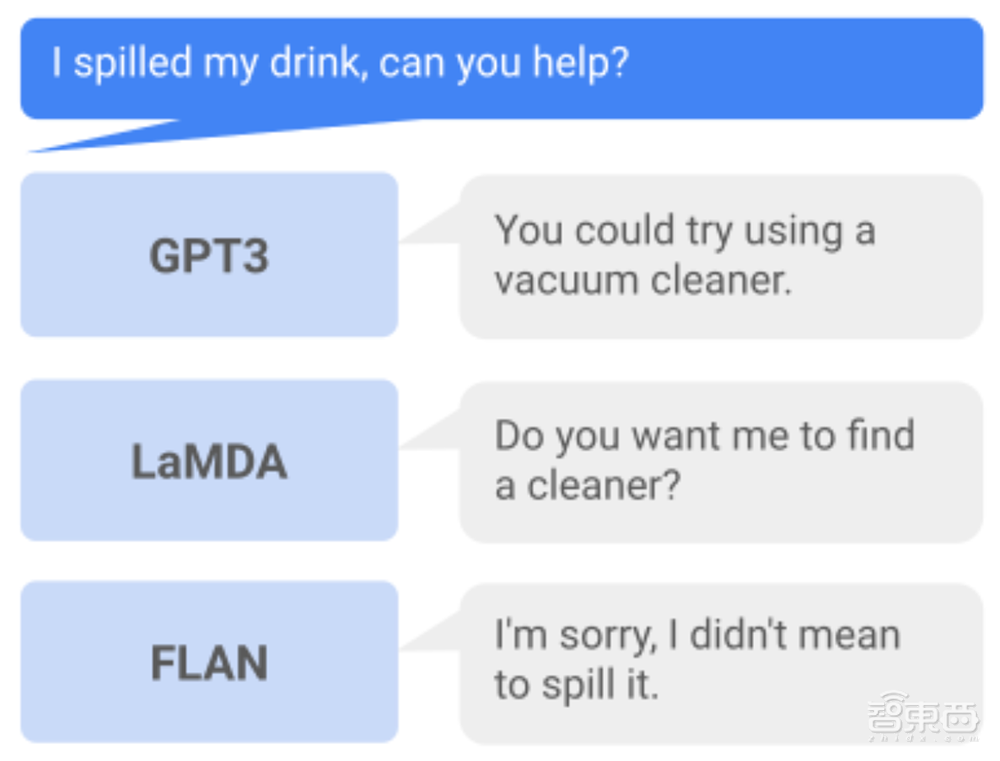

我们还用刚才提到的问题举例,问机器人:“我把饮料洒了,你能帮忙吗?”

经典的OpenAI大模型GPT-3会提供一个建议:“您可以尝试使用真空吸尘器。”

谷歌AI系统LaMDA会回答:“您想让我帮忙找个清洁工具吗?”

另一个谷歌FLAN语言模型则会直接道歉:“对不起,我不是故意的。”这显然是个没用的回应。

因此,谷歌研究人员提出设想,有没有一种有效的方法,能够将高级语言模型的语言理解能力和机器人系统擅长的处理感知和交互能力相结合,同时利用两者的优势?

这就是谷歌正与谷歌母公司Alphabet的机器人子公司Everyday Robots合作研发的新方法——PaLM-SayCan。

二、用语言模型做“大脑”,机器人充当“手”与“眼”

谷歌研究人员称,将PaLM-SayCan集成到机器人中后,机器人通过使用思维链提示和执行请求所需的分步解决方案,能更好地执行复杂、抽象的任务,根据自身能力权衡接下来最合适的执行步骤,并实现高度可解释的行动结果。

“我们发现它(机器人)甚至能处理16个步骤的指令。”研究人员说。

引入PaLM-SayCan后,语言模型可以帮助机器人更好地理解运用到高级语义知识、需要进行推理的指令,使其与人类、与物理环境的互动更自然。

反过来,机器人可以充当语言模型的手和眼,通过与真实环境的不断交互为语言模型提供更多的经验。

具体是怎么做的呢?

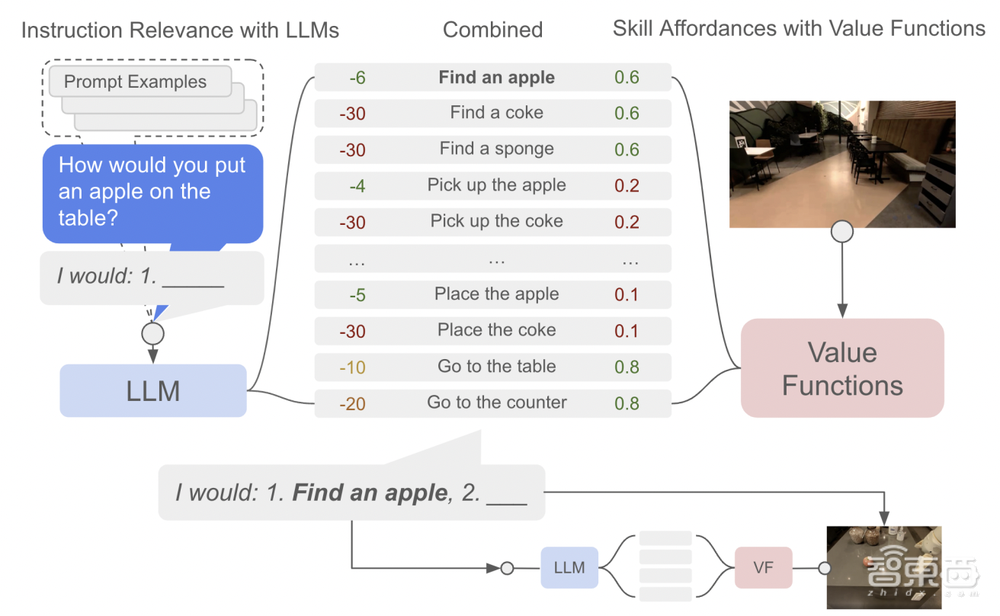

PaLM-SayCan方法使用PaLM语言模型(Say)中包含的知识来确定和评估对高级指令有效的动作,它还用到一个Affordance功能(Can),来支持现实世界并确定在给定环境下可执行哪些操作。

这个系统可以看作是用户和机器人之间的对话平台。用户首先发出一个指令,语言模型将其拆解成方便机器人执行的一系列明确步骤。

然后,机器人对这些步骤进行筛选,通过评估确定在其当前状态和环境下最可行的行动计划,从而完成相应任务。

该模型通过将两个概率相乘,来确定特定技能成功学习的概率:一是task-grounding,即技能语言描述;二是world-grounding,即当前技能的可行性。

由于PaLM-SayCan方法拥有较好的可解释性,用户可以通过查看单独的语言和可视性分数,来轻松理解决策过程。

三、洒了饮料,机器人帮忙清理分几步?

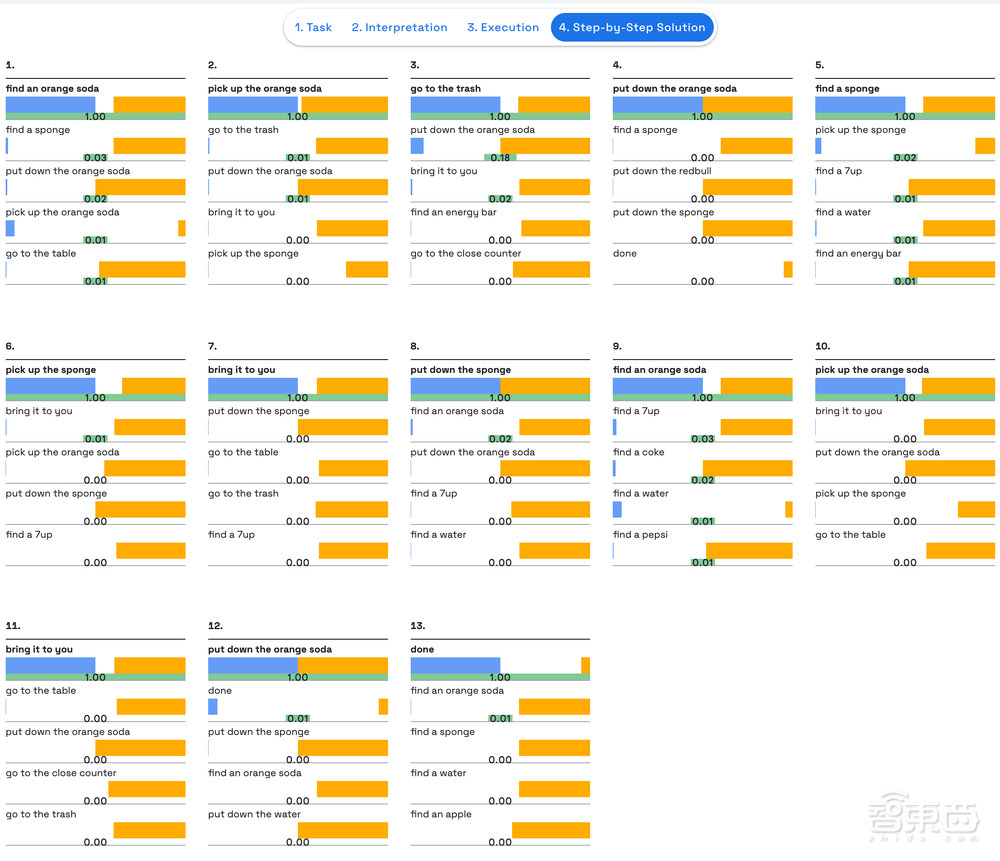

如可视化界面所示,PaLM-SayCan执行复杂任务的行为是可解释的,这将使机器人的交互过程更加安全可控。

比如当你洒了饮料,请求机器人帮忙时,你可以看到它是如何做出决定,为执行任务选择最合适的步骤的:找到可乐罐,拾起可乐罐,走到垃圾桶旁边,放下可乐罐,找到一块海绵,拾起海绵,走向桌子,放下海绵……

蓝色显示的是语音模型分数,即语言模型判断技能有用的概率;红色是affordance分数,即系统成功执行技能的可能性;绿色显示的是用于最终决定执行技能的综合分数。

PaLM-SayCan方法将语言模型的概率和价值函数(VF)的概率相结合,以选择下一个要执行的技能,重复这个过程,直至高级指令成功完成。

研究人员使用基于图像的行为克隆(BC)来训练语言条件策略和基于时间差异(TD)的强化学习方法来训练价值函数。

智能体技能库中,训练策略和价值函数的每个技能都会被定义为一个具有简短语言描述的策略,用嵌入表示,以及一个指示从机器人当前状态完成技能概率的affordance函数。

为了学习affordance函数,研究人员使用稀疏奖励函数,设置为1.0表示成功执行,0.0表示未成功。

训练策略方面,研究人员从10个机器人在11个月内执行的68000次演示中收集了数据,并从一组自主学习的策略片段中筛选了12000次成功的片段,然后在Everyday Robots模拟器用使用MT-Opt学习语言条件值函数,通过使用演示来引导模拟策略的性能,以提供初步成功,再通过模拟中的在线数据收集来持续改进强化学习性能。

四、走向通用机器人时代

为了测试其方法,研究人员使用了与PaLM配对的Everyday Robots机器人,将机器人放在有各种常见物体的厨房环境中,用101条指令对其进行测试。

这些指令不是简单的命令式查询,而是涵盖了语言常有的歧义性和复杂性。

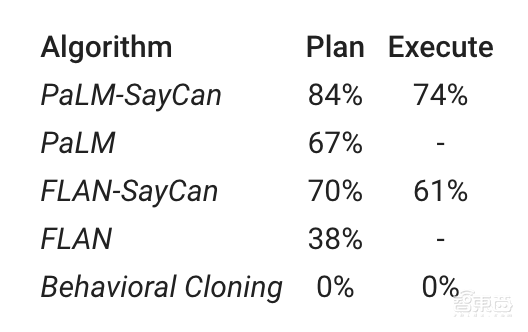

研究人员用两个指标来评估系统的性能:(1)规划成功率,表示机器人是否为指令选择了正确的技能;(2)执行成功率,表示机器人是否成功执行了指令。

他们比较了PaLM和FLAN两种谷歌大型语言模型、有和没有affordance grounding以及直接使用自然语言运行的底层策略。

结果显示,使用带有affordance grounding的PaLM(即谷歌PaLM-SayCan)系统在84%的时间内选择了正确的技能序列,并在74%的时间内成功执行这些技能序列。

▲当与PaLM结合使用时,SayCan展示了101条测试指令中84%的成功规划

与FLAN以及没有robotic grounding的PaLM相比,PaLM-SayCan的错误减少了50%。同时,相较此前的FLAN-SayCan方法,PaLM-SayCan的执行成功率提升了13%。

“这特别令人兴奋,因为它代表着我们第一次可以看到语言模型的进步如何转化为机器人技术的类似改进。”谷歌研究人员在技术博客中写道。

研究人员相信,这项研究将推动从执行简短、明确的制定命令的工业机器人,过渡到可以处理更复杂和抽象命令的通用机器人时代。

不过由于谷歌没有公开101个命令的完整列表,所以这些命令是否覆盖家庭机器人所需理解的绝大部分语言广度和复杂性,还不好下定论。

谷歌研究人员还开源了一个机器人模拟设置,希望提供宝贵资源用于将机器人学习与高级语言模型相结合的未来研究。

GitHub链接:http://say-can.github.io/

未来,他们希望更好地了解利用机器人的真实世界经验获得的信息来改进语言模型,以及自然语言在多大程度上是编程机器人的正确本体。

五、科技巨头对机器人研发兴趣浓厚

谷歌母公司Alphabet对研发机器人布局已久。

2013年,谷歌一连收购了几家知名机器人公司,包括机器人领域“最出圈”的波士顿动力。不过后来波士顿动力几经转手,先是被谷歌卖给日本电信和科技投资巨头软银,后来又被软银卖给了韩国汽车巨头现代。

此前Everyday Robotics打造的机器人已经在谷歌内部执行一些简单任务,比如送零食、倒垃圾、擦拭柜台。

▲机器人跟谷歌员工打乒乓球

▲机器人跟谷歌员工打乒乓球

Everyday Robotics项目仍处于起步阶段,机器人行动比较缓慢,做事也没那么果断灵巧。不过随着这些机器人借助谷歌大型语言模型提高理解能力,它们将进一步提高执行力。

除了谷歌外,多家大型科技公司都对机器人技术展现出浓厚的兴趣。

一个典型的代表是美国电商巨头亚马逊,它在仓库中使用了许多机器人,并且正在试验无人机送货。这个月初,亚马逊还宣布计划以17亿美元收购扫地机器人鼻祖iRobot,此次收购也将成为亚马逊史上第四大巨额收购交易。

就在上周,国内智能手机制造商小米公布了其研发的人形机器人“铁大”,去年它还推出了一款机器狗“铁蛋”。

▲小米人形机器人“铁大”

▲小米人形机器人“铁大”

除此之外,美国电动车龙头特斯拉也在研发通用机器人,并将在9月30日发布其首款人形机器人“擎天柱”原型机。

据特斯拉创始人兼CEO马斯克透露,“擎天柱”将是一款非常友好的机器人,能替代人类执行一些从事危险、重复、无聊的任务,包括拿扳手给特斯拉电动车装螺丝,或者帮人类买菜、做饭、照顾老人,而且未来其成本比汽车还要便宜。

▲特斯拉“擎天柱”

▲特斯拉“擎天柱”

结语:距离高智能机器人,还有很长的路要走

多年来,用AI技术训练机器人屡有突破,但大的进展仍然缓慢。而引入语言模型的方法,或许可以帮助机器人进一步提高解决复杂问题的能力,从而替代人类从事更多重复性劳动。

谷歌的这一探索,展示了机器人技术与大型语言模型进步结合的更多可能性。

目前真正大范围渗透进人们日常生活空间的家庭机器人,仅有清洁机器人这个品类,但在AI、激光雷达等技术的辅助下,随着机器人提高视觉、导航等技能,更多新型机器人将进入家庭场景。

当然,迄今的机器人研发,距离我们想象的十项全能“机器人管家”,还有很长的路要走。

语言模型固然可以为机器人提供更好的步骤规划评估和选择,但它们还做不到事无巨细地提供所有信息,比如不能告诉机器人打开冰箱时应施加多大的力。谷歌研究人员也暂时没有将PaLM-SayCan商业化的计划。

围绕机器人创新技术及商业化落地成果,智东西将在明日举行的2022世界机器人博览会现场发来更多一线观察报道,欢迎关注。