智东西(公众号:zhidxcom)

编译 | 吴菲凝

编辑 | 李水青

智东西4月3日消息,据《华尔街日报》报道,Meta正在开发一个系统来读取人脑中的想法,该项目利用AI来帮助科学家们研究大脑中神经元,通过一个仿真人脑模型,就能实现人的大脑活动在无需打字、语音输入的情况下直接转文字。

智东西发现,去年,Meta AI实验室曾公开了一项名为“大脑信号读心术(Brain Signal Reading)”的研究成果。研究人员利用脑电图和脑磁图两种非侵入式技术获取数据,让自主监督学习AI工具wave2vec 2.0在开源录音上进行训练,训练数据集中包含169名志愿者在听到有声读物和单句时的大脑活动录音。通过近150个小时的录音,算法像懂读心术一样能够推断出人们最有可能听到的词。

这项技术证明科学界正努力借助AI来了解人类大脑,Meta的研究目前仍在继续。

一、Meta研究“读心术”,构建仿真大脑模型

每年有近7千万人遭受创伤性脑损伤,导致其今后无法再通过语言、打字甚至是手势交流。研究人员正努力从无创大脑活动中解码语言来改善这部分人的生活。

据悉,大脑解码技术可以通过不同的方法来实现,主要有三类:一是侵入式脑机接口,二是非侵入式脑机接口,三是用于研究神经元活动的大脑解码技术。Meta在研究中主要通过非侵入式脑机接口来实现脑电波读取。

在这项研究中,研究人员们使用的是从被试者那里收集来的大脑信号数据,被试者坐在非侵入式脑部扫描仪前听单词和短语,然后扫描仪来捕捉他们的脑电波数据。扫描仪可以分为两种:一种是为人熟知的嵌入式电极,被称为“EEG(脑电图Electroencephalogram)”;另一种是MEG(脑磁图Magnetoencephalography),两种扫描仪分别测量由神经元活动引起的电场和磁场的波动。在实践中,这两个系统使用数百个传感器,每秒钟可以拍摄大约1000张宏观大脑活动的快照,研究人员再将这些EEG和MEG数据记录输入到一个仿真大脑模型中。

▲Meta Platforms利用从语言实验中收集来的数据,从人脑中“读取”单词和短语

▲Meta Platforms利用从语言实验中收集来的数据,从人脑中“读取”单词和短语

由于个人的大脑解剖结构、各脑区神经功能的位置和时间的差异,以及记录过程中传感器的位置的不同,每个人的脑电图记录也完全不同。在实践中,分析大脑数据通常需要在仿真大脑上重新调整信号,这是一个较复杂的工程管道。在以前的研究中,大脑解码器是在少量的录音中训练,然后预测一组有限的语音特征,如部分语音类别或单词。

在这次研究中,研究人员设计了一个新主体嵌入层,该层经过端到端的训练,可以将所有脑电波记录对齐在一个公共空间当中。为了分析这些脑信号数据,研究人员使用了自我监督学习的AI模型wave2vec 2.0,该模型不用指示就能从巨大的数据池中抓取数据,可从噪音中识别正确的语音,还能解析动物对话的含义。

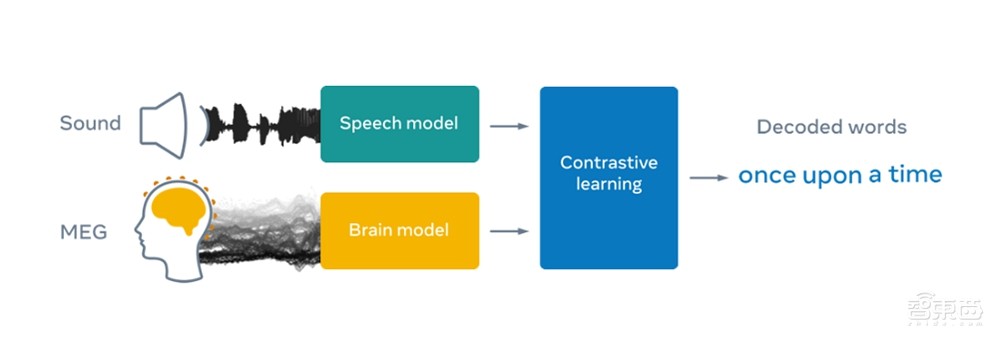

为了从非侵入式大脑信号中解码语音,研究人员训练出了一个可对比学习的模型,把大脑活动与相似的语音对齐,当两者保持大体一致时,就能找出仿真大脑模型输出的对应语音。

▲wav2vec 2.0的激活映射到大脑中来响应相同的语音

▲wav2vec 2.0的激活映射到大脑中来响应相同的语音

二、打造通用脑语言解码器,大脑活动直接转文字

Meta AI团队在之前的工作中用wave2vec 2.0证明了该算法可以生成与大脑类似的语音电波。据Meta研究团队称,在训练中系统执行的是零样本分类,只要提供一个大脑活动片段,系统就能从众多音频片段中确定这个人实际听到的是哪一个片段,算法就能推断人们最有可能听到的词。

▲研究人员在记录受试者的神经活动时,评估MEG传感器的波动

▲研究人员在记录受试者的神经活动时,评估MEG传感器的波动

Meta的科学家亚历山大·德福塞斯(Alexandre Défossez)是这项研究的团队成员之一,他说这项工作的最终目标是创建一个通用脑语言解码器,它可以直接将我们的大脑活动转化为文字。

最终的研究结果表明,训练有素的自我学习AI模型可以成功从无创大脑的活动记录中解码感知到的语音。但这还只是第一步,目前的研究专注于解码语音感知,但最终的现实目标是要实现与患者的交流,将研究扩展到语音生成。

在可见的未来,人们只要戴着一个脑电图帽,就能够给朋友发短信。德福塞斯补充说,这项技术可能会彻底改变那些无法交流的患者的生活,他们目前已公开分享这项研究,并加快进展来应对未来的挑战。

Meta这项研究充分证明了AI可以在合理应用下让人类更好地了解自己,不仅是进一步推动技术的进步,还可以创造出人类与计算机交互的新方式。

三、基于强大数据处理能力,AI助人类了解大脑机制

神经科学推动AI发展在未来将释放出巨大的潜力,但大多数AI工程师都不知道如何借助神经科学来助力AI发展,也不明白人工神经元网络和动物神经元网络的行为特征有何分别。加州大学伯克利分校心理学教授塞莱斯特·基德(Celeste Kidd)通过一项实验帮助工程师们更好理解了神经科学、计算科学等领域是如何协同推进AI发展的。

在研究中,通过一系列关联测试,基德积累了一个数据池,把人们对于一个问题的不同看法进行了分类。

基德通过研究人们对某些政治家的看法,得出一个结论:人们最容易在一些带有道德评判色彩的词语中产生意见分歧,这本是人类特有的思考行为,但那些已经通过具身图灵测试(The Embodied Turing Test )的AI也能达到。基德及其团队总结出,人们往往不会对常见物体的基本特征达成一致。即使对于鸡、鲸鱼和鲑鱼这样常见的动物,人们对它们的看法也不尽相同。这个研究结果由“聚类模型”辅助得出,该模型是多个AI模型的实现基础。

虽然这个观察看上去并不深刻,但结果表明,AI大脑解码研究的可信度远高于心理学家们之前所认为的。

基德称,AI最重要的能力就是使诸如OpenAI的聊天机器人ChatGPT、谷歌聊天机器人Bard和微软的新版搜索引擎Bing等新研究成为可能。在她看来,现代计算机系统拥有远超过去的数据处理能力,这让一切研究都有机会成为现实,这种能力开辟了很多的可能性,无论是在生物学、医学还是认知科学领域。

普林斯顿大学神经科学助理教授塔蒂亚娜·恩格尔(Tatiana Engel)使用了与大多数AI同类型的人工神经元网络。她的团队用这些人工神经元网络来解释动物大脑中数百个神经元的电信号,并训练人工神经元网络模仿动物神经元网络行为特征,让它们做动物的动作,比如游泳和蠕动。

在研究中,团队发现,这些人工神经元网络会通过模拟来不断接近动物神经元的组织方式。恩格尔博士称,大脑的神经网络要更加复杂,但人工神经元网络作为一种模拟系统,既足够简单,也能够无限接近动物神经元的生物学价值,可以通过模仿来告诉我们真实大脑是如何工作的。

这就说明,思考是脑电波向大脑发送信号,形成一个由神经元构成的复杂代码来影响我们的行为。这种结论与神经科学家之前的结论相反:他们曾认为存在影响我们应该如何做决定的神经元。但实际上,并不存在“吃巧克力”和“不吃巧克力”的神经元。

恩格尔博士称,AI能帮助人们知道大脑的内部构造和运作情况。

结语:机器解码大脑信号,“读心专家”成现实

当大量的脑电波图像数据用于训练通用脑模型时,我们将会更好地理解人类思维的形成过程和内部发展变化,并将其用于改进人工智能算法的性能和其他领域。在可见的未来,大脑解码技术的研究和发展将对认知科学和人工智能产生深远影响,不仅为神经系统疾病治疗提供新发展机遇,而且能为深受语言困扰的患者带来交流的可能性。

但与此同时,EEG、MEG等数据获取困难、大脑数据整合难度大以及脑数据的隐私保护问题等挑战接踵而来,同样需要多加关注。

来源:《华尔街日报》、Meta AI官网