智东西(公众号:zhidxcom)

作者 | 徐珊

编辑 | 心缘

智东西5月2日报道,昨日《纽约时报》最新报道显示,“深度学习三巨头”之一、2018年图灵奖得主Geoffrey Hinton透露他已经离职谷歌。

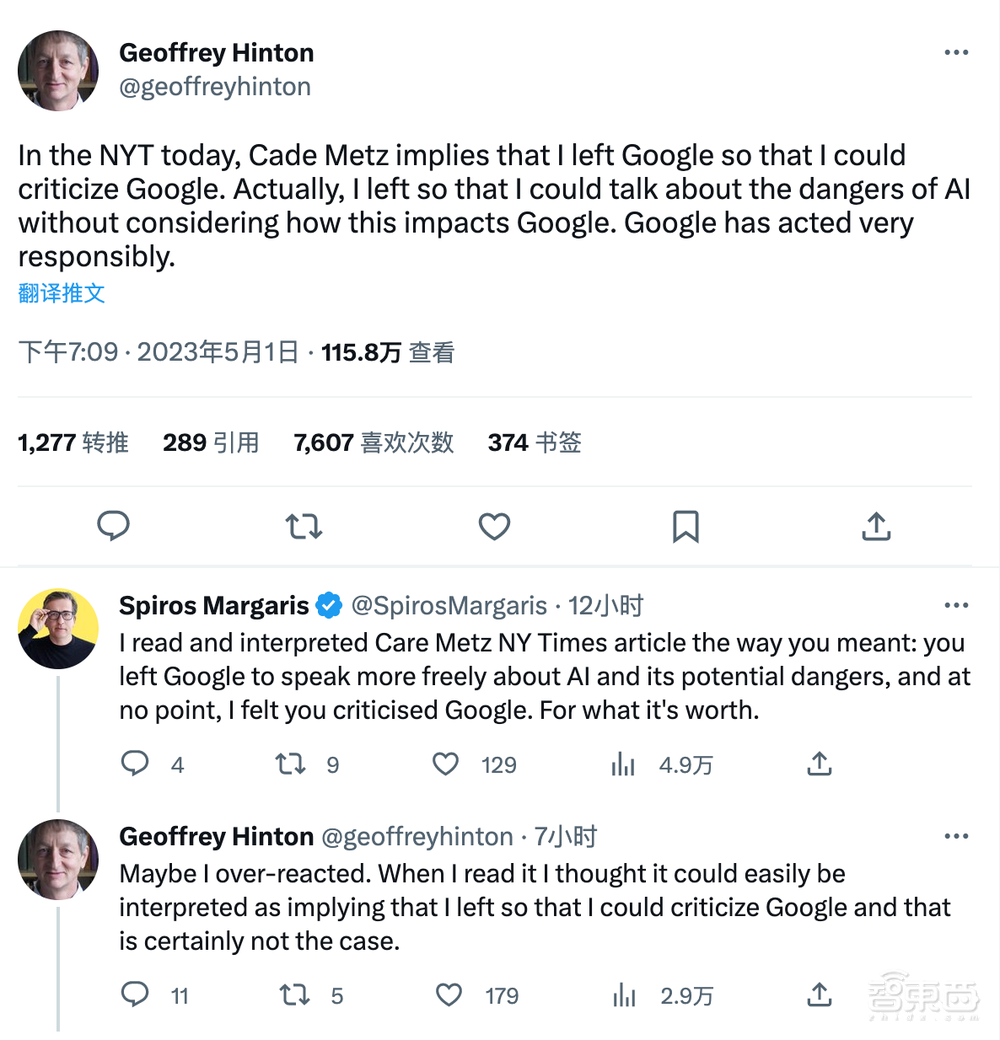

随后Hinton发表推文证实离职消息,但强调他离开是为了谈论人工智能的危险,而不会对谷歌造成影响,谷歌的行为非常负责任。

Geoffrey Hinton曾和Yoshua Bengio、Yann LeCun共同获得了2018年“计算领域的诺贝尔奖”图灵奖。他们在AI领域的研究工作促进了AI蓬勃发展。

Geoffrey Hinton表示离职之后,他可以畅所欲言地谈论人工智能的风险。Hinton担忧AI所带来的影响之一是虚假信息的传播:虚假图像和文字大量充斥在网络中,导致大家难以分辨什么是真实的。而更进一步,他还担心随着AI技术的提升,AI开始编写和运行自己的代码,会对人类的生存造成更大的威胁。

“这些东西(AI)实际上可以比人类变得更聪明。”Hinton提到他此前也和大部分人一样,认为AI威胁人类是很遥远的事情,至少发生在30年至50年之后。但近期他已经不再认为其很遥远。

据采访透露,Geoffrey Hinton 4月就已经向谷歌提交辞职申请。

一、离开谷歌,做人工智能风险“预警员”

出生于1947年、现年76岁的人工智能先驱Hinton是英国侨民。2012年,Hinton博士和他在多伦多大学的两名研究生Ilya Sutskever与Alex Krishevsky构建的卷积神经网络在ImageNet大规模视觉识别挑战赛中以巨大优势夺冠,将深度学习推向主流。

但近来越来越多批评人士强调,积极开发基于生成式人工智能的产品是在跟危险赛跑。而据《纽约时报》报道,周一,Hinton也正式加入了这一行列。Hinton说,他已经辞去了谷歌的工作,他在谷歌工作了十多年,成为该领域最受尊敬的声音之一,所以他可以自由谈论人工智能的风险。

他说,自己多少对毕生的工作感到有些遗憾。

“我用通常的借口来安慰自己:就算我没做,别人也会做的。”上周,Hinton在他位于多伦多家中的餐厅接受了一次长时间的采访,那里距离他和学生取得突破的地方只有几步之遥。

在《纽约时报》看来,Hinton从“人工智能开拓者”转向“末日预言者”的旅程,标志着科技行业在几十年来最重要的拐点上的一个非凡时刻——业界领袖认为,新的人工智能系统可能与20世纪90年代初推出的网络浏览器一样重要,并可能导致从药物研究到教育等领域的突破;但令许多业内人士苦恼的是,他们担心自己正在释放一些危险的东西,生成式人工智能已经可以成为制造错误信息的工具,这可能很快会对就业构成威胁,甚至在未来的某个时候可能会对人类构成威胁。

美国知名人工智能创企OpenAI今年3月发布了多模态大模型GPT-4和新版ChatGPT后,1000多名技术领袖和研究人员签署了一封公开信,呼吁暂停更先进系统的开发6个月,因为人工智能技术“对社会和人类构成了深刻的风险”。几天后,有40年历史的学术团体人工智能促进协会的19位现任和前任领导者发表了他们自己的公开信,警告人工智能的风险。

不过Hinton并未在这两份信上签名,他说自己不想在辞职前公开批评谷歌或其他公司。上个月,他向谷歌表达了辞职意愿,并于周四与谷歌母公司Alphabet的首席执行官Sundar Pichai通电话,但他没有透露具体内容。

谷歌首席科学家Jeff Dean在一份声明中回应:“我们仍然致力于以负责的方式对待人工智能。我们将不断学习以面对即将出现的风险,同时仍持续大胆创新。”

二、Hinton的担忧:科技巨头陷入无止的竞争,“杀人机器人”可能成为现实

2013月3月,谷歌斥资4400万美元收购了一家由Hinton和他的两个学生创办的多伦多初创公司DNNresearch。之后,谷歌在2014年斥资4亿美元收购了英国人工智能初企DeepMind。

当年与Hinton一起掀起深度学习狂澜的Ilya Sutskever,先是在谷歌大脑团队做研究科学家,后来参与创办OpenAI并担任首席科学家。

他们的研究成果催生了越来越强大的技术,包括ChatGPT和谷歌Bard等新型聊天机器人。

Hinton曾认为,构建从大量数字文本中学习的神经网络,是机器理解和生成语言的一种强大方式,但它不如人类处理语言的方式。去年,随着谷歌和OpenAI构建了使用大量数据的系统,他的观点发生了变化。他仍然认为这些系统在某些方面不如人类大脑,但他认为它们在其他方面使人类的智慧黯然失色。

他认为,随着公司对人工智能系统的改进,它们会变得越来越危险。“看看五年前和现在的情况,”他在谈到人工智能技术时说,“接受差异并将其传播,这是可怕的。”

他说,直到去年,谷歌一直是这项技术的“适当管家”,小心翼翼地不释放可能造成伤害的东西。但是现在微软用聊天机器人增强了Bing(必应)搜索引擎,以挑战谷歌的核心业务,谷歌也在竞相部署同样的技术。Hinton判断,科技巨头陷入了一场可能无法阻止的竞争。

他最担心的是,互联网将充斥着虚假的照片、视频和文字,普通人将“无法再知道什么是真的”。他还担心人工智能技术最终会颠覆就业市场。如今,像ChatGPT这样的聊天机器人往往是对人类工作者的补充,但它们也可能取代律师助理、个人助理、翻译和其他处理死记硬背任务的人。

“它消除了苦差。”Hinton说,“它带走的可能远不止于此。”

他担心该技术的未来版本会对人类构成威胁,因为它们经常从其分析的大量数据中学习意想不到的行为。在Hinton看来,这成了一个问题,因为个人和公司不仅允许人工智能系统生成自己的计算机代码,还允许它们自己运行这些代码。他担心有一天真正的自主武器——那些杀人机器人——成为现实。

“一些人相信,这种东西实际上可以变得比人更聪明。”Hinton谈道,“但大多数人认为这太离谱了。我觉得这还很遥远,我认为它需要30到50年甚至更长的时间。显然,我不再这么想了。”

结语:对人工智能潜在风险的担忧正日益加剧

Geoffrey Hinton,这位人工智能传奇人物从谷歌辞职,在全球人工智能领域引起新一波围绕“潜在风险”主题的地震。他担忧人工智能对人类及企业产生不可逆转的负面影响,并决心挺身而出,站在狂热的人工智能风暴中心发出警告的声音。

Hinton说,当人们过去问他如何能研究有潜在危险的技术时,他会引用“原子弹之父”罗伯特·奥本海默(Robert Oppenheimer)的话:“当你看到某种技术上令人兴奋的东西时,你就会去做。”但现在,他不再那样说了。

以生成式人工智能为代表的前沿算法,正因其强大的生成能力引起各国政府的警惕。今年4月11日,我国网信办发布《生成式人工智能服务管理办法(征求意见稿)》,提出21条举措,用规章制度防范人工智能技术手段滥用行为,给人工智能技术和应用的发展“系上安全带”。

Hinton也呼吁说,谷歌与微软以及其他公司之间的竞争将升级为一场全球竞争,如果没有某种全球监管,这场竞争将不会停止。

在他看来,与核武器不同,没有办法知道公司或国家是否在秘密研究这项技术。最大的希望是世界顶尖科学家在控制这项技术的方法上进行合作。“我认为,在他们弄清楚自己是否能控制它之前,他们不应该进一步扩大规模。”他强调道。

来源:《纽约时报》