智东西(公众号:zhidxcom)

作者 | 智东西编辑部

爆!爆!爆!好火爆的一场AI主题盛会。

智东西4月19日报道,为期两天的2024中国生成式AI大会,今日在京圆满收官。

54位产学研投嘉宾代表全程干货爆棚,报名咨询人数逾5200人,超过1800位观众到场参会,线上观看人次更是超过850万。

参会观众们的热情溢满了1230平方米主会场,连分会场收费制的具身智能、AI智能体技术研讨会和免费开放的中国智算中心创新论坛都座无虚席,展区附近交流讨论声此起彼伏。

▲中国智算中心创新论坛座无虚席,连追加两排座椅,还有不少观众站着听会

▲中国智算中心创新论坛座无虚席,连追加两排座椅,还有不少观众站着听会

还有多个“行业首发”:会上,2024「AI生产力创新先锋(AiiP)-中国生成式AI企业TOP50」正式揭晓,李未可科技发布面向眼镜等未来终端定向优化的自研WAKE-AI多模态大模型,58同城宣布其大语言模型平台今晚将上线Llama 3。

▲智一科技联合创始人、智车芯产媒矩阵总编辑张国仁公布年度榜单

▲智一科技联合创始人、智车芯产媒矩阵总编辑张国仁公布年度榜单

大会以“重构世界 奔赴未来”为主题,聚集54位产学研投嘉宾代表同台共探生成式AI全产业链的发展现状与未来趋势,为业界把握时代脉搏提供原创性、高质量的洞见参考。

清华大学计算机NLP实验室是国内开展NLP研究最早、深具影响力的科研单位。清华NLP实验室的学术带头人——欧洲人文和自然科学院外籍院士、清华大学人工智能研究院常务副院长孙茂松教授,为生成式AI大会作开场报告。

孙茂松分享道,通用人工智能已开始登上历史舞台,生成式AI会开启人类全新的创造模式。原来的创作往往是从人类创造的现实空间出发,现在机器创造了更大的现实可能空间,使人们能通过鉴赏选择和修改提升进行创作。

当前生成式AI的基本定位是启发、辅助人类,不会取代人类,因为其均属于概率式方法范式,兼具创造与幻觉一枚硬币的两面,难以精确操控。生成式AI面临的近期挑战,一是走向多智能体,需要让模型在尽量减少人为干预的情况下完成某些任务更加“靠谱”,二是走向具身智能,其中的关键难点是如何有效建立可计算的世界模型。

▲欧洲人文和自然科学院外籍院士、清华大学人工智能研究院常务副院长孙茂松

▲欧洲人文和自然科学院外籍院士、清华大学人工智能研究院常务副院长孙茂松

国内资深大模型行业投资人,“清华系”、“北大系”、“前大厂高管”等光环加身的明星创业者,国内外顶级AI大厂的资深算法专家,三大国内头部AI研究机构的科学家与青年学者,最懂AI基础设施的大厂与创企嘉宾代表,异军突起的爆款AIGC应用先行者,他们悉数而来。

大会首日,25位嘉宾畅谈大语言模型、视频生成、具身智能、音乐生成、世界模型、垂类行业大模型、AI全栈软件、加速大模型端侧部署等前沿议题。(生成式AI大会沸腾北京!从Sora到具身智能,25位大佬密集输干货)

今日,来自生成式AI前线的学术代表、商业领袖、技术专家、青年学者们,继续分享对关键技术创新、全栈软件及智算基础设施升级、AI应用落地探索实践、可持续商业模式的趋势洞察。其中多位嘉宾cue到了昨夜新鲜登场的Llama 3。

一、AI Infra专场:攻克这些“基建”挑战,才能通往高阶AGI

顶尖大模型的强大性能,不止有赖于技术研发实力,还需要扎实的工程功底。底层算力基础设施和AI软件基础设施的升级,都在加速大模型训练与部署的过程中发挥了关键作用。

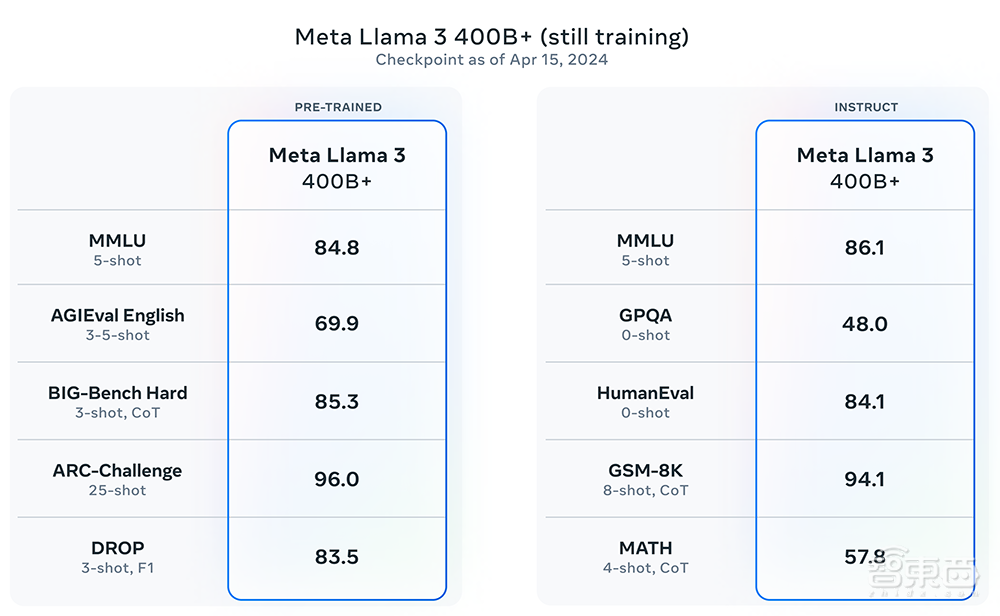

开源大模型领导者Meta最新发布的开源力作Llama 3 8B和70B,再度例证攻克“基建”难关何其重要。据Meta披露,两款模型是同体量中最好的开源模型,Llama 3 400B还在训练中;Llama 3用两个定制24K GPU集群进行训练,训练数据量逾15T tokens,比Llama 2的7倍还多。

▲Meta研究团队在4月15日评估了预训练和Instruct版中经过部分训练的模型,并报告了性能数据

▲Meta研究团队在4月15日评估了预训练和Instruct版中经过部分训练的模型,并报告了性能数据

这背后,Meta采用指令微调技术来改善对话效果,并结合了数据并行、模型并行、流水线并行三类并行方式来训练Llama 3,再加上其他优化策略,综合训练效率比Llama 2提高了约3倍。

在大会AI Infra专场,来自潞晨科技、NVIDIA、星环科技、中科加禾、天津大学&派欧云、阿里云、焱融科技、Zenlayer的嘉宾代表,分享了类Sora开源架构、大模型全栈AI解决方案、应用开发工具链、编译器、分布式算力网络、高效存储等方向的技术、挑战与策略。

新加坡国立大学校长青年教授、潞晨科技创始人兼董事长尤洋谈到模型训练流程开源的重要性,包括模型架构、模型权重、训练细节、数据处理等。正如Meta最新发布Llama 3,其超过4000亿个参数的版本开源后,将造福大量开发者。

面向视频生成领域,他认为现在正处于“GPT-2时刻”,还没有出现成熟的应用。尤洋带领团队开源的全球首个类Sora架构视频生成模型Open-Sora采用STDiT架构,相比DiT成本大幅降低。Open-Sora未来的发展方向主要是完善数据处理流程以及训练视频压缩Encoder。

NVIDIA解决方案架构与工程总监王淼谈到大语言模型生态系统四大趋势,一是新基础大语言模型发布提速,最新代表便是Meta刚发布的Llama 3,二是新算子和定制技术持续优化,三是模型规模继续增加,四是从Dense到MoE转变趋势形成。这意味着需要全栈AI解决方案助力模型开发和应用部署。

NVIDIA如何搭建大语言模型基础设施?王淼分享说,NVIDIA为GPU增加的FP8支持相比FP16、BF16实现2倍吞吐性能提升,同时进一步将数据精度缩减到FP4并胜任推理任务。他还分享了NVIDIA在网络基础设施上的布局,包括融合标准以太网连接和专业高性能架构的NVIDIA Spectrum-X以太网平台、助攻大语言模型应用落地全流程的NVIDIA NeMo、NVIDIA Triton推理服务器等。

星环科技大模型产品负责人童欣欣谈道,当下大模型幻觉问题凸显,通用的大模型难以解决特定场景的问题。企业内部落地大模型应用时,可通过组合提示词工程、检索增强、智能体、有监督微调及预训练等不同方式,来解决垂直场景的业务问题。他还表示大模型及应用开发和落地不是一锤子买卖,需要企业级别的长期运维和监控。

Sophon LLMOps是星环科技推出的企业级大模型和应用开发工具链,提供语料知识精细化处理入库、提示词开发、语料数据标注、大模型微调训练、大模型评估部署到大模型应用构建和应用部署上线的全链路工具能力。此外,星环科技还推出大模型和应用开发服务一体机,通过预装Sophon LLMOps工具平台,用户可按需快速的体验大模型开发和应用的全流程能力。

中科加禾创始人、CEO崔慧敏谈道,在AI芯片落地过程中,关键是要构建整个基础软件的能力,从而增强可持续发展能力。正如CUDA成就了英伟达,软件生态成为AI基础设施的标准和竞争优势,决定了芯片的可用性和市场接受度。

崔慧敏强调了跨平台编译技术的重要性,对标CUDA层次,能跨多种芯片的底层编译工具是解决国产芯片长期可持续的重要基础能力。中科加禾利用编译技术构建的大模型推理引擎可以实现一套软件对多种AI加速卡的支持。

天津大学计算机科学与技术学院教授、PPIO派欧云首席科学家王晓飞分享了三个AGI时代的思考:首先,计算与算力供需长尾化且分布不均;其次,计算任务和需求是否完美匹配、能否精准调度;第三,“核心+边缘”分层协同的算力网络计算范式及算力经济。

基于上述思考,他认为要搭建AGI Infra,分布式算力网络是云边端协同计算基础设施的收敛形态。PPIO推出的“派欧算力云”覆盖全国数千个分布式算力节点,通过智能调度和推理加速技术,可以实现算力性价比提升数十倍,推理成本大幅度降低。

▲天津大学计算机科学与技术学院教授、PPIO派欧云首席科学家王晓飞

▲天津大学计算机科学与技术学院教授、PPIO派欧云首席科学家王晓飞

阿里云高级技术专家、阿里云异构计算AI推理团队负责人李鹏谈道,大模型的发展给计算体系结构带来了功耗墙、内存墙和通讯墙等多重挑战。其中,大模型训练层面,用户在模型装载、模型并行、通信等环节面临各种现实问题;在大模型推理层面,用户在显存、带宽、量化上面临性能瓶颈。

对于如何进一步释放云上性能?阿里云弹性计算为云上客户提供了ECS GPU DeepGPU增强工具包,帮助用户在云上高效地构建AI训练和AI推理基础设施,从而提高算力利用效率。目前,阿里云ECS DeepGPU已经帮助众多客户实现性能的大幅提升。其中,LLM微调训练场景下性能最高可提升80%,Stable Difussion推理场景下性能最高可提升60%。

焱融科技CTO张文涛解读了存储对大模型训练和推理的重要性,从数据加载、协议、模型加载到Checkpoint保存等,过程中存在大量小的读写请求、GPU传输等。对于多模态大模型,高性能存储对训练的提升效果更好,效率可提升20-40%。

针对训练推理,焱融科技推出了多云存储解决方案,基于统一的数据湖底座,通过数据编排将数据按需加载到数据中心,并异步将新增的模型数据推到数据湖。数据加载支持对接OSS、COS、BOS等各大主流对象存储平台。

Zenlayer行业拓展总监陈秀忠谈道,通往更高级AGI的挑战在于更即时的交互、更广的数据、更广的算力。因此,面向AGI的全球边缘云方案需要考虑支持实时交互的全球网络、数据本地存储和全球流动、大量的边缘节点。

专线对中国企业在海外部署关键应用十分重要。陈秀忠称,安全合规的跨境专线是企业连接全球的第一跳。Zenlayer通过边缘数据中心服务,可为企业提供定制化的机房托管和托管主机解决方案。

二、AIGC应用专场:核心问题是高质量数据,3D生成今年将实现真正可用

过去一年,中国生成式AI产业出现很多代表性的商业化探索成果。在手机、互联网、影视、音乐、游戏、金融、电商、文娱、教育、工业、自动驾驶、生活服务等应用场景,搜索、办公、写作、创意到绘画、修图、视频编辑、3D建模等AI提效工具如雨后春笋般蓬勃而生。

探索视频生成和世界模型的极佳科技,用AIGC赋能影视行业的天图万境,将3D生成带入秒级时代的VAST,为生活服务打造垂类大模型的58同城,提供决策式AI和生成式AI相辅相成技术方案的百融云创,打造游戏行业一站式AI赋能平台的行者AI,提供全链路电商内容生成引擎的极睿科技,用AIGC降低音乐制作门槛的灵动音DeepMusic,均在今天下午的AIGC应用专场进行分享。

极佳科技创始人兼CEO黄冠认为,当下所有“通用智能”都在走向“端到端大模型”,一切问题都变成了“高质量数据”问题。“世界模型”是未来具身智能最重要的“高质量数据”来源,它结合互联网数据、仿真数据、遥操数据、真实采集数据等多种数据,学习、训练、组合,从而得到交互式物理世界模拟器。

极佳科技正基于世界模型打造新一代数据平台,面向端到端自动驾驶和通用机器人提供服务。极佳科技DriveDreamer自动驾驶世界模型、WorldDreamer通用世界模型目前已成功商业化落地。

天图万境创始人图拉古认为,AI应该是能够给人们带来温暖、弥合世界的创作工具,而不是取代人工作的的“内卷武器”。因此AI不能离开应用谈技术,而是要建立到应用端的完整产业链。天图万境从AI文本创作,到视频生成,再到服务用户的应用端,打造了全产业链技术解决方案,且都早于国际巨头发布了对应产品,目前正在快速迭代中。

其展示的声音生成工具Sora Opera,可以自动感知、智能识别视频画面中的物理逻辑,精准配出风格多变的音乐音效,为视频增加声音的魅力。还有声音克隆工具SoundMax,它不走传统TTS路线,而是将输入的人声转换成其他声线。这样的人工智能工具,不会让配音演员失业,而是让他们在演绎不同角色时插上飞翔的创意翅膀。

从文字、图片到视频、3D,信息载体不断升级,VAST创始人兼CEO宋亚宸谈道,3D的体验质量、信息密度不断提升且更具互动性。他认为目前3D生成已经达到类似Midjourney V3的效果,今年9月将达到类V4效果,年底达到类V5效果,实现真正可用。

为了应对3D生成创作成本和门槛过高的挑战,VAST将3D内容平台和大众级创作者平台结合。VAST的3D大模型Tripo已实现模型生成数量超150万个。

58同城TEG-AI Lab大语言模型算法部负责人孙启明认为,通用大模型+提示不会代替一切,应用方需要结合自身业务场景,微调出自己的大模型。58同城构建了模型领先、敏捷易用的AI平台,助力AI应用在内部各业务线快速落地。

58同城搭建了一套支持大语言模型训练、推理的平台,集成开源通用大模型,今晚将上线Meta最新推出的Llama 3模型。基于大语言模型平台,58同城已推出了垂类大语言模型灵犀大模型(ChatLing),相比官方开源大模型实现了更好效果。

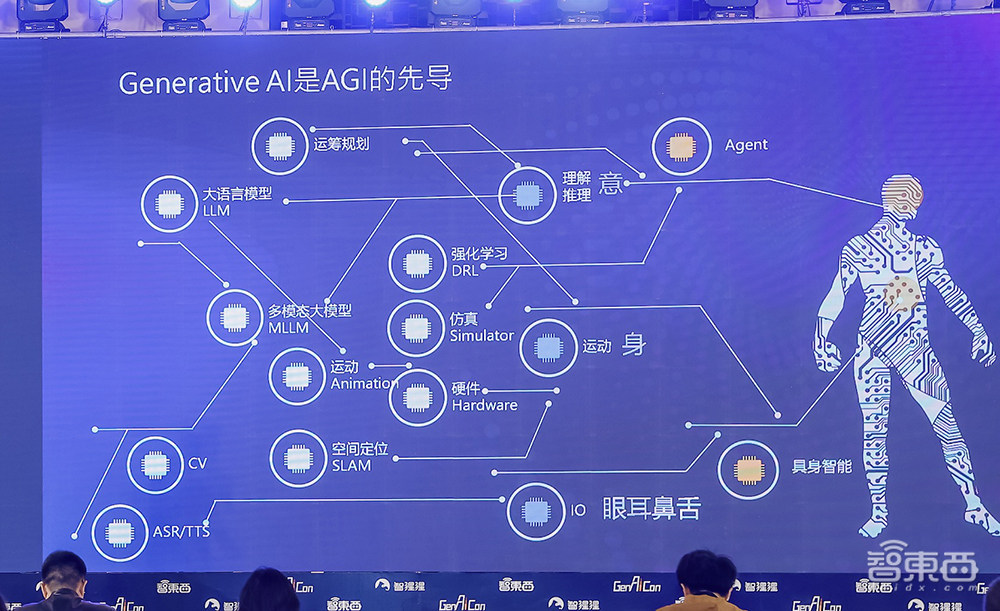

百融云创AI创新负责人谈道,生成式AI是AGI的先导,其与决策式AI最大的区别在于问题空间的扩大。传统模型提供的优化候选集合约为数千个。而Llama 2提供词表中包含3.2万个选项,对信息的压缩比达到14倍;刚刚发布的Llama 3候选词表扩充超过了12万个,对信息的压缩比也提升到30倍以上。

面向金融行业,百融云创开发了百融大模型一站式应用开发平台,针对信息安全、复杂沟通等需求构建了BR-Coder编程助手、数字员工和交互式数字人Web-Copilot等应用。

在他看来,大模型走向落地时,“最后一公里”需要结合具体行业、具体领域工作流,一致、可控、高精度是工业化AI成为工具必不可少的特性。而行者AI的解决方案可以将产品策划、美术总监等用户的工作效率提升3-5倍。

极睿科技创始人兼CEO武彬谈道,当下电商行业图文和短视频的内容数量与需求都在大幅上升,内容关联着平台、卖家与买家的核心交易诉求,但内容制作效率严重不足。

成立于2017年的极睿科技专注于打造电商内容生成引擎,推出了ECGPT+FashionCLIP基座模型及多种电商垂直大模型,可支持商品AI拍摄、AI排版上新、AI直播切片、AI生成商品短视频、AI带货、一站式AI技术与数据服务平台、智能商品操作系统等多种功能,目前已合作超4万电商客户。

DeepMusic CEO刘晓光分享说,当前的音乐商业格局,主要面向泛音乐爱好者的听歌及浅度实践用户的唱歌消费体验,而中间有1亿以上活跃的音乐人、音乐实践者群体,其需求尚未得到好的产品满足;同时音乐制作流程长、门槛高,这使得音乐AIGC技术有用武之地。

对此,DeepMusic构建了跨平台一站式AI音乐工作站“和弦派”,以更直观的音乐知识呈现、编辑形式,解决音乐中歌词、旋律、伴奏等不同模态之间沟通困难的问题,覆盖音乐创作、制作多个流程;未来DeepMusic也会通过积累的精细化标注数据数据,实现对音频模型的精细化控制。

除了上述嘉宾外,另有7位嘉宾在分会场的中国智算中心创新论坛进行分享,6位嘉宾在分会场收费制的智猩猩AI智能体技术研讨会上输出干货。

结语:下一站,上海见!

“我们正站在历史的转折处,见证和参与由生成式AI引领的新一轮科技变革。”智一科技联合创始人、CEO龚伦常代表主办方为大会致辞。

过去一年,生成式AI狂飙突进,整个产业链成为全球创新、投资和应用最活跃的领域之一,每位参与者都在与时间赛跑。作为智能产业的长期观察者,我们期待见证并记录中国生成式AI浪潮之变,并将持续邀请这股浪潮中的生力军们,分享他们最新的技术进展与商业化探索。

今日,为期两天的2024中国生成式AI大会·北京站圆满收官。半年后的11月份,我们将在上海,为中国生成式AI产业再办一场秋日盛会。

除此之外,智一科技旗下AI与硬科技知识分享社区智猩猩将联合智能汽车产业新媒体车东西、芯片产业新媒体芯东西,6月在上海举行中国智能汽车算力峰会,9月在深圳举行第六届全球AI芯片峰会,12月在深圳举行第四届全球自动驾驶峰会。欢迎参会交流。