近期,3D扩散模型在物体生成领域已取得了显著进展,目前已能够生成精细且逼真的三维物体。然而,当尝试将这些模型应用于更广泛的三维场景生成时,却受到了空间范围或生成质量的限制。具体而言,模型在处理大规模和复杂的三维场景时,往往难以在保证细节质量的同时,有效地覆盖整个场景空间。

为了解决以上问题,来自慕尼黑工业大学3D AI Lab的在读博士生孟权提出了一种基于隐式树表征的无限三维场景生成模型LT3SD,实现了高质量、大规模三维场景的高效生成。相关论文为《LT3SD: Latent Trees for 3D Scene Diffusion》。

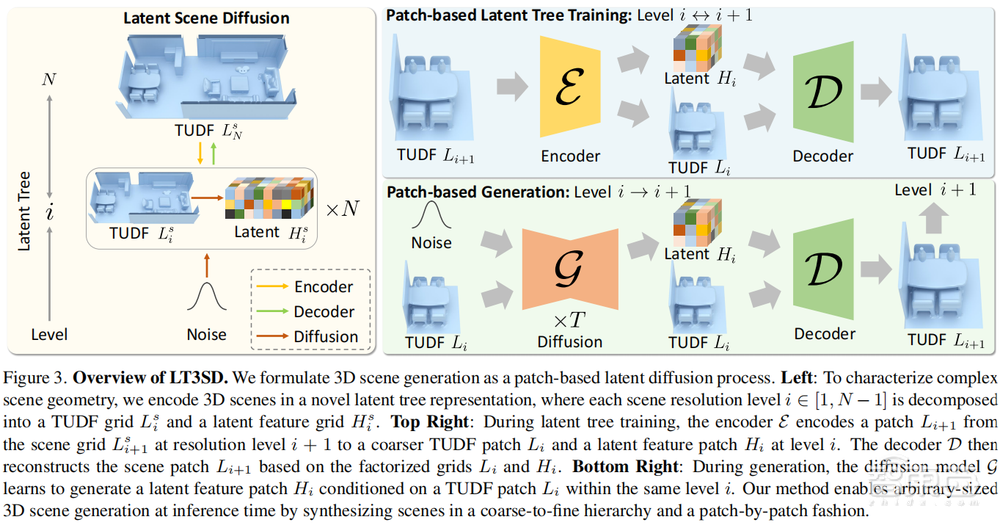

LT3SD是一种新型的潜在扩散模型,用于大规模3D场景生成。其核心是在潜在的3D场景空间中学习生成扩散过程,对每个分辨率级别场景的潜在组件进行建模。

隐式树表征是一种层次化的数据结构,用于捕捉三维场景中的层次关系。该结构将三维场景逐步分解为由粗到细的层次化的结构,每个层次包括几何体和潜在特征的分解,以有效编码低频几何图形和高频细节。

为了合成不同尺寸的大规模场景,LT3SD在每个分辨率级别训练潜在扩散模型,使用分块训练策略学习场景局部结构,并通过跨多个场景块的扩散生成共享,实现任意大小的三维场景生成。

实验证明,LT3SD在大规模高质量无条件三维场景生成,以及基于部分场景的概率补全方面都具备有效性和优势。

10月17日10点,智猩猩邀请到论文一作、慕尼黑工业大学3D AI Lab在读博士生孟权参与「智猩猩AI新青年讲座」253讲,主讲《无限三维场景生成》。

讲者

孟权

慕尼黑工业大学3D AI Lab的在读博士生

第253讲

主题

无限三维场景生成

提纲

1、现有三维场景生成方法及难点

2、三维场景的隐式树表征

3、分块训练的潜在场景扩散模型

4、无限三维场景生成结果与应用

直播信息

直播时间:10月17日10:00

成果

论文标题

《LT3SD: Latent Trees for 3D Scene Diffusion》

论文链接

https://arxiv.org/abs/2409.08215

项目网站

https://quan-meng.github.io/projects/lt3sd/

如何报名

有讲座直播观看需求的朋友,可以添加小助手“米娅”进行报名。已添加过“米娅”的老朋友,可以给“米娅”私信,发送“ANY253”进行报名。对于通过报名的朋友,之后将邀请入群进行观看和交流。