最近,文本到图像的扩散模型取得了显着的进步。值得注意的是,Stable Diffusion和DeepFloyd-IF是当前开源社区中最成功的两个扩散模型。这些模型基于UNet架构,用途广泛,可应用于广泛的任务,包括图像编辑、超分辨率、分割和对象检测。扩散模型的主要缺点之一是图像生成的推理时间较慢。现有方法大多采用了蒸馏技术,但这些方法对计算资源要求较高。

为了解决以上问题,来自南开大学的在读博士生李森茂提出了一种基于扩散模型编码器模块的推理加速的方法Faster Diffusion。相关论文为《Faster Diffusion: Rethinking the Role of the Encoder for Diffusion Model Inference》,已收录于NeurIPS 2024。

Faster Diffusion是一种简单而有效的编码器传播方案,以加速针对不同任务集的扩散采样。其核心是在多个时间步中重复使用编码器特征,加速了扩散模型的采样过程。

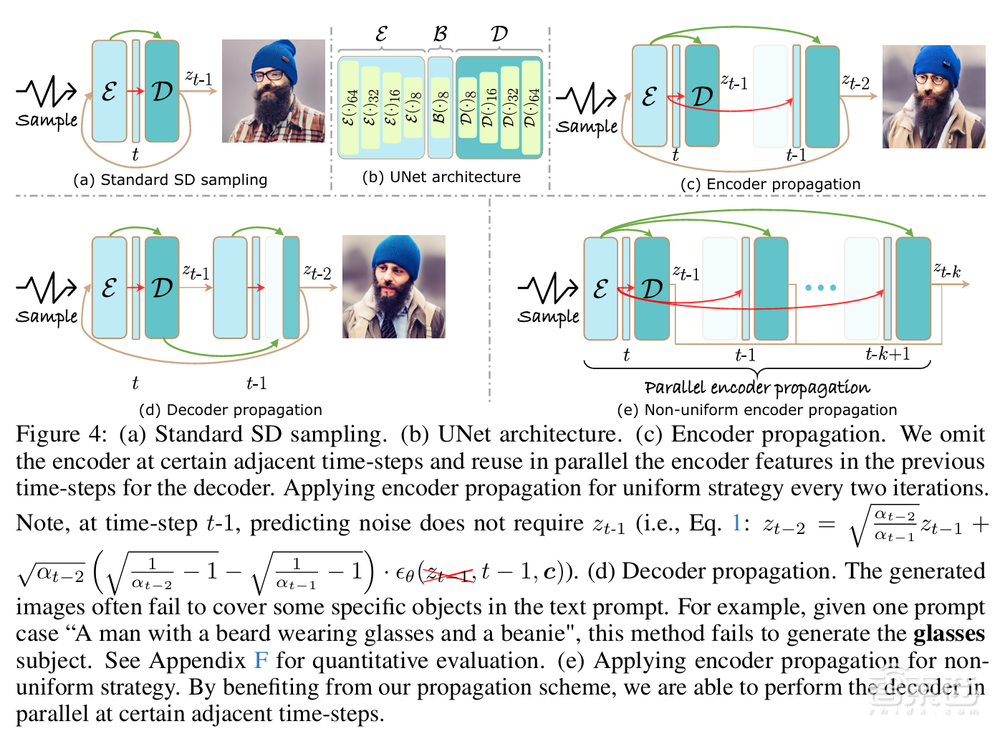

扩散模型中的一个关键组件是用于噪声预测的UNet。通过分析UNet在扩散模型中的特性,发现编码器特征在相邻时间步之间变化平缓,具有高度相似性。

为了实现无训练的加速扩散模型推理,Faster Diffusion通过在相邻时间步省略编码器计算,并重用前一步的编码器特征作为解码器输入;进而并行执行解码器计算,进一步加速去噪过程。

虽然编码器传播可以提高推理阶段的效率,但观察到它会导致生成结果中的纹理信息的轻微丢失。所以还引入了一种先验噪声注入方法来改善生成图像中的纹理细节。

实验证明,在不使用任何知识蒸馏技术的情况下,Faster Diffusion分别加速了StableDiffusion(SD)和DeepFloyd-IF模型的推理,速度提升了41% 和 24%;DiT模型的推理速度提升了34%,同时保持了高质量的生成性能。

11月1日10点,智猩猩邀请到论文一作、南开大学在读博士生李森茂参与「智猩猩AI新青年讲座」254讲,主讲《基于扩散模型编码器模块的推理加速》。

讲者

李森茂

南开大学在读博士生

导师是王亚星副教授。期间在巴塞自治大学LAMP组做过短期实习,导师为Joost van de Weijer。在此之前,在南开大学计算机学院获得硕士学位。主要研究包括生成模型、图像生成和图像到图像的转换等课题。

第254讲

主题

基于扩散模型编码器模块的推理加速

提纲

1、目前扩散模型推理速度慢的问题

2、UNet编码器和解码器在不同时间步的分析

3、并行处理加速扩散模型推理方案FasterDiffusion

4、实验效果展示

直播信息

直播时间:11月1日10:00

成果

论文标题

《Faster Diffusion: Rethinking the Role of the Encoder for Diffusion Model Inference》

论文链接

https://arxiv.org/pdf/2312.09608

项目网站

https://sen-mao.github.io/FasterDiffusion

如何报名

有讲座直播观看需求的朋友,可以添加小助手“米娅”进行报名。已添加过“米娅”的老朋友,可以给“米娅”私信,发送“ANY254”进行报名。对于通过报名的朋友,之后将邀请入群进行观看和交流。