近年来,基于激光雷达的场景生成技术正在迅速发展,但现有方法主要是生成静态和单帧场景,忽略了真实驾驶环境固有的动态特性。

为此,上海AI Lab联合CMU、NUS等提出一个4D动态场景生成框架DynamicCity,该框架能够生成大规模、高质量的动态4D点云场景。其中,CMU硕士在读、上海AI Lab科研实习生卞恒玮为论文一作,新加坡国立大学博士在读、上海AI Lab科研实习生孔令东为论文二作。

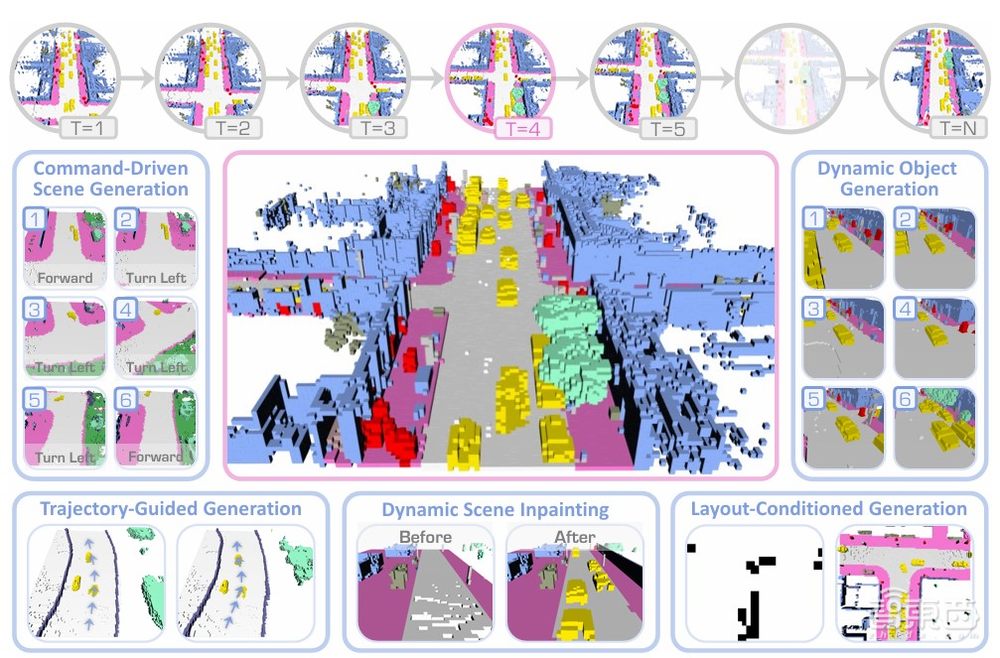

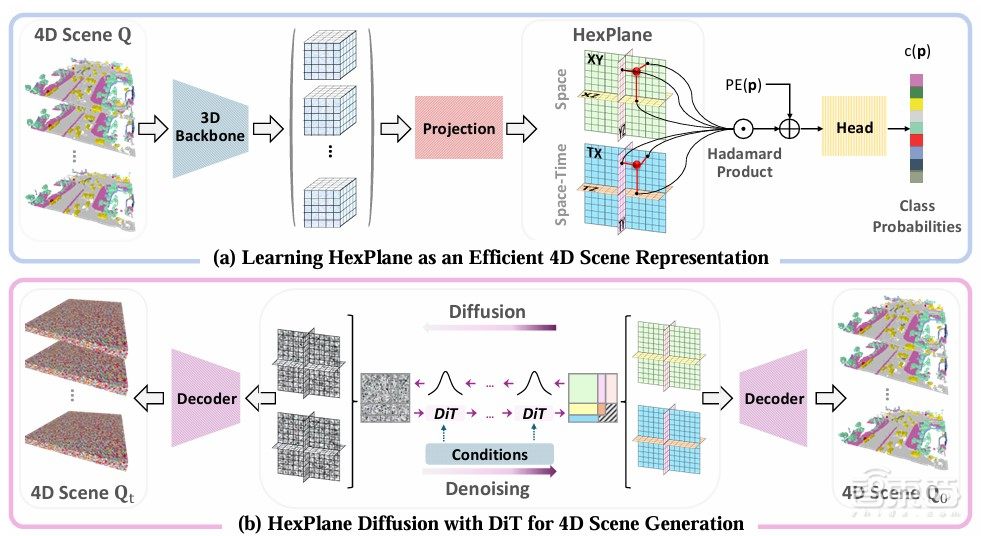

DynamicCity框架采用了VAE模型学习HexPlane作为紧凑的4D表示,结合新提出的投影模块和扩展压缩策略,显著提升了HexPlane的拟合质量、重建效率和精度。该框架还引入了“HexPlane展开”操作,结合基于DiT的扩散模型实现了HexPlane生成。

此外,DynamicCity框架通过条件化生成与HexPlane操控,支持多样化的4D动态场景生成应用,例如轨迹驱动生成 (trajectory-guided generation)、命令控制生成 (command-controlled generation) 、场景布局条件生成 (layout-conditioned generation) 以及场景和物体inpainting等,展现了优异的4D场景生成性能和广泛的应用前景。

1月23日晚上7点,智猩猩邀请到卡耐基梅隆大学硕士在读、上海人工智能实验室科研实习生,以及新加坡国立大学博士在读、上海人工智能实验室科研实习生孔令东参与「智猩猩新青年讲座自动驾驶专题」第43讲,主讲《大规模4D自动驾驶场景生成》。

讲者

卞恒玮,卡耐基梅隆大学硕士在读、上海人工智能实验室科研实习生

卡耐基梅隆大学硕士研究生在读,本科毕业于新加坡南洋理工大学。同期于上海人工智能实验室3D AIGC团队担任科研实习生,导师是潘亮博士。研究方向为大规模3D场景生成。相关研究成果发表于CVPR、NeurIPS、MICCAI等国际会议中。

孔令东,新加坡国立大学博士在读、上海人工智能实验室科研实习生

新加坡国立大学计算机系博士在读,本科毕业于华南理工大学。于上海人工智能实验室、英伟达研究院、字节跳动AI Lab等机构进行科研实习。研究方向为3D场景感知、理解与生成。相关研究成果发表于TPAMI、CVPR、ICCV、ECCV、NeurIPS、ICLR等国际期刊和会议中。

第 43 讲

主 题

《大规模4D自动驾驶场景生成》

提 纲

1、3D和4D生成概述

2、4D场景生成基础知识

3、4D动态场景生成框架DynamicCity

4、实验结果评估与分析

5、4D场景生成前景与应用

直 播 信 息

直播时间:1月23日19:00

成果

论文标题

《DynamicCity: Large-Scale LiDAR Generation from Dynamic Scenes》

论文链接

https://arxiv.org/abs/2410.18084

项目地址

https://dynamic-city.github.io

收录情况

ICLR 2025 在投

如何报名

有讲座直播观看需求的朋友,可以添加小助手“陈新”进行报名。已添加过“陈新”的老朋友,可以给“陈新”私信,发送“自动驾驶43”进行报名。对于通过报名的朋友,之后将邀请入群进行观看和交流。