🤖头图由智象未来AI大模型生成

智东西(公众号:zhidxcom)

作者 | 王涵

编辑 | 漠影

在演唱会、各大晚会的舞台上,机器人伴舞团以整齐划一、精准卡点的舞姿惊艳全场。这种整齐划一不仅是硬件的胜利,更是“训练有素”的结果。

具身智能训练的核心难点之一,就在于如何让模型在虚拟环境中学习到符合物理规律的真实交互能力,这也成为众多企业布局具身智能领域时难以跨越的门槛。

近日,专注于AIGC 视频大模型及应用的国产AI企业智象未来(HiDream),选择和具身智能企业诺亦腾机器人(Noitom Robotics)展开战略合作,通过“真实数据+虚拟增强”的方法,为行业提供可规模化的高质量具身训练数据。

这种跨界协同的模式,也为破解行业发展瓶颈提供了全新思路。

一、诺亦腾机器人提供真实数据种子,智象未来用生成式模型放大百倍

此次合作的核心就在于真实数据与生成式技术的结合,以及双方技术优势的互补。

真实数据的价值正在于其不可替代的物理关联性,是确保模型贴合现实的核心前提。而生成式技术的核心价值,就在于打破真实数据采集的视觉幻象,以及规模与多样性的局限。

诺亦腾机器人作为具身智能数据底座的构建者,依托高精度人体动作捕捉与多模态数据采集基础设施,为合作提供真实世界中精准的人类动作数据“种子”。

这些数据源自物理世界的真实交互,具备真实可靠的物理反馈,为模型训练奠定了真实的物理规律基础。

智象未来发挥其多模态大模型的毫米级高可控视频生成能力,扮演“数据炼金术士”的角色。

通过对诺亦腾机器人高精度采集的多模态Human-centric数据进行百倍以上的精细化放大与视觉多样化场景扩展和泛化,智象未来将精准的动作指令与丰富的视觉元素深度融合,不仅实现了数据规模的指数级增长,更确保了每一帧生成视频与底层动作数据的精准配对。

▲左:诺亦腾机器人数据采集原始场景 右:智象未来生成式模型生成式处理效果

双方公司多项深度技术合作之一,利用视频生成技术去除数据中的vision gap及视觉干扰项。

二、李飞飞“三层金字塔”之下:真实数据采集的两道难关

为什么要这样合作?想要回答这个问题,就要先搞清楚,具身智能的数据目前面临怎样的困境。

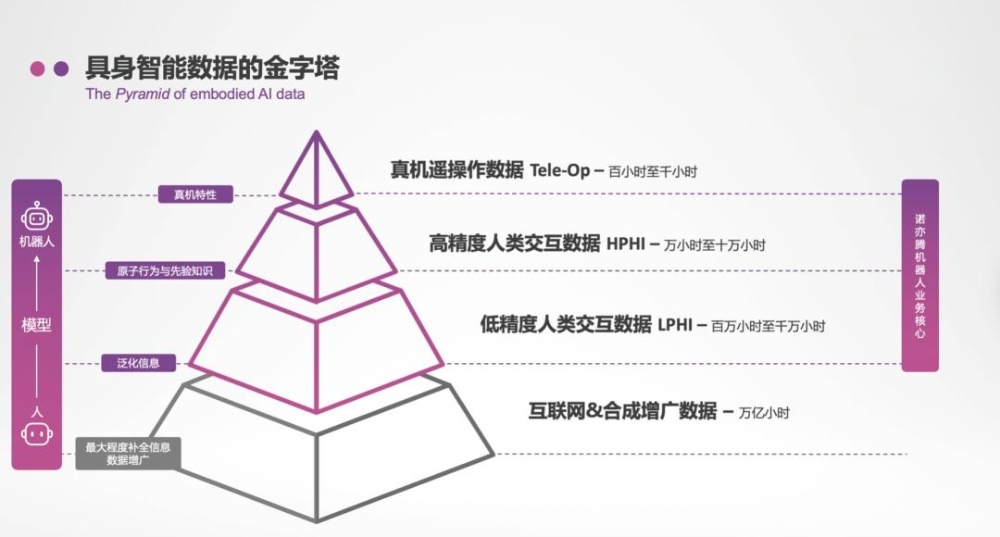

“AI教母”李飞飞曾提出“具身数据三层金字塔”概念:最底层为网络数据与人类视频层,中间层为仿真合成数据,最上层为真实机器人数据。

针对最上层和最底层,业界已经做了许多尝试,并且发现了两个最严峻的问题:

一方面,真实数据的采集成本与模型所需的视觉泛化能力之间存在固有矛盾。这一矛盾本质上是效率与质量的失衡,也是行业内长期难以调和的痛点。

标准化的环境能够显著提升采集效率,降低单位数据成本。但想要提升模型的视觉泛化能力,则需要多样化环境、多样化物体分布,覆盖复杂真实世界,以应对环境中的各种不确定性。

另一方面,在高精度、多模态数据采集的过程中,各类光学、惯性动作捕捉系统以及触觉采集装置的穿戴将会对人体形态、遮挡关系和整体视觉分布产生干扰,形成明显的「Vision Gap」。

如果对采集到的图像进行后期修复,虽然可以对局部区域进行填补,但效果通常差强人意,难以满足具身智能模型训练的数据质量要求。

这也让真实数据的应用受到了进一步限制。

三、探索数据生产的第三范式,数万小时数据已在路上

智象未来与诺亦腾机器人的合作正是针对以上行业痛点的精准破局,创造了一种全新的数据生产范式:真实采集+生成式大模型协同。

这种范式既规避了单一数据类型的短板,又实现了两者的优势互补,既保留了真实数据的物理一致性,又突破了传统采集方式在场景多样性与规模上的局限。

双方的协同试验表明,智象未来的生成式模型在消除视觉鸿沟方面表现极其优异,能够有效填补真实采集数据的视觉缺陷,生成符合物理规律的高保真训练数据。

通过这种“生成式去除Vision Gap”的技术路径,双方成功实现了训练数据的精度与合理性需求,能够规模化地生产出既真实又多样的训练数据。

这为训练一个能真正理解物理世界的“世界模型”提供了充足的“燃料”。合作双方预计,其年内合作生成的具身智能视频数据将达到数万小时以上。

结语:具身智能进入“混合数据”时代

2026年,被业内视为具身智能的“数据元年”,这一判断并非空穴来风。

过去几年,行业在“纯真实采集”与“纯虚拟仿真”之间反复摇摆,各自的天花板已清晰可见。真实数据精度高但成本陡峭、场景有限。仿真数据规模大但物理真实性存疑,难以跨越“仿真到现实”的鸿沟。行业里越来越多的人开始意识到,无论是只靠真实采集,还是只靠虚拟仿真,都走不远。

智象未来和诺亦腾机器人的合作,正好踩在了这个转折点上。

如今,智象未来与诺亦腾机器人的合作给业界提供了第三条路,即“真实数据+生成式扩展”的混合范式,将有望成为行业新的基础设施标准。

放眼整个行业,这种“真实捕捉数据+生成式大模型增强扩容”的混合路径,正在成为越来越多企业的选择。具身智能,正在进入“混合数据”时代。