芯东西(公众号:aichip001)

编译 | 刘煜

编辑 | 陈骏达

芯东西4月15日报道,今日,博通宣布扩大与Meta的合作,计划推出业界首款采用2nm工艺的AI计算加速器。博通将依托其XPU定制加速器平台,与Meta联合开发MTIA(Meta训练与推理加速器)系列计算加速芯片的后续迭代产品。双方计划第一阶段将为MTIA首批部署超1吉瓦(GW)规模算力,后续将逐步扩大算力部署规模。本次合作尚未披露相关金额。

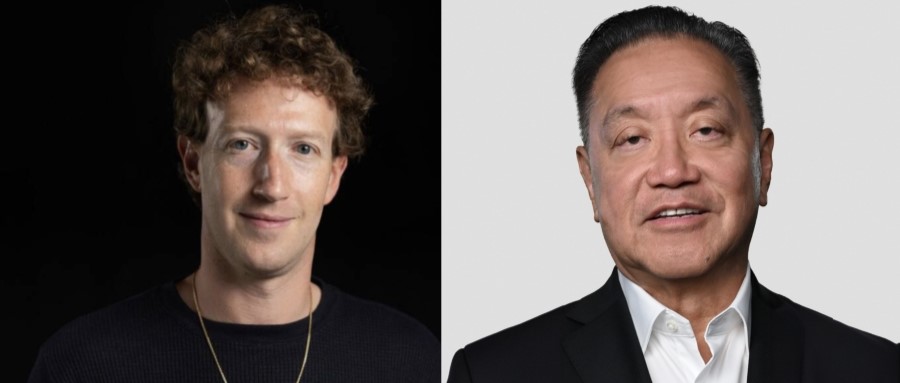

▲图为博通、Meta官宣合作(图源:X)

Meta创始人兼首席执行官马克・扎克伯格(Mark Zuckerberg)称:“Meta正与博通在芯片设计、封装与网络领域展开全面合作,我们首期将部署超1吉瓦的定制芯片,后续逐步扩展至数吉瓦规模。”

博通总裁兼首席执行官陈福阳说道:“此次MTIA的首期部署仅仅是一个开端。”

此前博通已与Meta基于MTIA定制AI芯片建立了深度合作,本次签订的协议将相关合作期限延长至2029年。同时,博通总裁兼首席执行官陈福阳将卸任Meta董事会董事,转任Meta顾问,为Meta的定制芯片路线图提供指导,并参与规划其未来基础设施投资方向。

博通称,此次与Meta的合作远不局限硬件供应,鉴于MTIA芯片主要通过推理与低精度运算实现最优运行效率,其配套的基础设施也需要具备近乎零延迟的性能表现。

而本次合作依托的XPU技术专为定制化AI加速器研发设计,可支持Meta在多代芯片迭代中持续优化AI基础设施。

博通凭借高端口密度以太网交换机、光互联产品、PCIe交换机及高速串行解串技术,能够提升单个MTIA服务器机架内部的计算带宽,并支持数万个计算节点实现大容量、跨区域的网络扩展,从而为Meta的AI算力集群提供低延迟、无阻塞以及高带宽的网络连接。

MTIA是Meta的AI基础设施战略的核心项目,其布局启动已久。

继早期Meta推出的MTIA 100与MTIA 200之后,该公司曾在今年3月宣布,未来两年内将研发并部署四代全新MTIA芯片,用以支撑平台内容排序、个性化推荐及生成式AI等核心业务的算力需求。

同月,陈福阳在博通财报电话会议上说道:“Meta的定制加速器MTIA计划依然在推进。我们现在已经开始量产,实际上,到2027年及以后,对于下一代的XPU我们将达到数吉瓦的规模。”

结语:定制AI芯片或成主流趋势,科技巨头布局密集加码

本次博通与Meta宣布达成的这项多年期、覆盖多代产品的战略合作,将为加快Meta AI计算基础设施扩张提供一定助力。

定制AI芯片相较通用芯片具备更高的能效比,可在AI算力基础设施大规模部署中有效降低芯片采购成本与电力消耗。在此背景下,不止Meta,多家企业均在持续加大定制芯片的布局与投入力度。

去年10月,博通与OpenAI达成合作,将共同部署规模达10吉瓦的定制推理AI芯片;今年1月,微软正式发布第二代自研推理AI芯片Maia 200,该芯片已在其美国爱荷华州数据中心落地,并计划逐步扩大部署规模;今年3月,博通又与谷歌达成长期合作,为后者生产用于训练与推理的TPU芯片,同期Anthropic也将获得算力规模达3.5吉瓦的TPU支持。

由此可见,在当前AI芯片赛道竞争日趋激烈的格局下,布局定制AI芯片或将成为科技企业提升算力效率和控制成本的重要趋势。