智东西(公众号:zhidxcom)

作者 | 李水青

编辑 | 心缘

智东西4月17日报道,继Qwen3.6-Plus发布后,阿里通义千问团队昨夜宣布开源混合专家(MoE)模型Qwen3.6-35B-A3B。

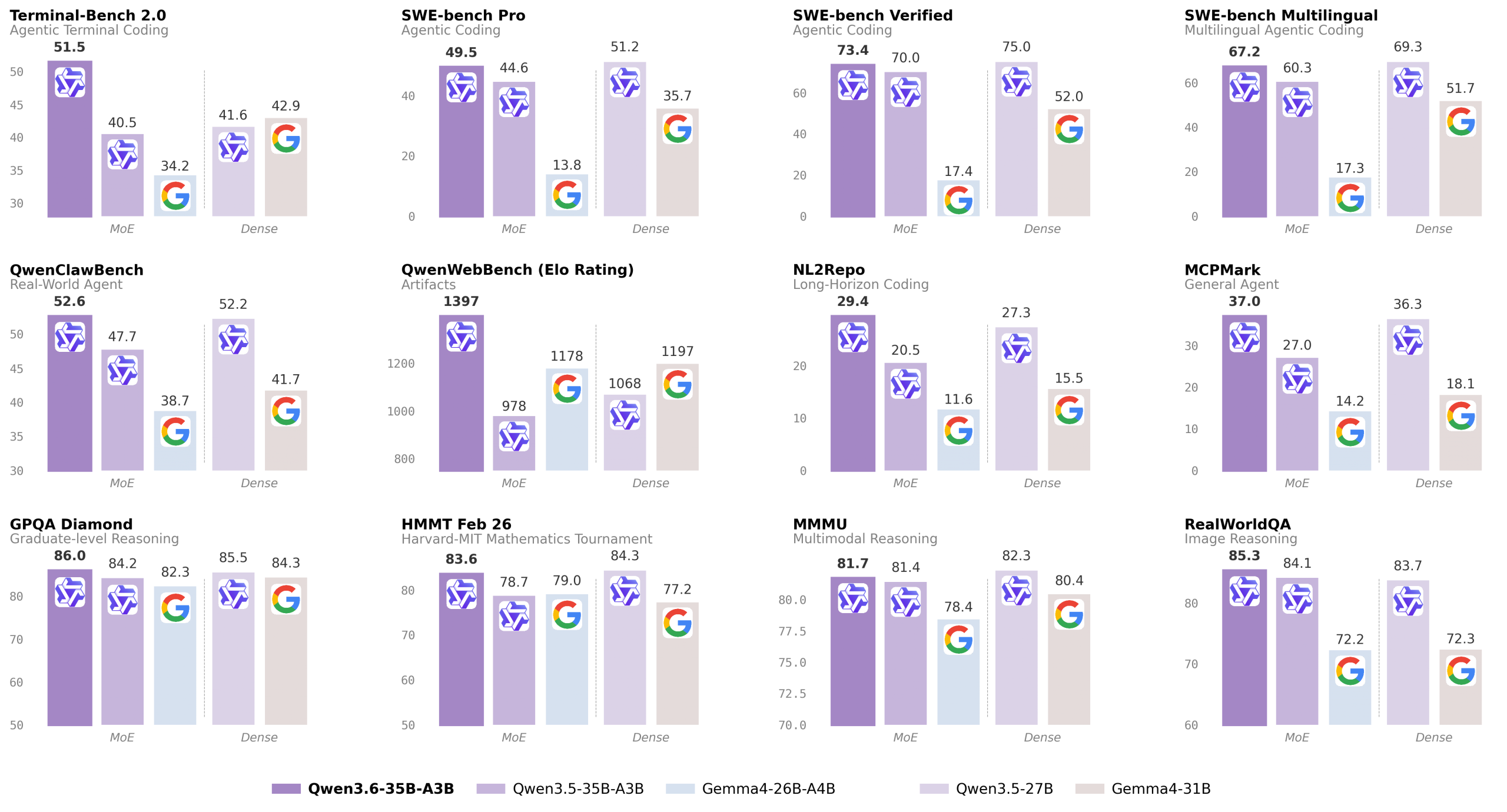

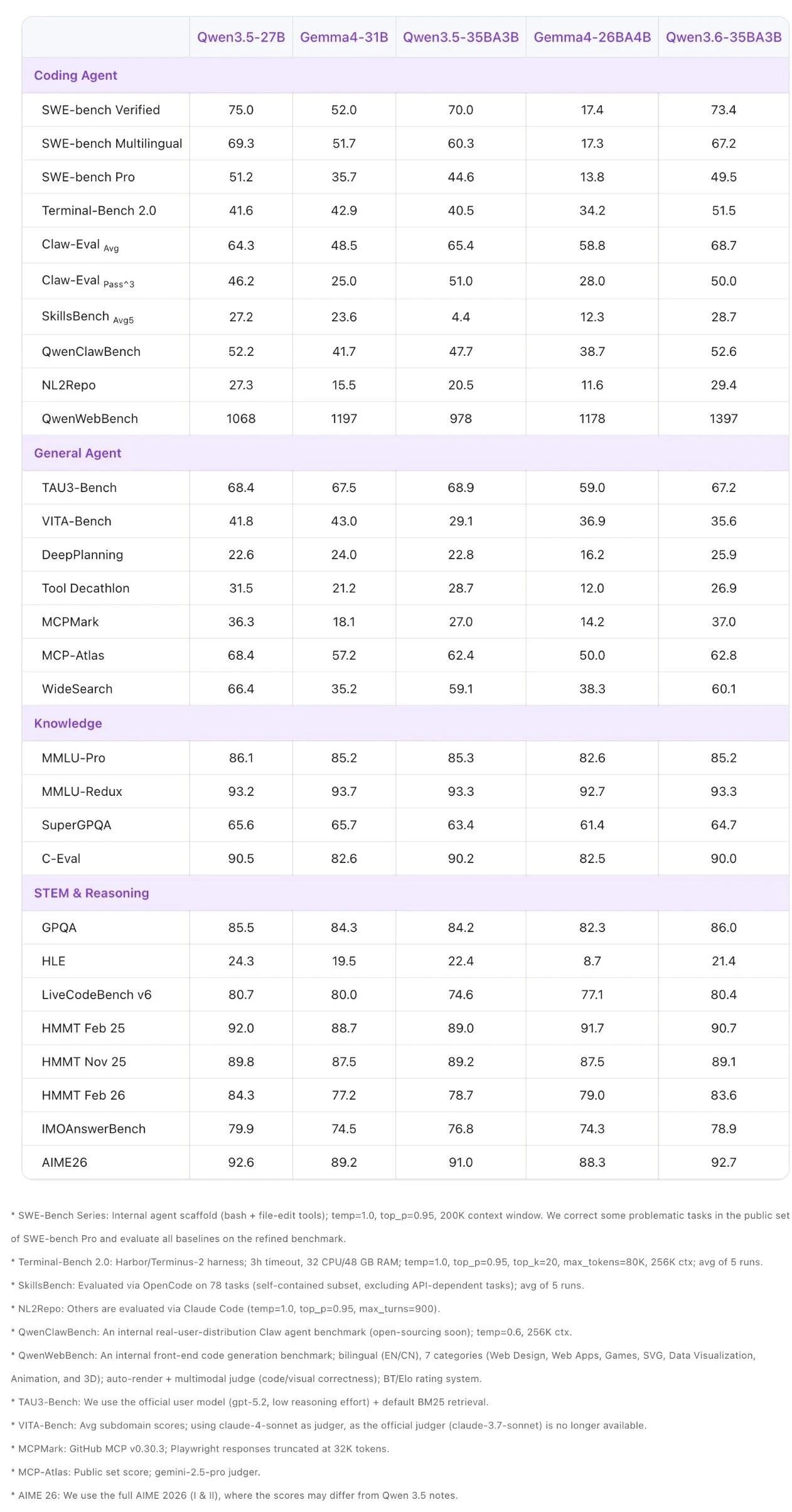

该模型总参数量350亿,激活参数仅30亿,主打轻量高效与智能体编程能力,测评超过谷歌4月最新发布的Gemma 4-26B-A4B、Gemma 4-31B以及阿里自己的前代Qwen3.5-35B-A3B,并具备强大的多模态感知与推理能力。

据官方披露,Qwen3.6-35B-A3B在多个关键编程基准上超越了上一代稠密模型Qwen3.5-27B,同时显著优于其前代MoE模型Qwen3.5-35B-A3B。

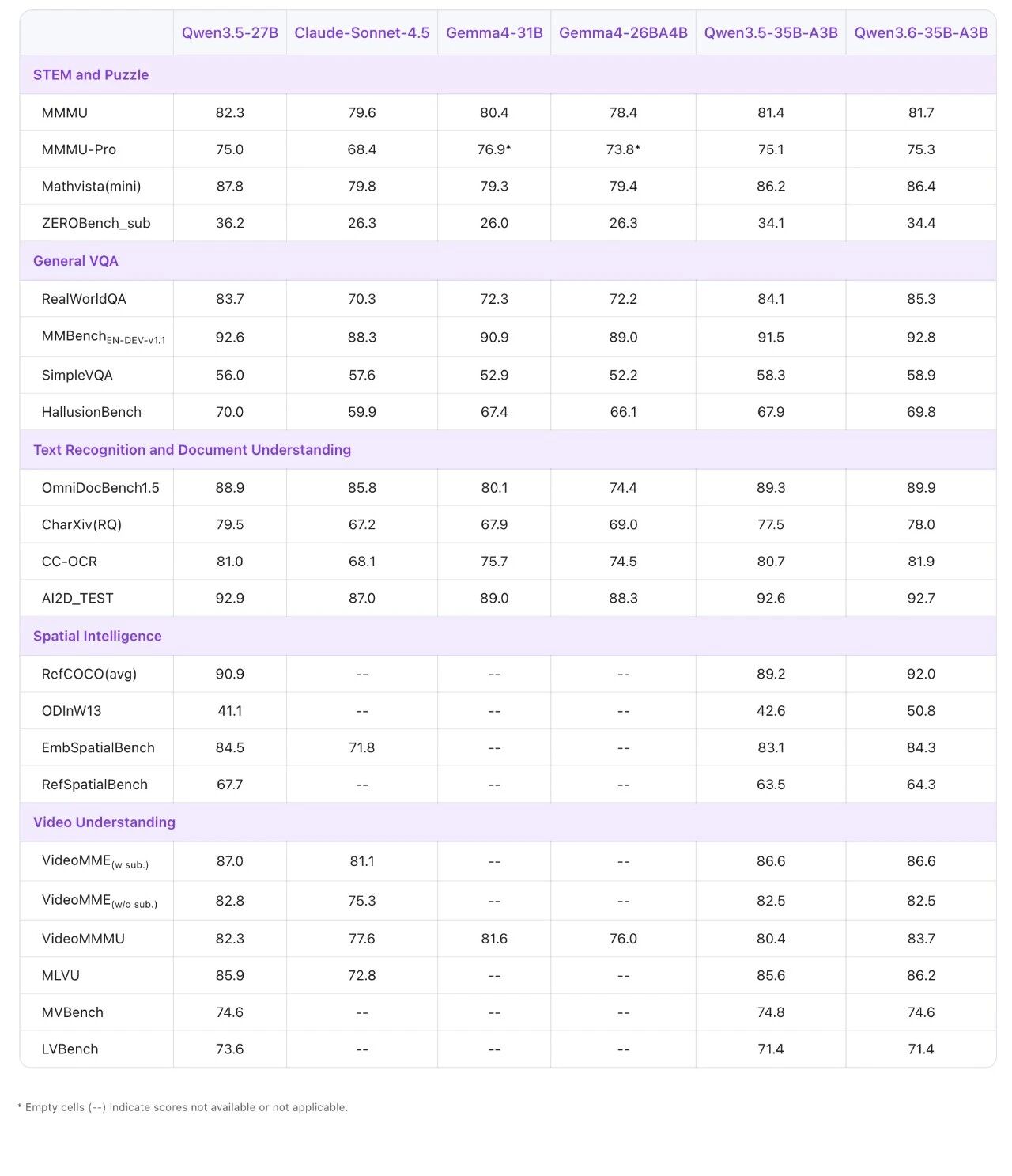

Qwen3.6-35B-A3B模型原生支持多模态,支持多模态思考与非思考模式,是当前最具通用性的开源模型之一。

在大多数视觉语言基准上,它的表现已与Claude Sonnet 4.5持平,甚至在部分任务上实现超越。其在空间智能上的优势尤为突出:RefCOCO 92.0、ODInW13 50.8。

智东西第一时间对Qwen3.6-35B-A3B进行了体验,发现其在指令理解上比较准确,能快速搜索近期热点,生成符合需求的应用代码。

比如当我输入“MBTI测试升级了,帮我生成一个SBTI测试的H5应用”,Qwen3.6-35B-A3B很快识别出这是一种基于荒诞、自嘲和解构的“梗系”测试,并成功生成了包括简易测试题和分析结果的H5应用。

该模型现在不仅可以免费试用,且已开源权重,支持本地部署。用户可在Hugging Face和ModelScope下载,也可通过阿里云百炼API以名称“qwen3.6-flash”调用,或在Qwen Studio进行交互体验。

API新增“preserve_thinking”功能,可在消息中保留所有前序轮次的思维内容,官方推荐用于智能体任务。

此外,Qwen3.6-35B-A3B已适配OpenClaw、Qwen Code和Claude Code等第三方编程助手,支持通过Anthropic API协议接入。

Qwen Studio地址:

https://chat.qwen.ai/

ModelScope地址:

https://modelscope.cn/models/Qwen/Qwen3.6-35B-A3B

Hugging Face地址:

https://huggingface.co/Qwen/Qwen3.6-35B-A3B