智东西(公众号:zhidxcom)

作者 | 江宇

编辑 | 漠影

当GPT images 2.0又再一次抢占头条,人们对多模态模型的关注也在悄然变化:“画得好”已经不再是问题了,我们还想要“速度快、效率高、成本低”。

过去很长一段时间里,视觉理解与图像生成,往往被拆分为两套体系:前者负责“看懂”,后者负责“画出”,中间通过不同模块进行衔接。这种在底层逻辑上的割裂,是阻碍模型效率的核心。

商汤这次的思路,是从架构层面直接处理这个问题。

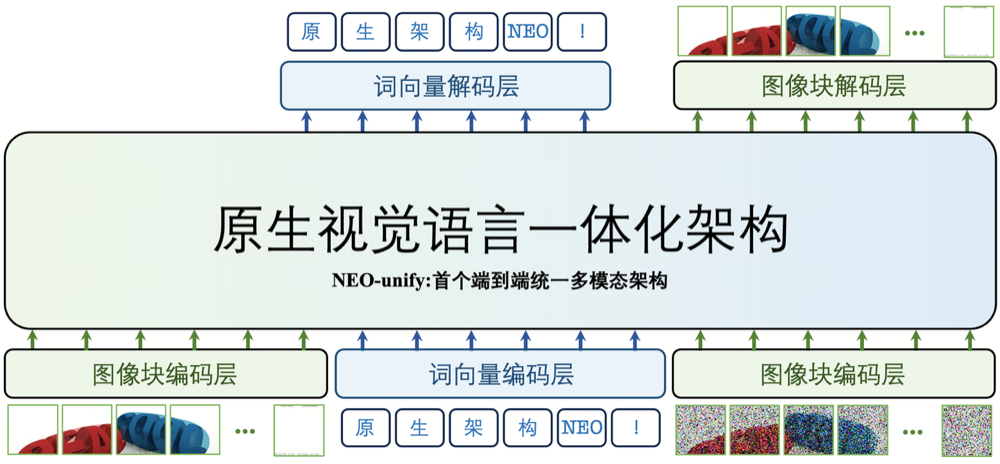

他们刚刚开源了原生理解生成统一模型SenseNova U1,便基于自研的NEO-unify架构,将图像与文本的理解与生成能力统一到同一体系中,没有了“中间商”之后,效率得到大幅提升。

在图像理解与生成的多项基准测试中,SenseNova U1 Lite在同量级开源模型中达到SOTA水平,并在多项指标上逼近商业闭源模型表现。以8B参数规模,实现接近更大模型的能力,得到“以小搏大”的表现。

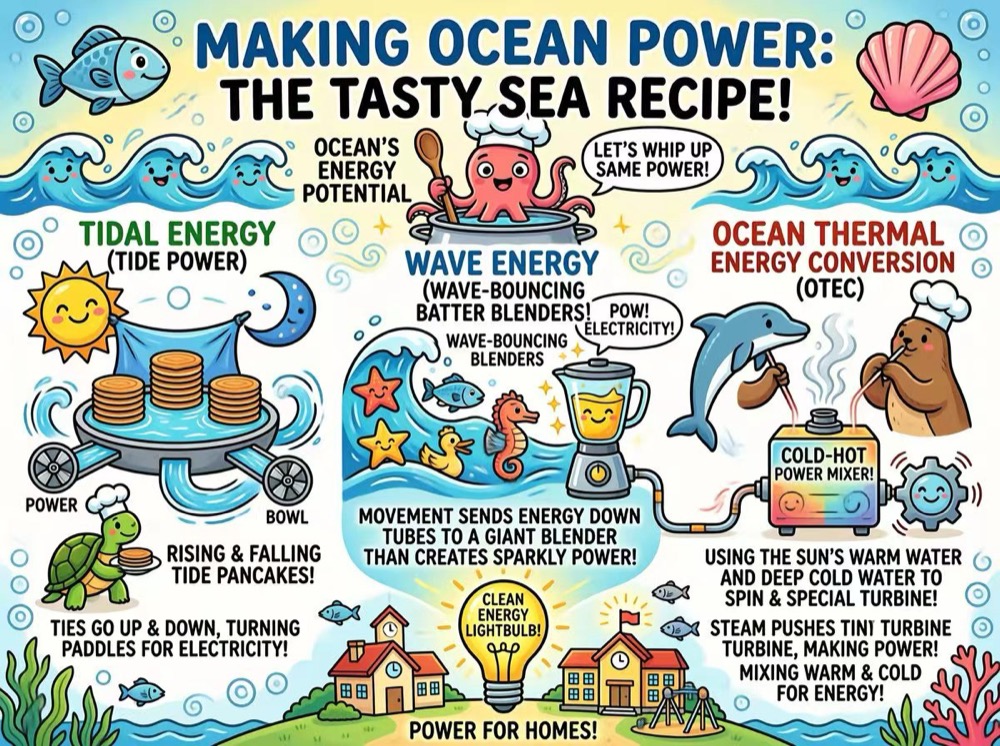

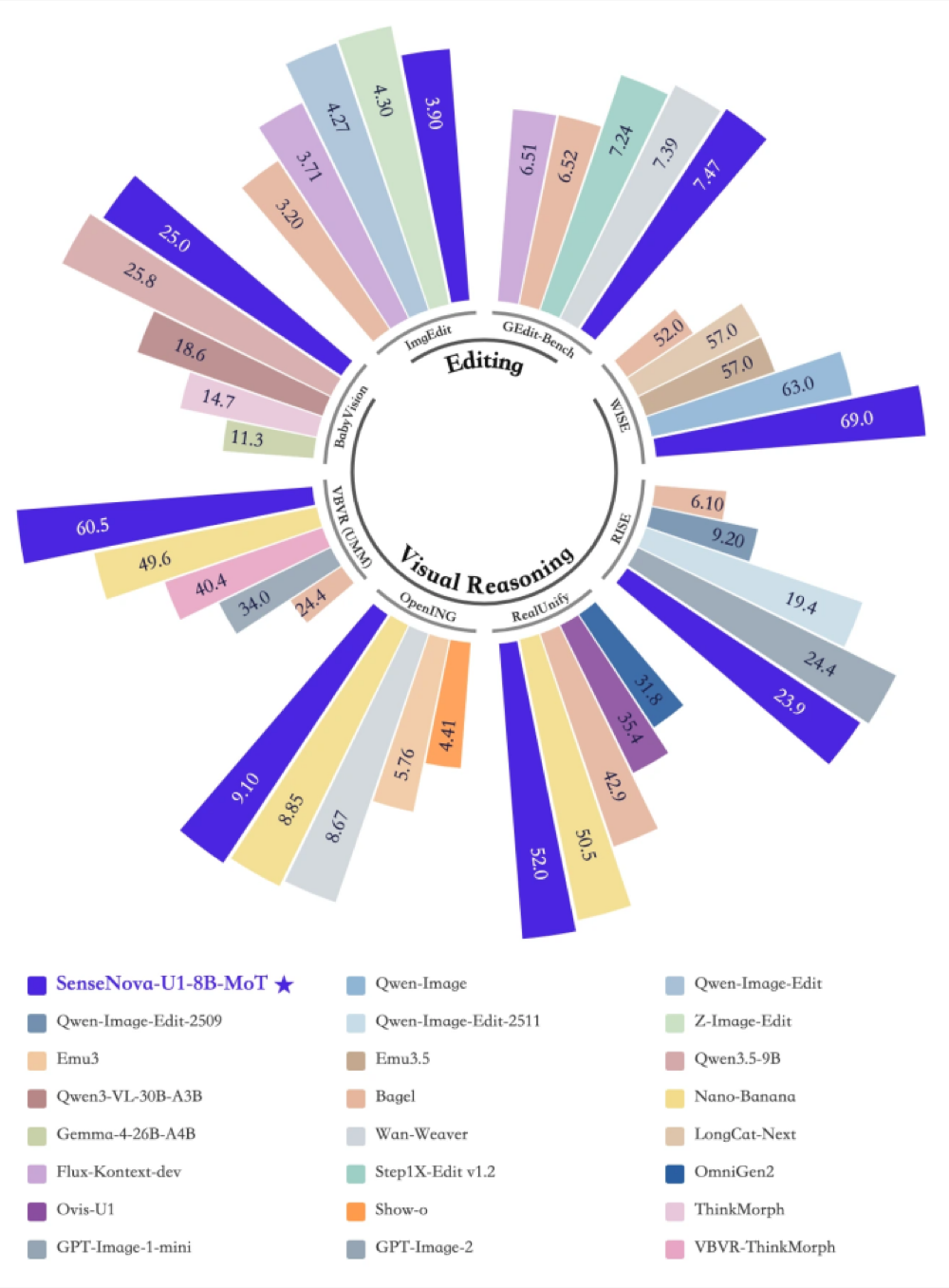

▲高密度信息图(en)

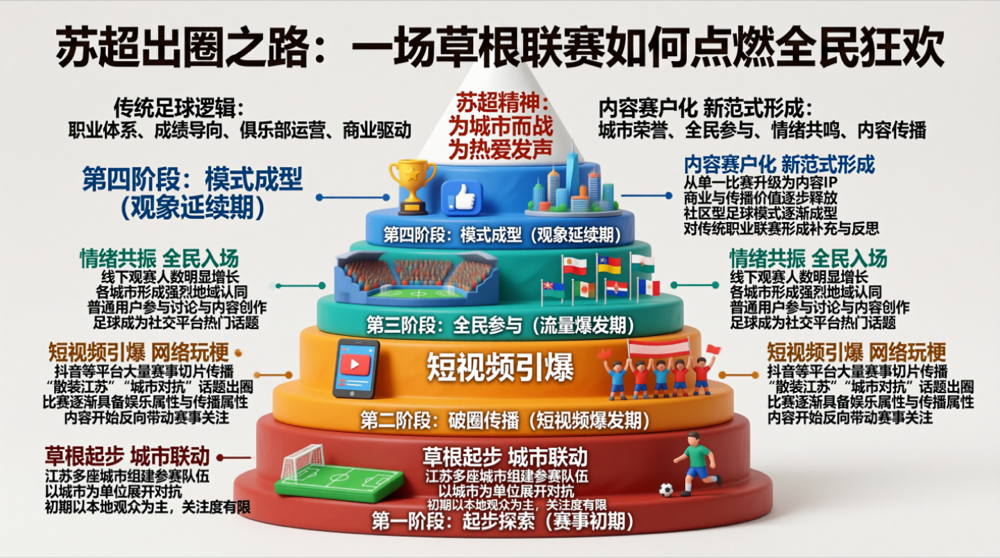

▲高密度信息图(zh)

目前,用户可以在Hugging Face、GitHub获取开源模型。同时,商汤AI办公智能体“办公小浣熊3.0”也即将接入SenseNova U1,用户可直接体验相关能力。

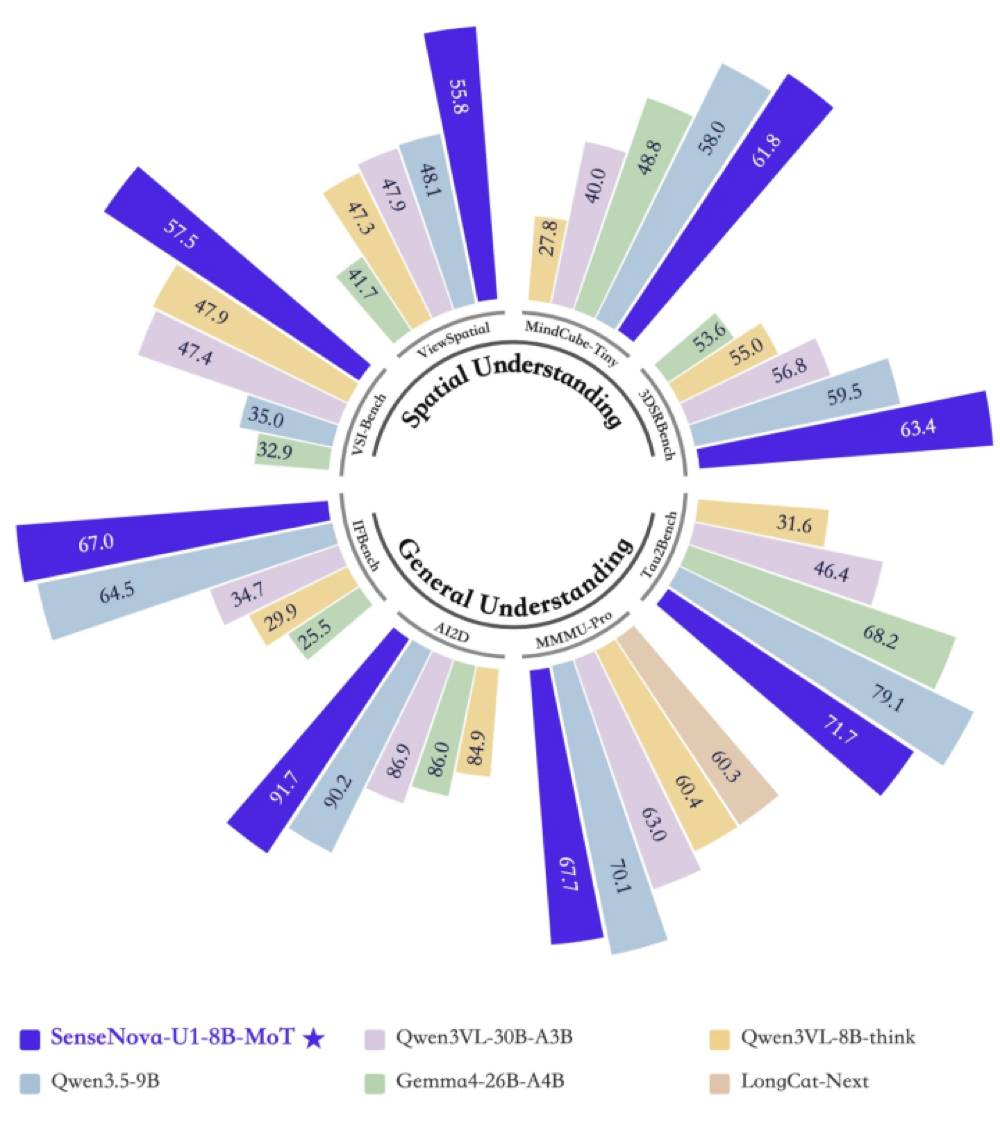

一、不靠堆参数,靠效率取胜:8B模型拿下开源SOTA

本次开源包含两个版本:SenseNova-U1-8B-MoT与SenseNova-U1-A3B-MoT,均基于统一的多模态理解、推理与生成架构,面向图文理解、生成及复杂交互任务。

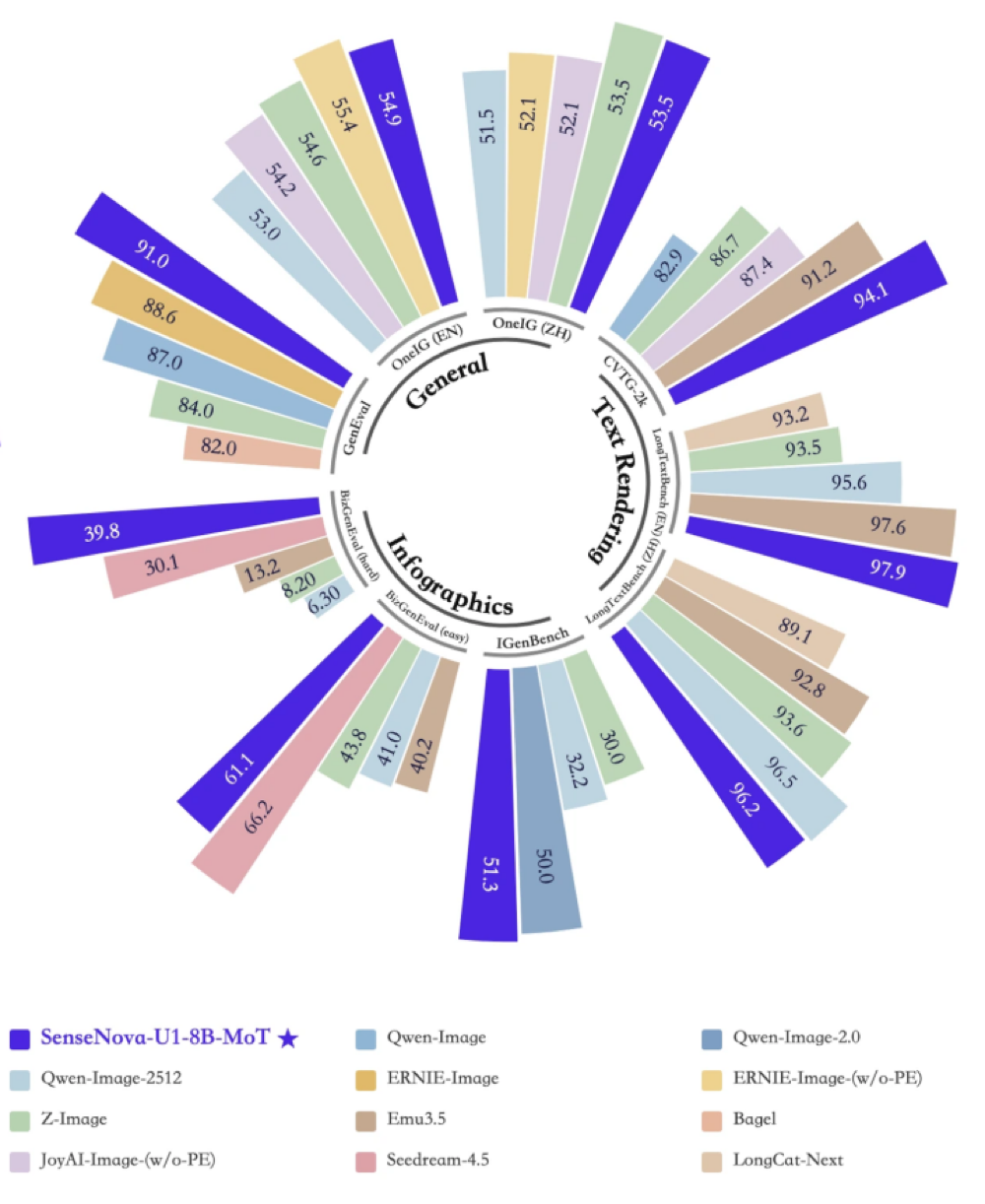

如果从测评结果来看,SenseNova U1最突出的优势,在于整体效率——在理解、生成、推理与图文交错多个维度上,用更小的模型规模,跑出了接近甚至逼近商业闭源模型的表现。

在理解侧,SenseNova-U1-8B-MoT在AI2D、IFBench等基准上均取得领先表现,例如在AI2D上达到91.7分。结合空间理解相关测试,可以看到模型在复杂结构与关系判断等任务中表现稳定,具备一定的逻辑推理能力。

在生成侧,模型在GenEval、OneIG、LongTextBench等任务中表现稳定,能够同时兼顾复杂结构生成与文本一致性。尤其是在信息图生成(Infographics)任务中,平均得分达到50.7,是开源模型最强,媲美部分闭源商业模型。

进一步看编辑与图文交错能力,在Editing、Visual Reasoning等任务中,SenseNova U1在WISE、VBVR、OpenING、GEdit-Bench等测试中表现突出。例如在OpenING相关任务中达到91分,在视觉推理任务中也明显优于传统图像生成模型。

但相比这些分项成绩,更关键的是它的“性能—效率比”。

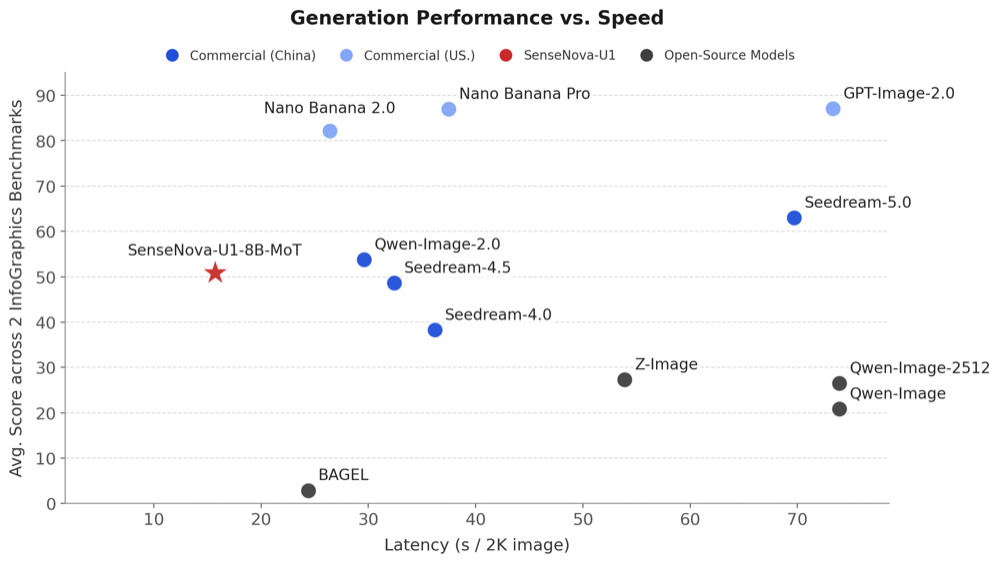

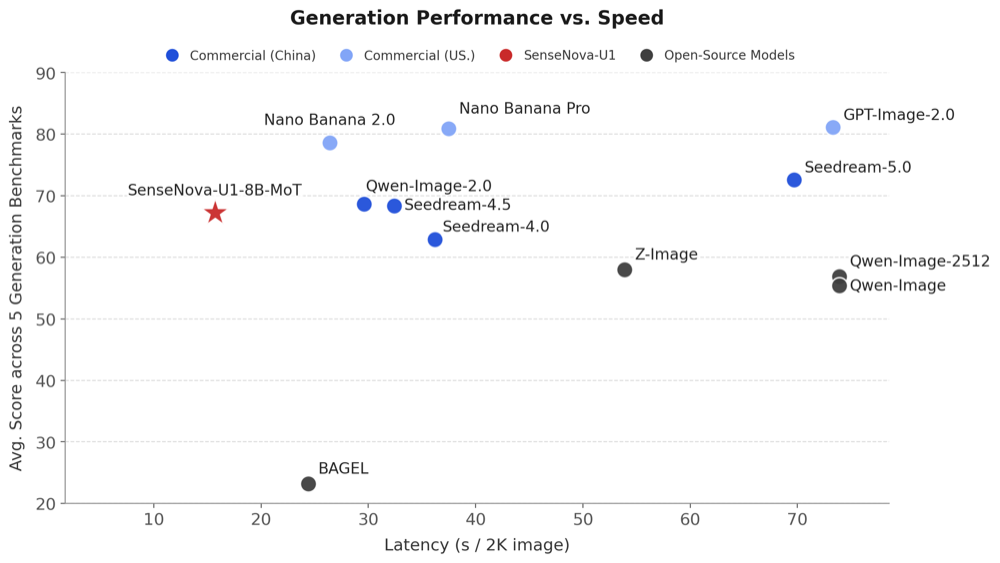

从对比结果来看,在信息图生成与长文本等任务中,SenseNova U1在约15秒延迟下即可取得接近60分的平均成绩,整体属于“高性能、低延迟”。对比Qwen-Image 2.0 Pro、Seedream 4.5等模型,其在生成质量接近商业闭源模型的同时,响应速度更快。

▲Generation Latency vs. Averaging Performance on Infographic Benchmarks, i.e., BizGenEval (Easy, Hard), and IGenBench

▲Generation Latency vs. Averaging Performance on OneIG (EN, ZH), LongText (EN, ZH), BizGenEval (Easy, Hard), CVTG and IGenBench

这些性能表现背后,主要还是来自底层架构的优势。SenseNova U1基于商汤自研的NEO-unify原生统一架构,在设计上减少了中间环节带来的信息损耗,因此在数据利用效率和推理开销上更有优势。

最终呈现出来的,才得以是“以小搏大”的优势:仅用8B参数规模,在多个维度达到同量级开源模型SOTA,并在部分任务上逼近商业闭源模型。

从测评结果来看,这种优势已经比较清晰。至于落到真实使用场景中,SenseNova U1是否同样稳定、好用,我们来实测一番。

二、一手实测揭秘:从立体排版到“言出法随”

智东西选取了多个不同类型的任务进行测试,覆盖高密度信息图、趣味创意图以及技术流程图等典型场景。

创作信息图可以说是最能“精准击中”职场人的能力。用户只需要输入文章、资料或文字说明,模型就能将其中的关键信息提炼出来,并生成一张具备结构、层级和视觉重点的信息图。

在“苏超出圈之路”这一案例中,模型就生成了一张多层蛋糕式信息图。不同阶段以立体分层形式呈现,文字随着结构自然分布在不同空间层级中,而不是简单平铺。

这背后其实反映的是模型对结构的理解能力。更关键的是,在这种复杂排版下,整张图没有出现明显的文字错位、遮挡或渲染错误,整体可读性很高。

换一个更复杂的文本场景来看,模型对富文本结构的理解能力,体现得更明显:哪些信息需要突出,哪些适合做流程,哪些更适合用图表表达,哪些需要用图标辅助理解。

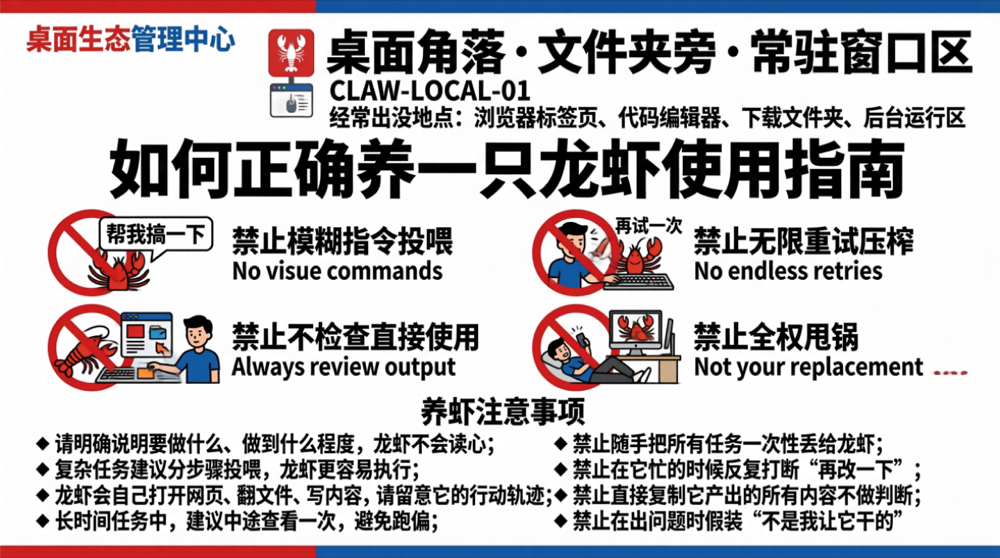

“龙虾使用指南”这个案例,就更能体现细节处理能力。

这一任务中包含大量中英文混排、不同字号文本以及情绪化表达。模型不仅把“禁止模糊指令”“禁止无限重试”这些核心文案写对了,还自动匹配了对应的图标和带情绪的画面,比如龙虾被“压榨”、被“投喂指令”等。

不同模块之间的文字大小、间距和布局都处理得较为合理,没有挤在一起,已经达到直接商用的水准了。

在人物与指令理解方面,“马斯克vs奥特曼”这一案例更具代表性。

在提示词中仅输入“奥特曼”这一昵称,模型直接生成了一个穿西装的“奥特曼形象”,与旁边的马斯克形成对比,既符合语义又带有明显的趣味性。与此同时,马斯克的表情、动作以及整个对峙氛围也都比较到位,可见模型在人物理解和场景构建上具备较强的语义对齐能力。

到了技术表达这一步,难度其实更高。在“SenseNova U1技术解读”这一案例中,模型需要生成的是一张逻辑清晰的技术流程图。

从结果来看,整体结构层级清晰,信息分区明确、表达直观,对于非技术读者也较为友好。

一轮实测下来,另一个比较直观的感受是速度。这类图像的生成基本都在十几秒内完成,有点接近“言出法随”的感觉。

在这样的生成效率下,各种应用场景也不在话下。目前,SenseNova U1可生成信息图谱、专业简历、生活指南、产品说明、百科知识、漫画创作等多种内容。对营销、办公、设计、商业分析等场景来说,这类能力直接对应的是内容生产效率提升。

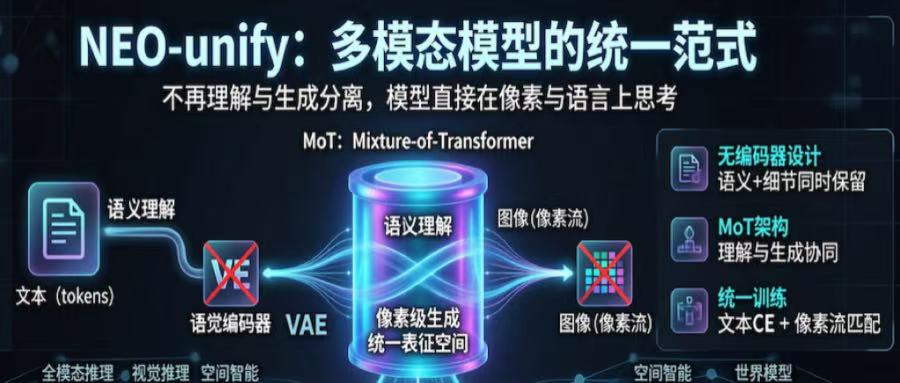

三、告别“缝合”,NEO-unify架构如何成为理解与生成的“通才”?

测评集成绩有优势,实测效果也毫不逊色,这个原生框架究竟好在哪里,我们来拆解一下。

过去,多模态模型的工作方式更像是“分工协作”:视觉编码器负责理解图像,变分自编码器负责生成图像。前者看图,后者画图,中间再通过不同模块完成衔接。

理解与生成更像两条并行的流程,能配合,但很难真正融合,所以SenseNova U1这次选择直接推倒重建,从底层架构上直接改掉这套“拼接式”体系。

其采用的自研NEO-unify架构,不再把语言和视觉当作需要中间转换的两种信号,而是从一开始就把它们当作同一类信息来建模。

换句话说,语言与视觉不再各走各路,在同一套表征体系里共同参与理解、推理和生成。

这种设计本质上回到了“多模态AI第一性原理”:不同模态之间本来就是内在关联的。

在具体实现上,模型尽量减少中间压缩与转换环节,直接从接近原始的像素和文本信息中学习,让信息在传递过程中损耗更小。

同时,它的数据和推理效率也更高。这也是SenseNova U1值得关注的地方:并不是单纯靠堆参数规模换效果,而是在底层架构上重新处理多模态模型的协作方式。

四、当AI学会“带图思考”,展开空间智能更多想象

不同于GPT-image2单纯图像上的“卷王体质”,SenseNova U1也展示了另一种可能:让图像成为逻辑的一部分,并在推理过程中引入对空间结构的理解。

这也是其“连续性图文创作输出”的能力核心。

SenseNova U1是业内首个能够在单一模型上进行连贯图文交错生成的模型。这意味着,在处理复杂任务时,模型可以一边解释逻辑,一边生成对应的示意图、流程图、草图或设计图。

例如在教程、在绘本故事等场景中,它可以让文字叙事、插图风格、人物事件等保持一致性与连贯。

同时,SenseNova-U1并不是先生成一段完整文字,再去“补图”,而是从材料准备或构图草稿开始,一步步输出关键操作,并同步生成对应画面。

整个生成过程是连续的:步骤之间有承接关系,图像之间保持风格一致,文字和视觉内容也始终围绕同一上下文展开。这种连贯性,在过去依赖多模型串联的方案中很难稳定实现,往往会出现风格漂移或信息断裂。

本质上,这得益于SenseNova U1所具备的原生图文理解生成能力,能天然将图像和文本底层融合信号完整的保留上下文中,在统一表征空间进行高效连贯思考。

这也让它和空间智能产生了更直接的联系。空间智能关注的是模型如何理解位置、方向、布局、关系和结构,而这些能力恰恰会在图像生成、高密度信息图排版、流程图构建和场景示意中反复出现。

如果继续往后看,这类能力也可能成为具身智能的重要基础。机器人要在真实环境中完成任务,不仅要“看见”物体,还要理解物体之间的关系、判断行动路径,并根据任务目标做出连续决策。

从这个角度看,SenseNova U1的意义不只是生成更好看的图,而是在单一模型中尝试打通理解、推理和视觉表达。它距离真正成为机器人的“具身大脑”还有距离,但这类统一架构,至少提供了一条更接近多模态闭环的技术路径。

结语:理解与生成走向统一,多模态模型进入分岔口

从底层架构的NEO-unify创新,到应用层面的原生图文交错与高密度信息图生成,商汤的全面开源,不仅是参数规模上的“以小搏大”,更是对多模态第一性原理的深度回归。

当行业还在讨论生图模型的真实边界时,SenseNova U1已经通过理解与生成的统一,为AGI的到来铺就了一条更具效率的路径。

开源的力量将让这种原生多模态能力迅速渗透进每一个垂直行业,我们正在见证的是一个“图文同构、思画合一”的全新时代的开启。

在大模型全球竞赛的下半场,国产模型正在输出属于自己的硬核解法。