4月21-22日,GenAICon 2026 | 2026中国生成式AI大会(北京站)将在北京富力万丽酒店正式举行。中国生成式AI大会已成功举办四届,现已成为国内人工智能领域最具影响力的产业峰会之一。

本次大会由智一科技旗下智东西联合智猩猩发起主办,为期两天,由开幕式+专题论坛+研讨会+交流晚宴+展览区组成,将以“奔赴AGI 重塑未来”为主题,邀请70+位重量级嘉宾与会带来致辞、报告、演讲和对话。

其中,开幕式将于4月21日上午在主会场+分会场一拉开帷幕;4月21日下午主会场将进行AI算力基础设施专题论坛,大模型专题论坛、AI智能体专题论坛则将于4月22日在主会场依次进行。

同时,大会首次开设了六场闭门技术研讨会,分别于分会场一和分会场二进行。

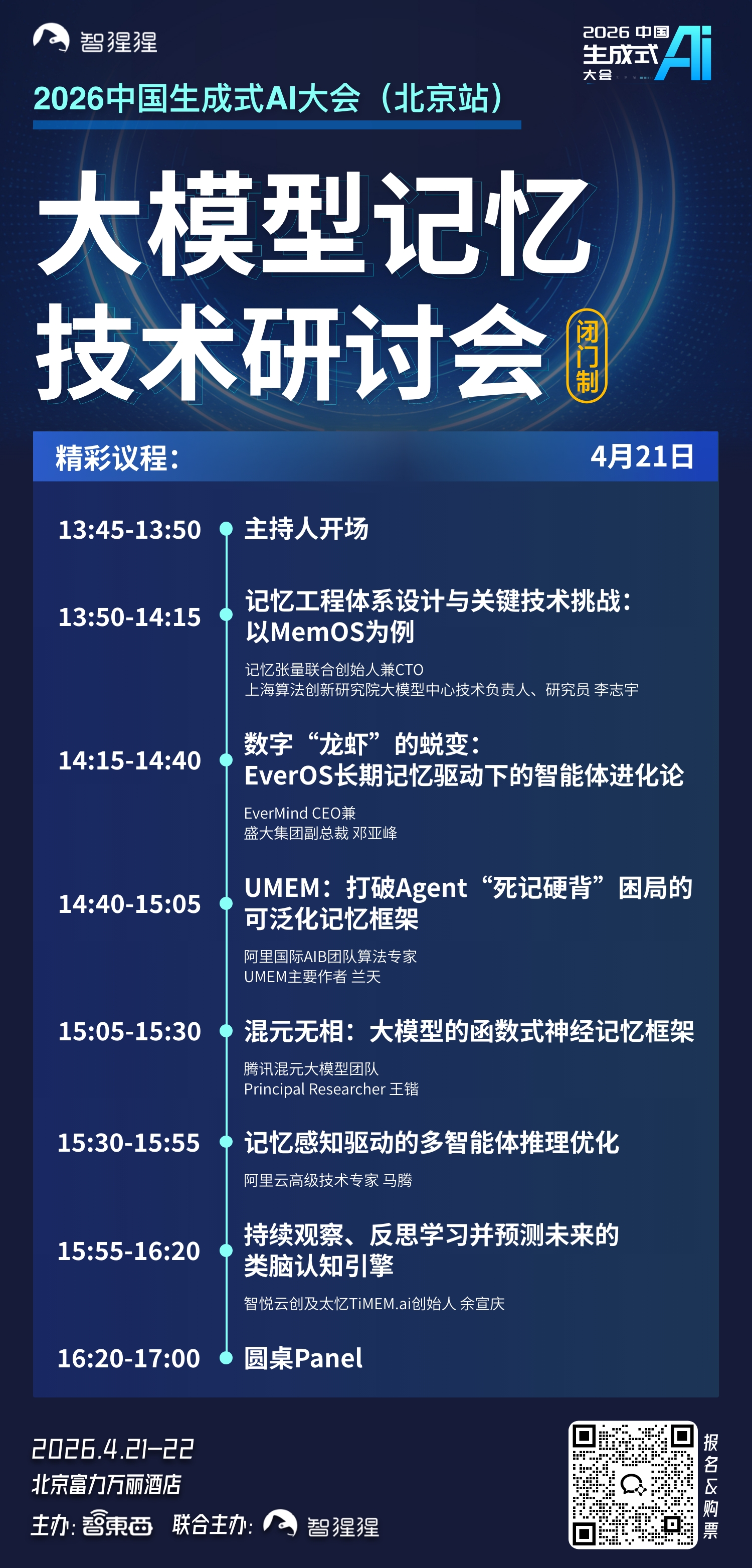

分会场一将于4月21日下午进行大模型记忆技术研讨会,4月22日则将依次进行LLM强化学习技术研讨会、LLM推理系统技术研讨会;分会场二将于4月21日下午进行生成式世界模型技术研讨会,4月22日则将依次进行OpenClaw技术研讨会、视频生成技术研讨会。其中,研讨会主要向持有大会通票和贵宾票的观众开放。

今年,在大会同期也设有人工智能创新展览区,以标展形式为主,将展示人工智能产业链优秀企业的创新技术、产品与方案,展商预计将覆盖大模型、AI智能体、AIGC应用与AI Infra等方向。

今天起,将陆续揭晓此次六场研讨会板块的议程,首先公布的是大模型记忆技术研讨会。其他研讨会、论坛、开幕式的议程也会陆续公布。

一、大模型记忆技术研讨会议程出炉 聚焦解锁超级智能的新共识

AI的记忆能力,正成为继Scaling之后解锁超级智能(ASI)的新共识,开始掀起AI领域新一轮热潮。

去年下半年谷歌发布重磅论文“Nested Learning: The Illusion of Deep Learning Architectures”,提出一种全新的学习范式——嵌套学习,引入HOPE架构开启了LLM记忆能力的新纪元。这篇论文更是被誉为“Attention is all you need”的V2版本。

也在去年底,清华大学唐杰教授在年终感悟中,更是指出“实现模型记忆成为一个必须做的事情”,并强调“这也是一个模型应用到真实环境必须有的能力。”

进入2026年,DeepSeek开年发表的关于引入Engram模块以实现条件记忆的论文,不仅引发了AI圈的广泛热议,而是将大模型记忆的研究推向了新高度。而随后在国内外掀起巨大热潮的OpenClaw,其亮点之一仍然是记忆。

而随着国内更多AI大厂、创业公司的持续涌入这一领域,更是推动从前沿研究、工程开发到产品实践等多方面的全面突破和百花齐放。

在上述背景下,大模型记忆技术研讨会将在此次大会同期举行。这场研讨会将在大会首日下午的分会场一进行,由主题报告+圆桌Panel两个环节组成。

目前,大模型记忆技术研讨会邀请到记忆张量联合创始人兼CTO、上海算法创新研究院大模型中心技术负责人、研究员李志宇,EverMind CEO兼盛大集团副总裁邓亚峰,阿里国际AIB团队算法专家、UMEM主要作者兰天,腾讯混元大模型团队Principal Researcher王锴,阿里云高级技术专家马腾,智悦云创及太忆TiMEM.ai创始人余宣庆等六位技术大咖与研究人员作为报告嘉宾带来分享。

研讨会的完整议程也已出炉。

二、六位技术大咖与研究人员将分享 报告主题和概要抢先了解

嘉宾:记忆张量联合创始人兼CTO、上海算法创新研究院大模型中心技术负责人、研究员 李志宇

简介:李志宇,博士,上海市东方英才拔尖人才,记忆张量(上海)科技有限公司联合创始人兼CTO、上海算法创新研究院大模型中心技术负责人、研究员。长期从事预训练和大模型应用方向的研发技术攻关,主要研究方向包括大模型记忆增强、高效评估与应用算法。曾在阿里巴巴、小红书等头部科技企业带队承担多个核心算法方向,技术成果服务于商品评价、双十一大促、营销广告等超大规模业务场景,累计带来数十亿营收,影响用户近亿人次,并获得双十一技术突破奖。近年来,先后和团队提出了首个记忆分层的创新架构大模型,以及业内首个大模型记忆操作系统(MemOS),MemOS开源7个月累计获得Star数超6100+,开发者数超11000+,为大模型的记忆增强落地提供了可行的探索路径。相关大模型技术成果已在中国银行、招商证券、中国电信、新华社等多家国央企落地应用。当前已在Patterns(Cell Press)、NeurIPS、ICLR、ACL和TKDE等国际会议期刊发表论文70余篇、授权专利10余项。现任中国中文信息学会信息检索专委会委员、大模型与生成专委会委员,相关研究工作入选《麻省理工科技评论》封面报道、《机器之心》、《量子位》和《PaperWeekly》的头条报道,并多次登顶Huggingface热点论文Top1。

主题:《记忆工程体系设计与关键技术挑战:以MemOS为例》

概要:随着大模型和智能体逐步进入真实业务环境,系统所面临的核心问题,已经不再只是“能不能回答”,而是“能不能持续地记住、调用、更新并治理知识与经验”。在这一背景下,记忆正从附属能力走向系统能力,成为影响智能体长期一致性、任务连续性、个性化服务与可控演化的关键基础设施。如何构建一套可写入、可检索、可更新、可治理的记忆体系,正在成为大模型工程落地中的重要课题。本次分享以MemOS为例,围绕“记忆工程体系设计与关键技术挑战”展开系统介绍,重点讨论面向长期智能的记忆分层架构、记忆写入与组织、记忆检索与调度、记忆更新与演化、记忆治理与安全控制等核心问题。同时,也将结合实际工程经验,分析当前记忆系统在落地过程中面临的若干关键挑战,包括记忆污染与冲突、长期一致性衰减、跨任务复用困难、成本与时延约束,以及隐私、权限与合规治理等问题。希望通过 MemOS 的实践,进一步说明:在大模型时代,记忆不应只是外挂模块,而应被建设为支撑长期智能体演化的基础设施层。

嘉宾:EverMind CEO兼盛大集团副总裁 邓亚峰

简介:邓亚峰,毕业于清华大学,正高级工程师,拥有二十余年人工智能算法及产品研发经验。现任EverMind CEO兼盛大集团副总裁。曾任360集团副总裁、人工智能研究院院长兼搜索事业部总经理,科创板首家AI上市公司格灵深瞳CTO。荣获2021年中国人工智能年度十大风云人物,教育部技术发明奖二等奖。长期致力于大语言模型、计算机视觉及AI for Science等领域的研究与应用,带领团队多次在国际国内主流AI评测中获得佳绩;累计申请发明专利160余项(已授权98项),发表论文50余篇(含10篇Nature子刊)。

主题:《数字“龙虾”的蜕变:EverOS长期记忆驱动下的智能体进化论》

概要:在本talk中,首先会结合OpenClaw和近期行业的热点事件,阐述未来Agent的发展趋势;其核心认知是,从通用大模型向具备长期记忆和自我演进能力的Agent跨越,正是当前最具商业和技术落地价值的深水区。在基础模型蓬勃发展之上,Agent的核心价值和壁垒将主要取决于长期记忆能力。其次,将递进介绍长期记忆的价值:如何更高效地利用上下文(Efficiency);如何记住用户偏好(Alignment);如何形成自我演进(Evolution)。进一步,结合我们在长期记忆方向所做的主要工作,特别是EverOS(定位为AI时代的长期记忆操作系统)和MSA(Memory sparse attention)Model,讲述我们在相关方向取得的技术进展,以及对未来技术发展趋势的认知。最后,将结合具体的案例说明长期记忆的用户价值。

嘉宾:阿里国际AIB团队算法专家、UMEM主要作者 兰天

简介:兰天,毕业于北京理工大学,现任阿里国际AI Business团队算法专家,聚焦于Long-horizon Agent相关技术的前沿研究与业务落地。在ICLR、NeurIPS、ACL、EMNLP、TOIS等顶级学术会议与期刊上发表多篇代表性工作,包括Copy is all you need、Block-attention、Contrastive search等,Google学术累计引用量1500余次。在人工智能与自然语言处理领域拥有扎实的学术积累与丰富的工业界实战经验,当前致力于推动大模型与复杂Agent技术在真实业务场景中的技术演进与创新应用。

主题:《UMEM:打破Agent“死记硬背”困局的可泛化记忆框架》

概要:当前LLM Agent的长期记忆系统存在一个致命缺陷:过度拟合当前任务。现有方法只要能解决当下问题,就会把所有细节(包括噪声)存入记忆库,导致严重的”死记硬背”现象——遇到稍微变化的新任务,Agent便无法应对。核心问题在于:传统方法将记忆提取视为静态过程,仅通过提示词驱动,缺乏面向未来任务的泛化优化。我们提出UMEM(Unified Memory Extraction and Management),首次实现记忆提取与管理的端到端联合优化。核心创新包括:(1)语义邻域建模:构建与当前问题相似的Top-N查询簇,模拟”未来可能遇到的相似任务”;(2)边际效用奖励:只有当记忆在整个邻域上都能提升性能时,模型才获得高分;(3)GRPO优化算法:端到端训练记忆提取策略,确保记忆的泛化能力。在5个权威基准上的验证结果:(1)多轮交互任务(ALFWorld)成功率提升10.67%(61.11%→71.78%);(2)单轮推理任务平均提升5.82%,显著超越ReMem、Memp等强基线;(3)跨模型泛化:小模型训练的记忆优化器可直接赋能更强模型。当前UMEM的技术方案已经应用于部分真实Agent相关业务场景,实现效率提升和Agent能力自演进。

嘉宾:腾讯混元大模型团队Principal Researcher 王锴

简介:王锴现在担任腾讯混元大模型团队Principal Researcher,致力于利用神经网络参数生成技术提升大模型的通用能力和个性化水平。他博士毕业于新加坡国立大学,研究方向为神经网络参数生成和Efficient AI。谷歌学术引用6900余次,其中一作引用3000+。在ICLR,NeurIPS,ICML,CVPR,ICCV会议上发表论文40余篇。曾获得AISG Singapore Ph.D.Fellowship,中国政府奖学金等。博士期间曾指导多名本科生以第一作者身份发表顶会论文,并成功推荐多名优秀学子赴美国顶尖高校计算机系攻读直博项目。

主题:《混元无相:大模型的函数式神经记忆框架》

概要:随着基础模型从离线预测器向持续运行的系统演进,持续学习与即时个性化已成为核心架构需求。然而,当前主流的模型微调方法(如SFT或LoRA)仍局限于“静态参数记忆”范式——试图用单一的共享参数空间来满足复杂多变、甚至相互冲突的部署目标。我们的研究表明,在面对异构任务时,这种单点参数优化不可避免地会导致梯度冲突、模型性能妥协或过度特化。为了突破这一瓶颈,本次报告将介绍一种全新“记忆优先(Memory-first)”适配框架——混元无相(HY-WU,Weight Unleashing)。混元无相将记忆机制重构为一种神经网络模块,实现了函数式(算子级)记忆。该框架摒弃了传统的静态权重覆盖,引入了一个基于Transformer的参数生成器。它能根据输入实例(如图像与文本指令),即时(on-the-fly)合成专属的低秩(LoRA)权重更新,并在前向传播中注入冻结的骨干网络,从而在无需测试时优化的前提下,实现实例级的算子特化。我们将以“图像编辑”这一具有高度冲突性目标的任务作为压力测试场。通过严格的冲突控制实验和梯度分析,我们证实了混元无相成功避免了静态共享适配带来的结构性妥协;同时,生成的参数空间展现出了高度结构化的语义流形,证明其性能增益源于正确的“条件-参数”路由,而非单纯的参数量堆叠。混元无相证明了模型适配可以被重新定义为“学习向参数族映射的路由问题”,而不是寻找单一的妥协解。这将为大模型演进提供一条互补的新路径:即为结构化的、可路由的函数式记忆分配算力,在不破坏基础能力的前提下,实现无限的个性化特化。

嘉宾:阿里云高级技术专家 马腾

简介:马腾博士是阿里云高级技术专家,在阿里云主要从事大模型推理软件栈的开发和研究工作,并共同创建了大模型KVCache开源项目Mooncake(5K Star),目前Mooncake已经有阿里云/清华/月之暗面/蚂蚁/字节/趋境科技等多方参与,并且成功接入vLLM/SGLang/TRT-LLM/Dynamo等社区,同时他也是SGLang,RBG等社区的Committer。他在SOSP,ASPLOS,ATC,SC,Eurosys,VLDB,TPDS等顶级会议和期刊上发表论文二十余篇,相关成果授权美国/中国专利10项。他曾入选CCF系统软件专委会优秀博士论文激励计划,担任PPoPP,FAST,DASFAA,TPDS,ICME,TC,JSC等国际会议/期刊的程序委员会成员和审稿人。

主题:《记忆感知驱动的多智能体推理优化》

嘉宾:智悦云创及太忆TiMEM.ai创始人 余宣庆

简介:余宣庆,智悦云创及太忆TiMEM.ai创始人,中国科学院自动化研究所直博生,主要研究方向为大语言模型、时态知识图谱推理与认知计算,以主要作者在ACL、EMNLP等国际顶级会议发表论文多篇并担任ACL会议审稿人,参与国家级重点科研项目,拥有知识图谱相关软件著作权,长期从事大模型与知识图谱、时序数据交叉领域研究和转化,曾获评GSEA全球学生企业家奖中国区20强,项目曾获讯飞AI开发者大赛大模型教育赛道冠军、企业已在地方股权交易所大创板挂牌。

主题:《持续观察、反思学习并预测未来的类脑认知引擎》

三、大会报名火热进行中 六场研讨会邀你参与

大会设置了大会通票、贵宾票和观众票。其中,大会通票、贵宾票均需购买,观众票则为免费票,申请后需经审核通过方可参会。各类门票的详细权益可通过文末左下角「阅读原文」,直达官网进行了解。

大模型记忆技术研讨会是本次大会的六场研讨会之一,将于4月21日在分会场一下午进行。六场研讨会主要向持有大会通票和贵宾票的观众开放。

希望参加研讨会的朋友,可以扫描下方二维码,添加小助手“泡泡”进行购票,已添加过“泡泡”的老朋友,可以给“泡泡”私信,发送“GenAI26”即可报名。